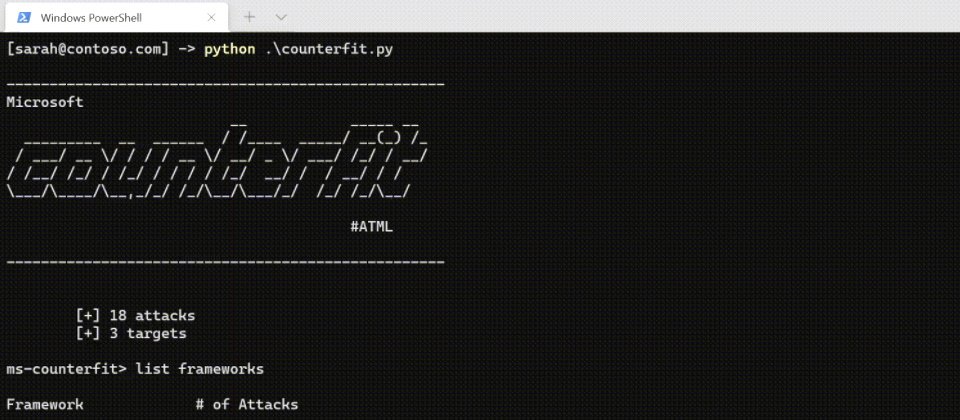

微軟釋出內部AI安全風險評估工具Counterfit,這是一個基於命令列的工具,可用來評估各種機器學習系統的安全性。(圖片來源/微軟)

微軟

微軟本周透過GitHub開源了內部所使用的AI安全風險評估工具,這是一個基於命令列的工具,且為一通用自動化層,可用來評估各種機器學習系統的安全性,可用來執行紅隊演練、滲透測試、漏洞掃描,也能紀錄攻擊事件。

微軟說明,AI系統日益被應用在各種關鍵領域,諸如健康照護、金融或國防等,消費者必須確認這些關鍵領域的AI系統是安全的。根據Gartner的預測,在2024年時,未部署AI風險管理控制機制的組織,得到負面AI結果的風險是有部署相關機制者的兩倍,然而,在微軟針對28個組織所進行的調查中,有25個並未部署得以正確保全AI系統的安全機制,意謂著安全專家正在尋找該領域的具體方針。

Counterfit是微軟為了評估內部AI系統漏洞所發展的工具,初期是為了對抗針對個別AI模型所撰寫的攻擊腳本程式,繼之擴大為可捍衛多個AI系統的通用自動化工具,現在微軟仍定期利用Counterfit作為AI的紅隊演練工具,亦可用來掃描生產AI服務的漏洞,或是在AI部署階段就逮住漏洞。

圖片來源_微軟

目前的Counterfit已可適用於不同的環境、不同的AI模型與資料格式,例如它能評估位於任何雲端環境、就地部署或是邊緣的AI模型,也可抽象化AI模型的內部作業以讓安全專家能專注於安全評估,並支援基於文字、影像或通用輸入等AI模型。

微軟標榜Counterfit是替安全專家所設計,因此它能針對AI系統展開滲透測試及紅隊演練,還能掃描各種AI系統的安全漏洞,同時在AI系統遭到攻擊時進行紀錄。

此外,微軟亦建議安全專家在使用Counterfit時可搭配其它資源,涵蓋Adversarial ML Threat Matrix、將攻擊分類的Bug Bar、威脅建模指南,以及紀錄各種ML失敗模式的分類文件。

熱門新聞

2026-02-11

2026-02-09

2026-02-11

2026-02-10

2026-02-10

2026-02-06

2026-02-10

2026-02-10