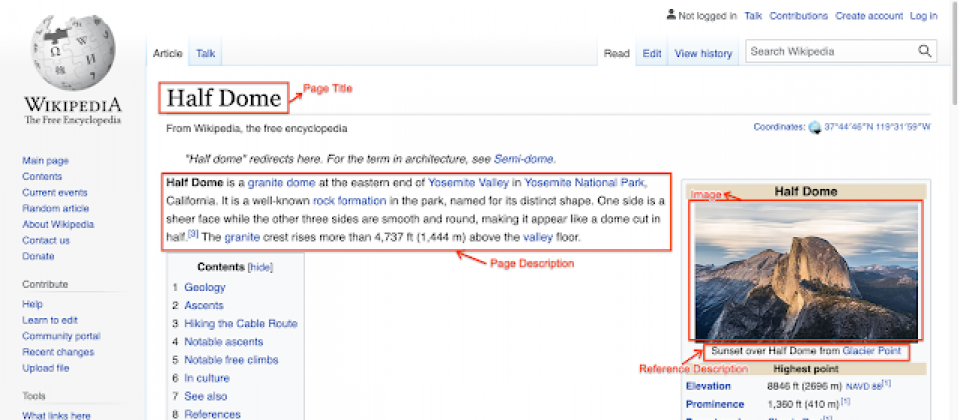

Google推出了以維基百科為基礎的大型多模態資料集WIT,藉由擷取維基百科中相關聯的文字段落,以及維基媒體圖像所組成,這些資料經過嚴格的篩選過濾,僅收集高品質的圖像文字集。WIT資料集內含3,750萬筆圖文樣本,包括了108種語言,和1,150張獨特的圖像。

研究人員提到,多模態視覺語言模型,仰賴豐富的訓練資料集,來對圖像和文字之間的關係進行建模,而在過去,這些資料集必須透過手動,替圖像加上標題,或是使用爬蟲擷取網頁圖片的替代文字,作為註解。

雖然人工製作的資料集品質較高,但是也因為需要大量的手動註解工作,因此限制了可以產生的資料量,相反的,雖然自動方法可以產生更大的資料集,但是需要以啟發式方法,仔細過濾內容,來確保資料品質,以及模型的效能。而且當前的資料集還有另一個缺點,便是欠缺非英文的樣本。

為此,Google研究人員製作了WIT資料集,提供一個包含多種內容的高品質、大型且多語言資料集。WIT是目前最大的公開圖文範例資料集,其涵蓋的語言比任何資料集還要多10倍,更重要的是,WIT和每個圖像只有一個標題的典型多模態資料集不同,WIT中的圖像註解為段落甚至是章節等級的上下文資訊。

研究人員提到,WIT的目標是要在不犧牲品質和覆蓋率的情況下,創建大量資料集,而由於目前維基百科是世界上最大的線上百科全書,因此他們決定使用維基百科來創建資料集。研究人員選擇包含圖片的維基百科頁面,並且擷取圖像周圍的文字,刪除像是預設填充文字等,來確保資料的品質,研究人員也篩選圖像,確保圖像在一定尺寸以上,還排除仇恨言論,使其適用於各種研究上。

研究人員邀請人類編輯,來對WIT進行評估,在圖文搭配上獲得98%的滿意度。由於維基百科涵蓋廣泛的概念,因此WIT評估資料集也可當作是具有挑戰性的模型基準,研究人員表示,WIT資料集可以讓其他研究人員,建構更好的多模態多語言模型,最終改善用於現實世界視覺語言任務的機器學習模型。

熱門新聞

2026-02-11

2026-02-12

2026-02-11

2026-02-10

2026-02-09

2026-02-13

2026-02-10