微軟人工智慧純視覺GUI代理程式OmniParser,能夠提升多模態人工智慧模型,諸如GPT-4V在多平臺環境的互動準確性和效率。OmniParser仰賴純視覺技術,將螢幕截圖轉換為結構化資料,並運用語義標註技術,使得人工智慧能夠自動辨識和操作GUI中的互動元素,替人機互動建立基礎。

諸如GPT-4V等多模態人工智慧模型,在圖像和文字方面展現了強大的處理能力,但是要應用在操作GUI,目前的多模態模型面臨一些挑戰。模型辨識GUI中可互動元素,像是按鈕、圖標、可點擊連結上仍存在技術瓶頸,模型可能難以辨識每個互動元素的功能,或是無法在複雜的介面中,執行正確的動作。

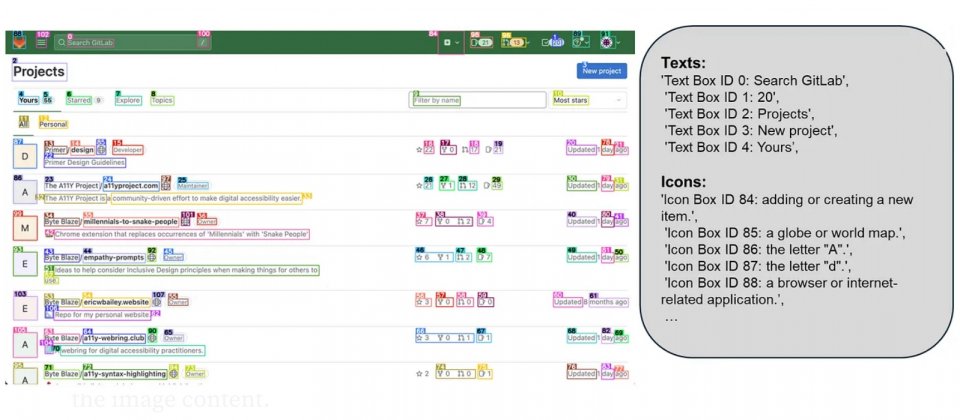

針對這些操作問題,微軟開發了OmniParser,這是一個純視覺解析的工具。該工具透過互動區域偵測和語意標註技術兩個步驟流程,大幅度提升GPT-4V操作GUI的能力。OmniParser偵測模型可以能夠準確辨識介面上互動元素,並標記可點擊的區域,由於偵測模型經過大量熱門網頁資料訓練,即便是在複雜介面也能明確定位互動區域。

另外,OmniParser還結合光學字元辨識和語義標註模型,能夠對GUI元素提供語義描述,協助人工智慧模型理解每個元素的功能和作用,在指令生成過程提供精準的操作建議。

OmniParser讓人工智慧能夠在多平臺環境精確地執行互動操作,其無依賴性和高精確度的設計,使OmniParser成為客服、自動化資料處理等需大量重複操作工作的理想工具。藉由其跨平臺的能力,OmniParser不需要仰賴HTML或是其他後設資料,即便在不同作業系統也可有效運作。

在數位助理和自動化操作需求日益增加的當前,不少人工智慧公司也投入GUI操作的研發,強化人工智慧在人機互動的能力。Anthropic近期也針對多模態人工智慧模型Claude 3.5 Sonnet開發了專屬API,使該模型能夠感知並操作電腦介面,將模型指令轉換成為具體的電腦操作指令,執行諸如開啟應用程式和填寫表格等複雜任務。

隨著GUI解析技術的成熟,人工智慧在跨平臺操作中的靈活性將大幅提升,進一步擴展自動化任務的應用可能性。

熱門新聞

2026-02-11

2026-02-09

2026-02-10

2026-02-11

2026-02-06

2026-02-10

2026-02-10

2026-02-10