Google發表了自由通用聲音分離資料集(Free Universal Sound Separation,FUSS),以促進社群在於聲音分離的研究。FUSS的目的是要來支援聲音分離模型的研究,讓研究人員利用模型,從包含多個聲音來源的錄音中,分離出各種聲音。

Google提到,過去要從錄音中分離這種不同的聲源,其分離工作著重在從混合錄音中,分離出少量聲音類型,像是從錄音中分離出語音與非語音,或是分出錄音中兩位說話者的語音,而在分離之前,還需要預先知道錄音中存在聲音的數量。

而Google所創建的FUSS資料集,是要來解決更加普遍通用的問題,希望可以將錄音中,隨意數量的聲音彼此分開,Google表示,這個領域訓練模型,有一個主要的障礙,是即便擁有了高品質的錄音,也無法簡單地以基準真相標註這些聲音;而這也就出現了以高品質模擬來克服此一限制的方法,但要達到良好的效果,使用者需要使用逼真的房間模擬器,編排各種元素以取得真實、多音源以及多重等級的基準真相聲音。

FUSS則具備了這些特性,其運用了freesound.org上CC授權的音訊剪輯,共取得約23小時的錄音,其中包含了12,377種可用於混音的聲音,Google利用自家開發的模擬器,處理這些音訊剪輯,共創建了2萬個用於訓練的混音,1千個驗證用混音和1千個評估用混音。

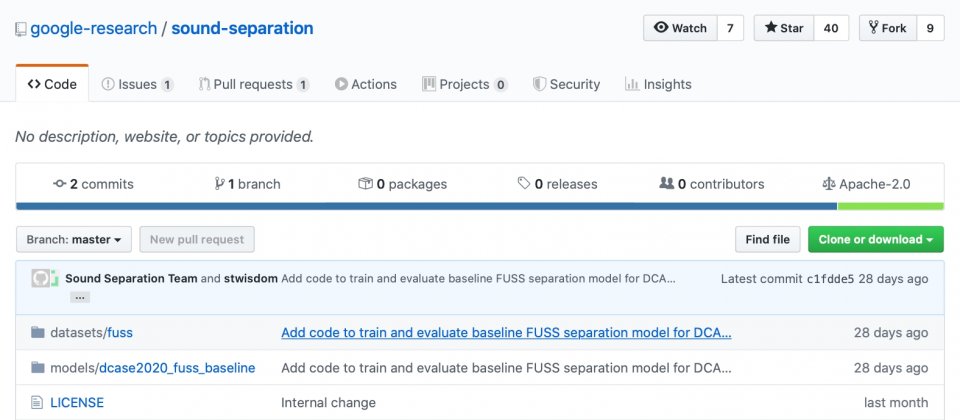

Google採用Tensorflow開發自家的房間模擬器,研究人員可利用此模擬器,產生具聲源以及麥克風位置資訊的錄音,其所產生出來的音訊媲美昂貴的房間模擬器。Google也釋出了遮罩分離基準模型,即便錄音中存在2到4個聲音來源,該模型也能維持良好的效能。Google這次釋出的內容,包含各種聲音的FUSS資料集、音訊樣本的聲音組成編碼,還有基準模型,未來可能也會釋出模擬器程式碼。

熱門新聞

2026-02-09

2026-02-10

2026-02-06

2026-02-10

2026-02-11

2026-02-10

2026-02-09

2026-02-10