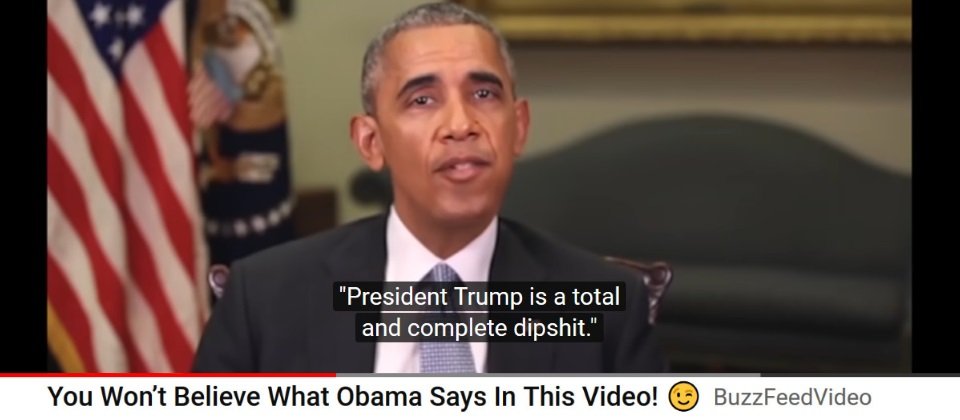

Deepfake的威脅已經引起各界重視,如網路媒體Buzzfeed,他們特別製作AI生成的假造影片,說明可能帶來的危害。

俗話說,有圖有真相,有片有真相,意思是文字描述不夠真實,但配上圖片或影片就能提高可信度。雖然過去已經有不少修圖、電影修片專家能合成逼真的影像,但製作門檻還是有,只是,隨著深度學習(Deep Learning)技術與之結合發展,將為全球社會帶來新興風險。

基本上,深度學習是有助於實現機器學習的一種技術,能為許多科技面向帶來好處,若用在影像合成領域時,能協助電影、遊戲領域製作,處理上可以更省時,但在現實應用場景中,與假訊息結合之後,卻也開始讓影像偽造門檻降低,不實內容影像製作變得氾濫,於是,深度偽造(Deepfake)一詞也油然而生。

AI讓影片換臉應用發展快速

關於Deepfake,根據維基百科說明,是英文「Deep Learning」和「Fake」所混合而成的單字,也就是將「深度學習」加上「偽造」,專指基於人工智慧的人體圖像合成技術的應用,因此涵蓋未來所有更進階AI技術變造的聲音、視覺內容。

而近年來,已經出現了不少相關事件,讓大眾認識到這類AI變換人臉的技術發展,並開始注意到未來應用於假消息時的可能影響。

例如,2017年俄羅斯開發商打造的FaceApp,就利用了AI技術,讓用戶能夠針對人臉來增加笑容,變年輕或變老,甚至變換性別;到了2019年,由中國軟體開發商打造的ZAO,也利用AI技術,讓使用者可將自己的人臉直接套用到電影角色。顯然,這些App使用AI技術打造了有趣的變臉應用,但也額外衍生用戶隱私的問題。

此外,市面上,這類Deepfake的工具已經不少,還包括:DeepFaceLab、Fakeswap、Openfaceswap、Myfakeapp等,其中,有一些是開放原始碼軟體。

用AI將知名女星換臉到成人影片

令人擔憂的是,這樣的技術若遭到大量濫用,可能為全球社會帶來極大的負面影響。舉例來說,在2017年12月,美國知名網路論壇Reddit有網友發布了一則文章及影片連結,內容是以AI技術來假造知名女星AV成人影片,而該片的女主角,竟是飾演電影《神力女超人》的女主角Gal Gadot。當然,這影片並非Gal Gadot下海主演,而是利用AI技術產生而成,將知名女星的臉直接替換到某支A片,且真實程度已經到了讓人感到訝異的地步。

顯然,這種使用AI的移花接木手法,在吸引廣大關注的同時,也引起一些人的反思,像是可能用於蓄意破壞他人名聲,或是惡搞,而且,未來人們也可能更難分辨其真偽。而且,在操作手法上,Deepfake除了能假造一個人沒做過的事,也還能夠反向操作,像是假造一個人沒做過的好事。

有影片將不再有真相?

另一起事件,是在2018年4月有國外網路媒體Buzzfeed製作了AI假影片,目的是呼籲大眾要謹慎判斷網路上的消息。他們發布了一則以AI技術假造的演講影片,當中是以AI技術來改變前美國總統歐巴馬的致詞內容,當中大部分都是歐巴馬對著鏡頭說話的原始影片,但有一句話居然變成「川普總統完全就是個笨蛋!」當然,這句話也不是歐巴馬所說,而是利用AI技術改變嘴型與聲音而成,若觀眾不仔細觀察,很難察覺異常。

在這樣的Deepfake情境中,我們不難想像到更多的可能性,包括假造候選人、官員或專家沒說過的話,用於政治、社會與經濟等面向的干擾,又或是假造企業高層或同仁的發言,像是發布企業利多或利空的消息,進而在投資市場獲利,或是干擾企業營運等。而且,比起文字式的假消息,若是這類造假影片在網路上大量散布,更是讓企業及組織闢謠增添難度。

杜絕假消息會變得更困難

綜觀上述的Deepfake的發展與事件,顯然AI的普及不只是助長了影像合成技術的發展,從偽造內容的面向來看,Deepfake也讓假消息的威脅更上一層樓。

畢竟,假消息的問題本就是越來越嚴重,尤其是智慧型手機普及之後,現在人人都能夠上網,而且是無時無刻,這也包括了原本對網路不熟的民眾,有些人經歷即時通訊與社群平臺的時間較短,可能更容易受到假消息的影響與煽動。再加上我們身處於資訊量爆炸的時代,如今又有Deepfake出現,假訊息的問題只會變得更嚴重。

譬如說,多數人很可能因為只看標題,加上又有影片證實,看個幾秒後就快速分享,而在假造影片氾濫之下,相對地,真實的影片也會因為立場不同而被說是假造的。至於整個社會環境,還將可能產生更多的對訴訟或司法程序,造成重大影響。

事實上,影像類的資訊早已有人為操弄的空間,像是從單一角度來拍攝影片,讓觀眾誤會是特定狀況,但從另個角度看並非如此,或是可以擷取部分片段來誤導。如今用AI快速產生逼真的造假影片,將讓問題變得更氾濫。

AI身分冒用讓詐騙手法翻新

Deepfake的影響不僅止於此,還有一個不能忽略的面向,就是AI身分冒用的問題,可能讓網路犯罪更難防範。舉例來說,原本鎖定企業的商業電子郵件詐騙(BEC),也可能在Deepfake技術加持下,讓身分冒用攻擊的管道從電子郵件延伸至視訊與電話。

簡單來說,BEC詐騙是網路犯罪組織策畫的複雜騙局,對方會從許多面向取得企業與合作廠商的交易匯款訊息,並以竄改或假冒電子郵件等方式,像是伺機假冒高階主管,或往來供應商的來信,通知要求更改匯款帳號,導致未察覺出異常的企業財務主管或老闆上當。

在今年2月FBI發布的2019年度網路犯罪報告中,更是指出BEC詐騙這類犯罪所造成的損失,已高達17億美元,帶來的危害持續擴大。臺灣近年也有不少企業受害,向警方報案處理。

而這樣的身分冒用攻擊,在Deepfake技術發展之下,也有了新的威脅面向。例如,在2019年下半,有一家英國能源公司的執行長,就因為誤以為接到德國總部執行長的來電,進而聽從對方指示匯錢,因此被訛詐了22萬歐元。其實,這並非真正德國總部執行長的來電,是駭客集團以Deepfake技術偽裝成老板聲音,所下的命令。

如何因應成各界關心焦點

無論如何,很多人都擔心AI生成影片的技術,可能會被大量濫用,像是成為操控輿論及名聲的新工具。

對此難題,許多科技大廠也正試圖號召更多好手,發展可辨識惡意惡意偽造影片的偵測模型。例如,在2019年9月,微軟和臉書發起了競賽,名為Deepfake Detection Challenge,就是希望集眾人之力,找出更好的偵測方式。而在2020年6月,全球2千位AI專家參賽,陣容相當龐大,但從公布的比賽結果來看,辨識假造影片成效最高只能認出8成,而且,參賽模型無法準確判讀未知資料,而這也顯示現有技術辨識假造影片仍有困難。

此外,面對AI、Deepfake用於詐騙的威脅,相關作法的發展狀態,也將成為企業與民眾關心的新課題。例如,通訊平臺能否提供更精準的過濾技術,以及用戶應從不同管道來進行二次確認,並且建立多個審核的程序。

不論如何,隨技術演進,Deepfake產生的影像將讓人更無從判斷真假,製作門檻也只會越來越低,全球社會都必須積極應戰。

隨著Deep learning技術在影像合成領域的發展,在2017年,就有網友以AI將知名女星的臉替換到某個A片,而引起廣大注意。

熱門新聞

2026-02-11

2026-02-12

2026-02-11

2026-02-10

2026-02-09

2026-02-13

2026-02-10