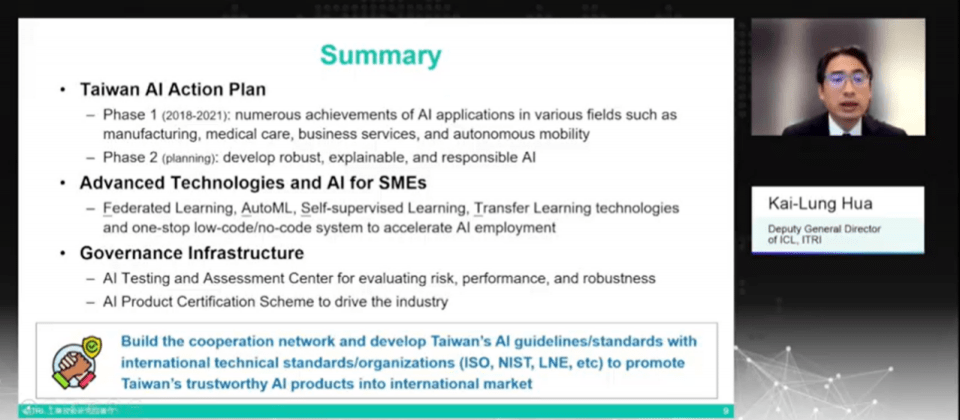

工研院資通所副所長花凱龍透露,行政院發起的臺灣AI行動計畫下一階段,將聚焦可解釋、可信任AI,並建置AI產品驗證標準,以及中小企業適用的低程式碼平臺。

螢幕截圖

重點新聞(0729~0804)

這周有不少可信任AI重點,比如工研院揭露,臺灣AI行動計畫下一波要聚焦可解釋、可信任AI,政府也要建置AI測試評估中心和AI產品驗證機制,並發展中小企業適用的低程式碼平臺來加速AI落地,預計明年上半年推動。其他還包括美國國家標準與技術研究院(NIST)分享可信任AI四大原則、Meta聯手數據隱私公司打造AI產品公平性平臺。在AI實作上,微軟優化深度學習函式庫DeepSpeed來加速兆級參數模型訓練,Nvidia也改善語言模型框架NeMo Megatron,來縮短30%的GPT-3模型訓練時間。

臺灣AI行動計畫 可信任AI 工研院

工研院揭臺灣AI行動計畫下一步:可信任AI

工研院資通所副所長花凱龍在可信任AI研討會上揭露,臺灣AI行動計畫下一階段將聚焦可解釋、可信任AI,並發展中小企業適用的先進技術,如聯合學習、自動化機器學習(AutoML)工具、自監督學習、遷移學習等,以及低程式碼平臺,來加速AI開發。另一方面,他也透露,工研院也將建置AI治理基礎設施,如建立AI測試和評估中心,來衡量AI風險、模型表現和穩健性,以及打造AI產品驗證機制,來推動產業發展。第二階段最快明年上半年展開。

進一步來說,臺灣AI行動計畫是行政院2018年發起的國家級計畫,第一階段用2018年至2021年的4年時間,來推動產業AI化。當時聚焦5個主軸,包括人才、晶片、國際新創、法規與場域開放,以及推動產業AI化的「業界出題,學界解題」模式。現在,政府正籌備第二階段,將聚焦可解釋、可信任AI,包括參考國際標準來制定AI產品驗證規範、建立模型測試和評估方法,並發展中小企業可通用的低程式碼平臺和一站式平臺,來加速AI開發、落地。(詳全文)

NIST 可解釋性 AI計畫

美NIST幕僚長分享AI可解釋性四原則

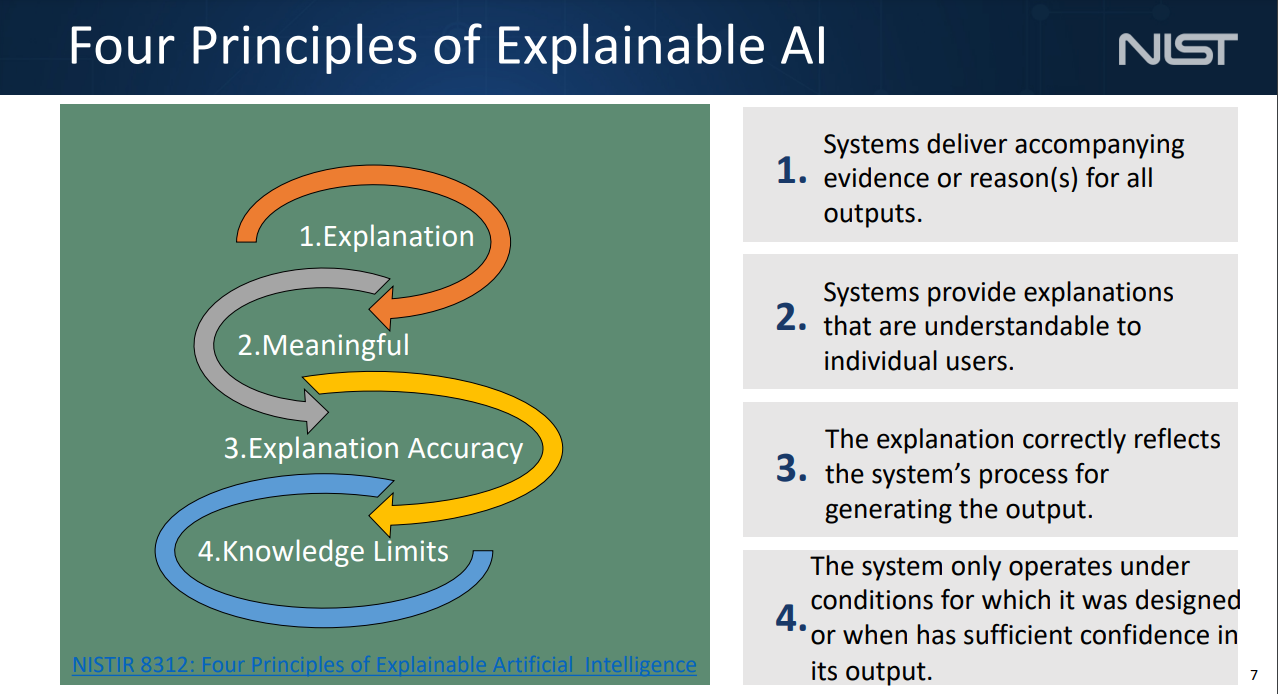

美國國家標準與技術研究院(NIST)資訊技術實驗室幕僚長Elham Tabassi日前分享NIST可信任AI作法,他們先是規畫6大面向的AI計畫,包括可信任AI技術基礎研究、跨實驗室的AI創新研究、制定AI技術基準測試和評估指標、制定業界標準、協助制定政策,以及確保資源來落實NIST AI計畫。

在這之下,NIST發展出可解釋AI四原則,包括產出解釋、有意義的說明、解釋準確性以及知識局限。也就是說,在解釋部分,AI系統產出輸出值時,得一併附上證據或原因,再來,系統提供的解釋,必須是單一使用者能理解的說明。接著,這些解釋,要能準確反應系統產出輸出值的過程,最後,系統必須在符合設計初衷的條件下運作。(詳全文)

Gartner MLOps 雲原生

Gartner:MLOps市場生態系仍高度分散

知名調研機構Gartner副總裁暨分析師Chirag Dekate日前接受外媒採訪透露,MLOps市場生態系高度分散、百家爭鳴,導致企業使用者感到困惑,不知道該選何種廠商和產品來維運自家模型。他解釋,Gartner追蹤了全球300多家MLOps廠商,每家都聲稱提供MLOps,但提供的功能卻是零碎的。比如,有些廠商提供特徵儲存庫,有些提供模型訓練環境或模型部署功能。而他也常被企業問及,該如何駕馭不同廠商的工具等問題,像是該從公雲平臺服務用起,還是自己拼湊出一個工具鏈較好。

但他觀察發現,目前業界這兩種方法都可行,不論是雲原生套裝服務,還是自行選用不同廠商的最佳產品組合都可以。他指出,雲端化程度高的企業傾向使用AWS、Google或微軟等公雲業者的原生技術堆疊,不僅配合企業投資政策,又能快速整合。但對想要擁有公雲業者提供不了的服務的新創來說,自行組裝一套工具鏈則是常見的做法。不過,最常見的企業做法仍是混合策略,比如用公雲業者服務為基礎,再加入其他廠商的元件。為了提高整合性,他預期,未來1年MLOps時常會出現更多雲原生服務。(詳全文)

Meta 公平性 Oasis Labs

Meta聯手數據隱私公司打造AI產品公平性平臺

Meta近日聯手數據隱私公司Oasis Labs,要打造AI產品公平性平臺,來評估Meta AI服務的公平性。進一步來說,Oasis Labs採用安全多方運算(SMPC)技術打造該平臺,來確保訊息不外流,而他們的第一個專案是,由Meta發出Instagram問卷調查,讓使用者自願回答自己的種族,並根據這些答案來衡量Meta服務是否公平。

Meta指出,這些資訊很重要,有這些訊息他們才能知道自己的AI服務是否公平,以進一步改善。為保護資料隱私,他們將採SMPC和其他加密技術,來避免Meta和第三方機構直接得知使用者回答。接著,他們會使用AI模型來運算這些資料,並衡量公平性。(詳全文)

AI軍備 北約 創投

AI成多國國防重心,北約砸10億歐元投資AI軍備技術新創

北約(NATO)22國前陣子宣布成立北約創新基金,是世界首家多國創投,要在未來15年間,投資新創公司、發展高科技軍備應用,保障同盟國10億公民安全。進一步來說,北約將撥出10億歐元基金,投資初階新創和其他創投,來發展北約優先考量的新興技術,如AI、大數據處理、量子技術、自動化機械和生物技術等。

不只北約,英國6月時發布以AI為中心的國防現代化戰略,要讓軍方更容易整合民間AI技術,來建立國防AI研究發展中心。德國也在6月撥出5億歐元國防研究經費,研究技術之一就是AI。美國國防部在去年,也提出8億多美元軍事預算,要用於2022年的AI研發。此外,美國今年也加入澳洲、日本、印度和其他亞太國家,透過立法規範資料傳輸、隱私和AI使用情境,來發展軍事AI應用。(詳全文)

Azure 大規模模型 DeepSpeed

兆級參數模型訓練變簡單了!微軟簡化深度學習函式庫軟硬體堆疊配置

微軟強化Azure對超大模型的訓練支援,用戶可用深度學習函式庫DeepSpeed和1024個A100 GPU,來執行兆級參數的模型訓練。過去,用戶要訓練這類大規模模型,得配置和維護一個複雜的分散式訓練基礎設施,這些工作通常包含手動步驟且容易出錯,因此可用性和效能表現並不佳。

現在,微軟採用全端最佳化,將訓練所需的硬體、作業系統、虛擬機器映像檔,還有包含PyTorch、DeepSpeed、ONNX Runtime,與各種Python套件的Docker映像檔,以及Azure機器學習API,經過最佳化、整合和測試,使其具有良好的效能和可擴展性,讓用戶不需處理複雜的配置。在經最佳化的Azure DeepSpeed堆疊上,用戶可訓練1-2兆參數的超大型模型。(詳全文)

Nvidia NeMo Megatron 大型語言模型

Nvidia更新語言模型框架,可加速30%訓練時間

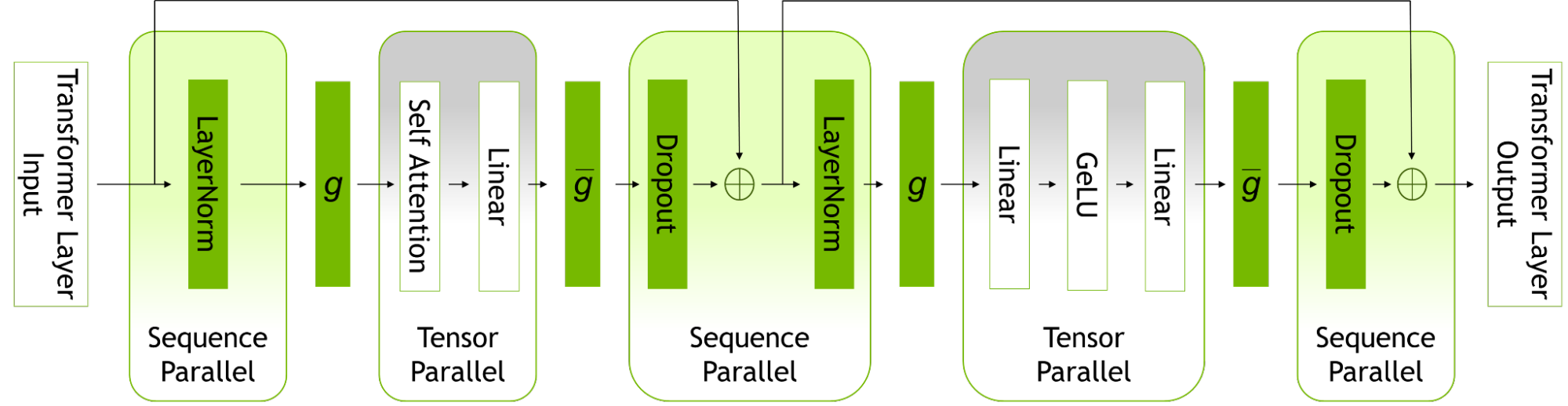

Nvidia日前更新自家大型語言模型框架NeMo Megatron,可加速GPT-3類模型30%的訓練時間。進一步來說,該框架這次採用了2種新技術來加速,包括序列平行化(SP)和選擇性主動再運算(SAR),其中,SP可用來偵測之前未平行化的transformer層,並以張量等級來進行模型平行化。而SAR則能針對transformer層中的特定區域重新運算,不必全部來過,因此減少運算資源的消耗。

Nvidia指出,該框架可處理大型語言模型的訓練工作,參數從220億到1兆個可以。在使用1,024個Nvidia A100 GPU的條件下,只要24天就能訓練具1,750億個參數的模型,比舊版本快上10天。最近由Hugging Face釋出的知名開源模型BLOOM,就是使用Nvidia新版框架的案例之一。(詳全文)

AI近期新聞

1. Meta開源物件偵測模型 ViTDet,可偵測更多常見和不常見物件

資料來源:iThome整理,2022年8月

熱門新聞

2026-02-11

2026-02-11

2026-02-09

2026-02-10

2026-02-10

2026-02-06

2026-02-10