Databricks在釋出大型語言模型Dolly的兩週後,又釋出了Dolly 2.0,而第二個版本的重點在於開源且商業可用。Databricks集結5,000名員工,共同編寫databricks-dolly-15k指令遵循資料集來訓練Dolly 2.0,現在Databricks對外開源整個Dolly 2.0,包括訓練程式碼、資料集和模型權重,供商業和學術使用。

Databricks以30美元超低成本,訓練出Dolly 1.0模型,Dolly 1.0使用史丹佛大學的Alpaca模型開發團隊,以OpenAI API所產生的指令遵循資料集訓練而成。Databricks在發布Dolly 1.0之後,收到許多人詢問Dolly 1.0是否可以用於商業用途,官方答案是,可能不行。

因為Alpaca模型開發團隊所生成的指令遵循資料集,內容包含使用OpenAI的text-davinci-003模型生成的資料,而該OpenAI的使用條款,明確禁止用戶將其用於開發和OpenAI競爭的模型。目前所有知名的指令遵循模型,幾乎都受到相同限制而無法用於商業目的,因此Databricks要產生一個允許商業用途的指令遵循模型,勢必需要創建一個全新的資料集。

要取得人工智慧的豐碩成果,背後需要許多工人智慧的累積,OpenAI的論文說明InstructGPT模型,是使用一個包含13,000個指令遵循資料集訓練而成,Databricks表示,創建13,000條問題和答案比想像的還困難,因為每個答案都必須是原創,不能來自ChatGPT或是從網路上其他來源複製,否則會污染資料集。

Databricks招來自家5,000名員工,共同編寫指令遵循資料集,目標是創建比OpenAI品質更高的資料集,畢竟OpenAI的資料集僅由40個人產生。Databricks舉辦了一場比賽,前20名將可獲得公司提供的大獎,資料集具體的內容包括開放問答、封閉式問答、可由維基百科段落回答的問答、維基百科總結資訊、腦力激盪、分類和創意寫作。

最後Databricks編寫出一個具有15,000條問答的資料集databricks-dolly-15k,官方提到,雖然這個資料集比Dolly 1.0所使用的Alpaca資料集小得多,但是EleutherAI的pythia-12b經過databricks-dolly-15k資料集訓練之後,卻能表現出高品質指令遵循行為,官方提到,由模型生成的資料集反而存在幻覺和錯誤事實,而databricks-dolly-15k由專業人士生成,包含高品質和更長答案,產生的結果也會更好。

Dolly 2.0專案完全開源,無論是商業還是學術用途,皆可用來創建高品質模型,且不需要冒著向第三方洩漏機密的風險,官方也認為,人工智慧的安全、偏見和問責議題,需要由不同利益相關者共同解決,而開源資料集和模型,將可促進這類的研究和創新。

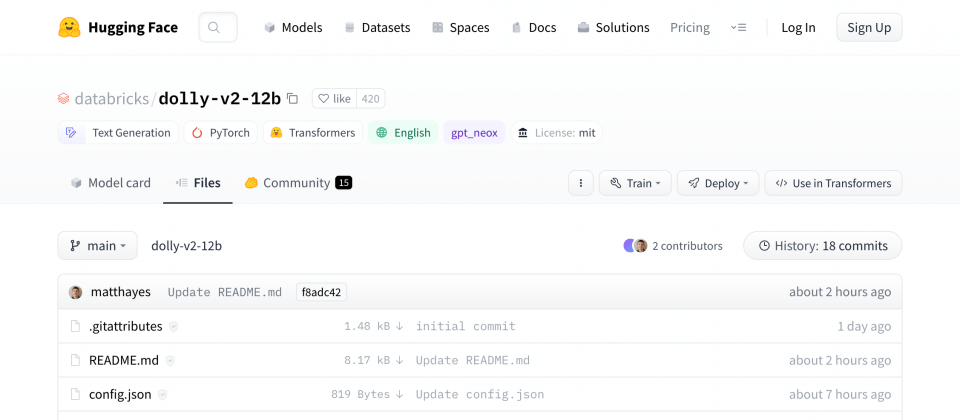

使用者要下載Dolly 2.0模型的訓練權重,可以從Hugging Face頁面,並且存取databricks-labs中的Dolly儲存庫,下載databricks-dolly-15k資料集即可取得。

使用第三方的人工智慧服務就有洩漏敏感資料的可能,三星因為開放員工使用ChatGPT,而洩露包括半導體設備量測資料庫、生產/瑕疵設備相關軟體,以及公司會議語音轉錄文字紀錄等機密資料,這樣的情形也不只發生在三星,資安公司Cyberhaven監控160萬名員工,發現有3.1%員工上傳敏感資料到ChatGPT上,因此對企業來說,自建指令遵循人工智慧模型,可能是一個更安全也更有吸引力的選擇。

熱門新聞

2026-02-09

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-09

2026-02-06