國科會揭露可信任AI對話引擎(TAIDE)計畫藍圖,接下來將打造參數量更大的模型、讓模型具備阻擋不適回答的能力。他們預計今年秋季開發企業版小型LLM,年底則將完成130億參數模型的建置。

攝影/王若樸

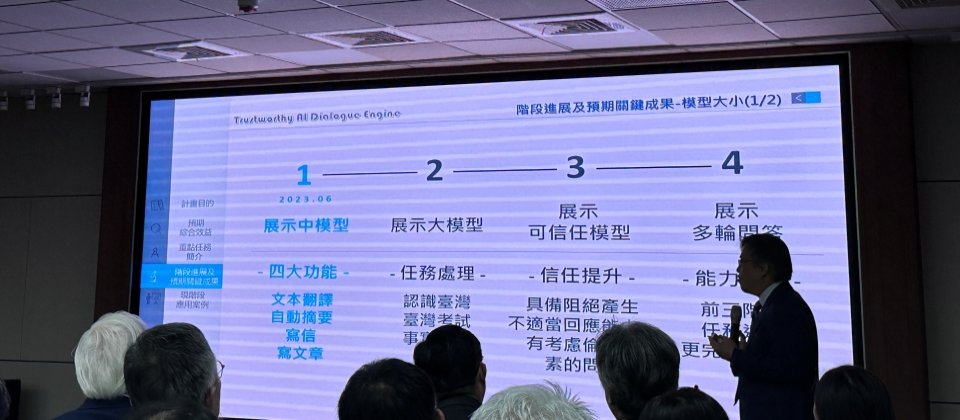

國科會今日(6/14)揭露臺版可信任AI對話引擎(TAIDE)計畫第一階段成果,TAIDE模型以LLaMA為基礎、以中文資料微調而成,目前版本為70億參數,可執行自動摘要、翻譯、寫信、寫文章等4大任務。接下來,TAIDE計畫還將經過3階段發展,包括130億參數大模型階段、具備阻絕不適當回答能力的可信任階段,以及多輪問答階段。今年,國科會還將以商用授權的LLM為基礎,來打造國產小型企業版模型,來供商業使用。

用繁中資料打造臺版生成式AI,同時建立可信任AI驗證機制

今年2月13日,國科會主委吳政忠就指出,臺灣要有自己的大型語言模型(LLM)。於是,TAIDE計畫隨之展開,集結國內學術團隊和國科會轄下機構,由陽明交大應數系教授李育杰擔任計畫負責人,來統籌TAIDE開發工作。李育杰表示,國科會觀察,近年各種大型語言模型推陳出新,從2018年的BERT一直到最近的BLOOM、ChatGPT、LLaMA、GPT-4等,各國也積極發展LLM,「臺灣也不能缺席,」要從生成式AI人才培育、高速運算環境、高品質語料收集和標註等面向打好基礎。

而TAIDE計畫的宗旨是要以臺灣文化為基礎,加入臺灣特有用語、價值觀和風俗習慣等元素,來讓生成式AI理解、回應在地使用者需求,打造可信任的生成式AI引擎基礎模型。簡單來說,TAIDE模型是為臺灣量身打造,讓政府和企業可根據需求,來選擇合適的模型大小、算力,來自行訓練模型,打造內部應用。這麼做,也能解決高機敏性企業用AI的顧慮。

李育杰說明,團隊一開始嘗試開源的大型語言模型BLOOM,以它為基礎來打造TAIDE,但發現效果不如理想,因此改以Meta的LLaMA為基礎,透過網路爬蟲方式收集大量繁中資料,如新聞資料,來優化模型。他也點出,這些訓練資料大約有1,440億個Token。

但為確保資料品質和合規性,團隊也花了不少時間清洗資料、取得資料授權並標註資料,同時根據不同主題和領域分類整理,設置特定領域的應用案例,來補足企業需求。微調模型時,他們也透過臺大教授李弘毅團隊來以強化學習優化模型表現,另一方面,國科會也建置運算環境和應用服務平臺,來為後續的推廣應用打下基礎。李育杰補充,國科會除了將升級臺灣杉超級電腦,今年10月還將購入一批新一代H100 GPU,加強算力。

不只如此,這個TAIDE計畫除了發展可信任AI對話引擎,還有另一個重要任務,也就是建置可信任AI的驗證機制。進一步來說,團隊將聚焦法規和驗證標準化,先研究AI法規,要協助國內AI法制化,還要針對技術和產業面,規畫驗證機制和相關工具,來完善AI發展環境。此外,他們還要納入資安檢測機制,來確保資料安全。這些驗證工作和資安檢測工作,將由數位部負責。

預計秋季開始打造商用版、年底完成13B版本模型

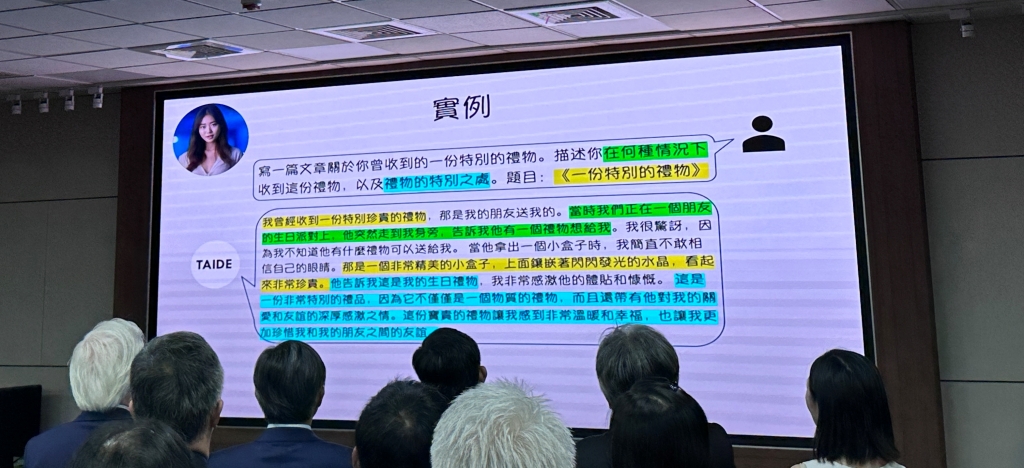

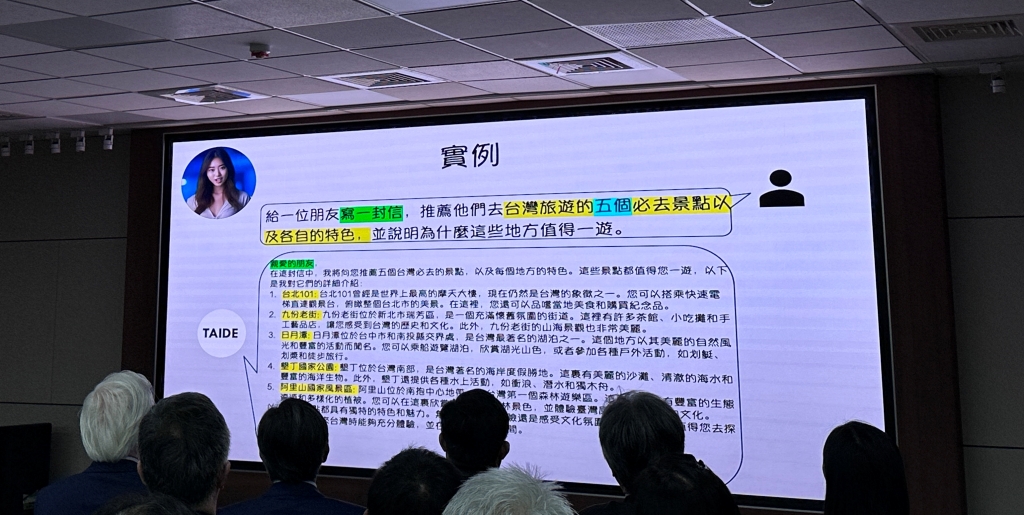

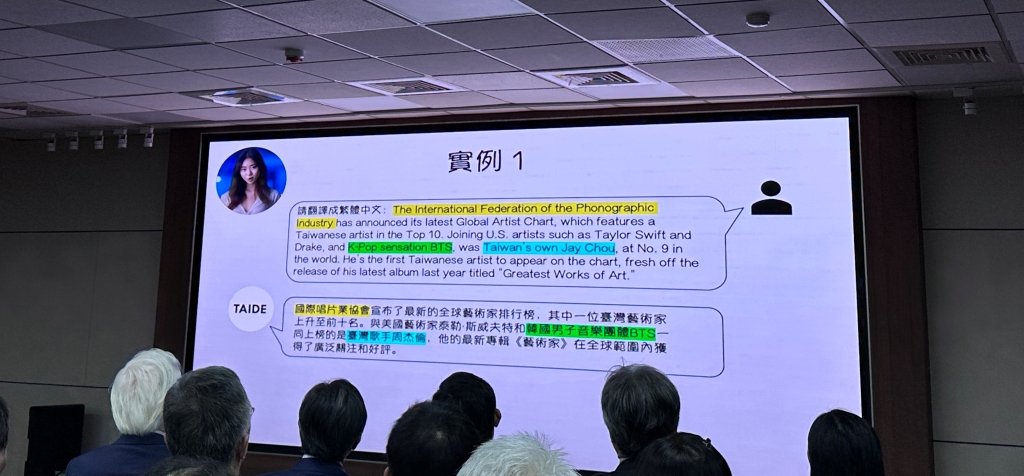

今日,TAIDE 7B版本模型亮相,屬於TAIDE計畫的第一階段成果。這個7B模型可執行自動摘要、翻譯文本、寫信、寫文章等4大任務(如下圖),生成內容比其他主流模型要好,包括LLaMA-7B、以簡中資料訓練而成的Chinese Alpaca-7B、BLOOM-zh-3B。

接下來,TAIDE計畫將進入第二階段,也就是打造130億參數的版本,要具備更多臺灣知識、能作答臺灣考試,且還要有事實查核的能力。而第三階段目標,則是要讓TAIDE具備可信任能力,包括要能阻絕產生不恰當回答的能力,以及有能力考慮倫理相關問題。

計畫最後一階段,則是要TAIDE模型具備更完善的多輪對話能力,以及能成熟執行前述所有任務。國科會預計今年底展示130億參數的大模型,以及它阻絕產生不適當回應的能力。

李育杰也透露,團隊預計下半年打造商用版TAIDE模型。但由於LLaMA只開放學術授權,團隊將改用開放商用授權的LLM為基礎,來微調出可供企業使用的小型模型;團隊將在今年10月啟用新一代H100 GPU來訓練大型模型的同時,利用替換下來的GPU訓練這款可商用的小型LLM。至於計價模式,李育杰表示目前尚無任何規畫。

第一時間與企業對話,公私協力貼近產業需求

吳政忠表示,TAIDE計畫之初,國科會就與企業溝通、了解生成式AI需求,如華碩、聯發科、鴻海等。華碩子公司台智雲上個月推出1,760億參數的國產LLM福爾摩沙大模型,並提供離線部署服務供企業選擇,華碩雲端總經理暨台智雲總經理吳漢章今日表示,TAIDE建立之初,團隊就參與討論,他認為公私協力非常重要,才能打造出符合企業需求的工具。

與此同時,華碩一方面摸索LLM服務商業模式,一方面也與聯發科、鴻海等對LLM底層防護機制感興趣的10幾家企業,準備組成聯盟(預計本周六宣布),來配合TAIDE主責單位研擬AI驗證機制。

另一方面,吳政忠也透露,TAIDE計畫目前投入2、3億元臺幣,雖然TAIDE模型效能無法與ChatGPT並駕齊驅,但重要的是,對嚴格限制境外LLM(如ChatGPT)使用的臺灣企業來說,本地開發的TAIDE就是一種解法。

玉山金控科技長張智星也在現場表示,金控就是受嚴格監管的產業,他們曾評估,若要自行開發ChatGPT,得花上1.2年,這還不包括重新訓練、所需電力等成本,金控也無法負荷訓練經費。但他認為,現在最重要的是「基礎模型的出現,」未來企業可用自己的資料微調。他也不擔心模型會給出錯誤答案,因為,金融業對資訊正確性非常講究,他們自己就有套機制,能阻擋生成式AI給的錯誤和不實資訊,不論是商用生成式AI服務還是開源AI,玉山金控都這麼做。

他也點出,雖然金管會將在9月開放金融上雲,但用來微調生成式AI的資料,仍有些機敏性,因此國產基礎模型的出現,可解決金融業的生成式AI使用痛點。

熱門新聞

2026-02-11

2026-02-11

2026-02-09

2026-02-10

2026-02-10

2026-02-06

2026-02-10

2026-02-10