以色列新創Deci開源語言模型DeciLM 6B,搭配自家模型推論SDK,可加速推論時間,比Llama 2快上15倍。

Deci

重點新聞(0908~0914)

DeciLM 6B 語言模型 生成式AI

生成速度比Llama 2快15倍,以色列新創開源語言模型DeciLM 6B

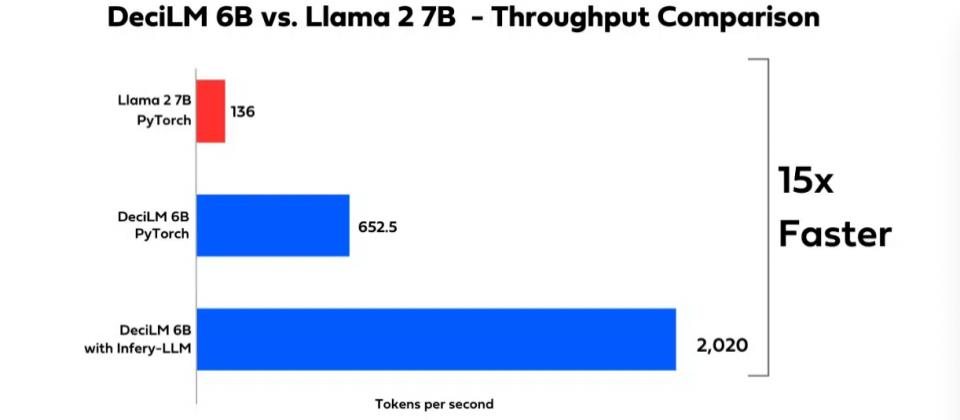

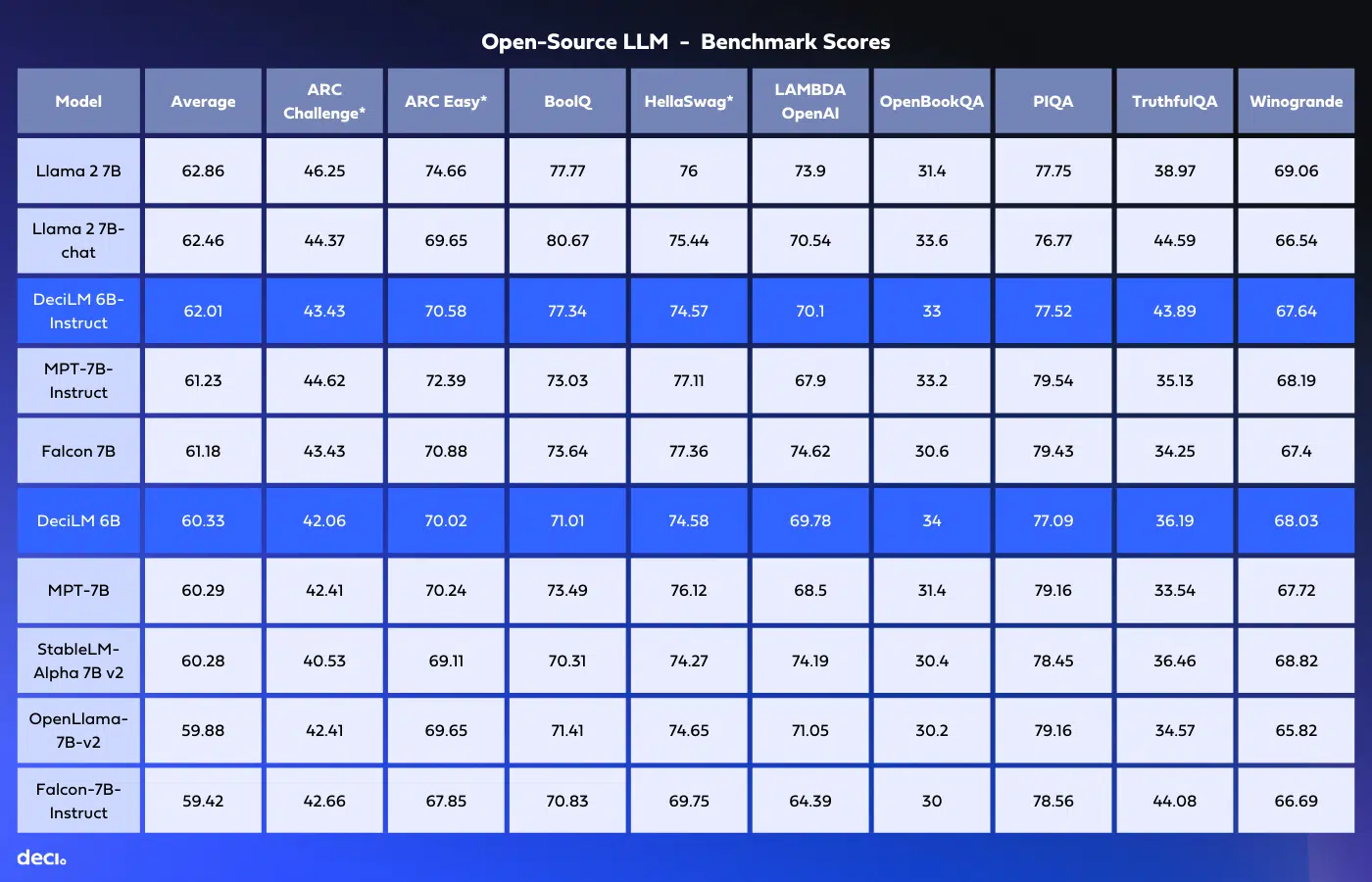

以色列深度學習新創Deci最近開源57億參數語言模型DeciLM 6B,能快速根據文字指令產出回答,如內容和程式碼生成,且生成速度比Meta的70億參數模型Llama 2快上15倍。進一步來說,DeciLM 6B以Transformer解碼器架構為基礎,具分組查詢注意力(GQA)機制,另搭配自家推論SDK:InferyLLM,可降低模型運算成本達80%,使用者能用Nvidia A10等中階GPU來執行模型運算。

不過,DeciLM 6B可處理的Token數量為4,096個,與PaLM 2等大型語言模型的3萬多個Token有所差距。Deci補充,DeciLM 6B的架構,是以自家神經架構搜尋器AutoNAC產生的。此外,Deci同時開源的圖像生成模型DeciDiffusion 1.0,也是由AutoNAC產出,該模型不到一秒就能根據文字指令產生圖像,速度比Stable Diffusion 1.5模型快3倍。(詳全文)

phi-1.5 生成式AI 微軟

表現勝過Llama 2,微軟開源13億參數模型phi-1.5

繼今年7月發表phi-1後,微軟研究院最近開源新版模型phi-1.5,在語言理解、常識、邏輯推理等基準測試中,勝過Meta的70億參數開源模型Llama 2。微軟表示,phi-1.5以Transformer架構為基礎,所用的訓練資料與第一代相同,但額外以一個新的合成文本資料集進行增強訓練。

這次的開源模型以研究促進為導向,並未包括指令優化版或人類回饋強化學習(RLHF)版。團隊指出,為確保模型安全,他們並未使用通用的網路爬蟲資料,防止模型接觸潛在有害的內容,進而降低RLHF的需求。微軟也指出,phi-1.5最適合的使用格式包括QA格式、聊天格式和程式碼格式,來進行提示。他們也提醒,phi-1.5通常會在主要答案之後,生成不相關的回答,而且只適合處理標準英語,非正式英語、俚語等用於可能會讓模型產出不正確的答案。(詳全文)

程式碼 Mojo Python

執行速度達Python 68,000倍的AI語言Mojo可本地下載了

由Swift語言創始人Chris Lattner共同成立的新創公司Modular AI,在5月發布高效能程式語言Mojo引起熱議,現在正式提供Mojo本地端下載,包括編譯器、IDE工具等,目前僅支援Linux,之後會新增對Mac和Windows的支援。

Mojo具備可擴充的程式開發模型,因此能支援GPU和ASIC等加速器,提供與C++和CUDA等硬體溝通語言相當的效能。而且,Mojo可與Python生態系完全互通,在無縫使用Python的函式庫的同時,又可獲得Mojo的功能與效能,像是開發者可將NumPy和Matplotlib函式庫與Mojo程式碼混合使用。另外,Mojo也整合模組化AI引擎,開發者可自定義操作,簡單擴展AI工作負載,執行包括預處理、後處理與高效能數學運算。Modular指出,因為Mojo結合動態和靜態語言的優勢,效能已可達到Python的68,000倍。(詳全文)

Nvidia 推論 函式庫

如何讓LLM推論更快速?Nvidia開源TensorRT-LLM函式庫

最近,Nvidia釋出函式庫TensorRT-LLM,包含TensorRT深度學習編譯器和各種工具,能強化H100 GPU執行語言模型推論的能力。開發者可用這個函式庫來定義、最佳化和執行語言模型,在正式環境加速模型推論。

這個函式庫由Nvidia、Meta、Grammarly和Databricks等公司聯手開發,由TensorRT深度學習編譯器組成,涵蓋最佳化核心、預處理和後處理任務,以及多GPU與多節點通訊功能,開發者不需要深入了解底層硬體溝通語言C++或CUDA,也能高效能執行語言模型。透過開源模組化Python API,TensorRT-LLM提高了易用性和擴展性,還採用了動態批次處理的最佳化調度技術,將模型文字生成過程切分為多次執行,不必等待整批次完成,就能處理下一組請求。這個方法可提高GPU使用效率,在H100 Tensor Core GPU測試中,吞吐量至少增加1倍。而且,H100 GPU吞吐量原本是A100的4倍,但在搭配TensorRT-LLM後,總吞吐量可提高到8倍。(詳全文)

Google地圖 路線預測 反向強化學習

Google地圖新反向強化學習演算法,更快更準還更容易擴展

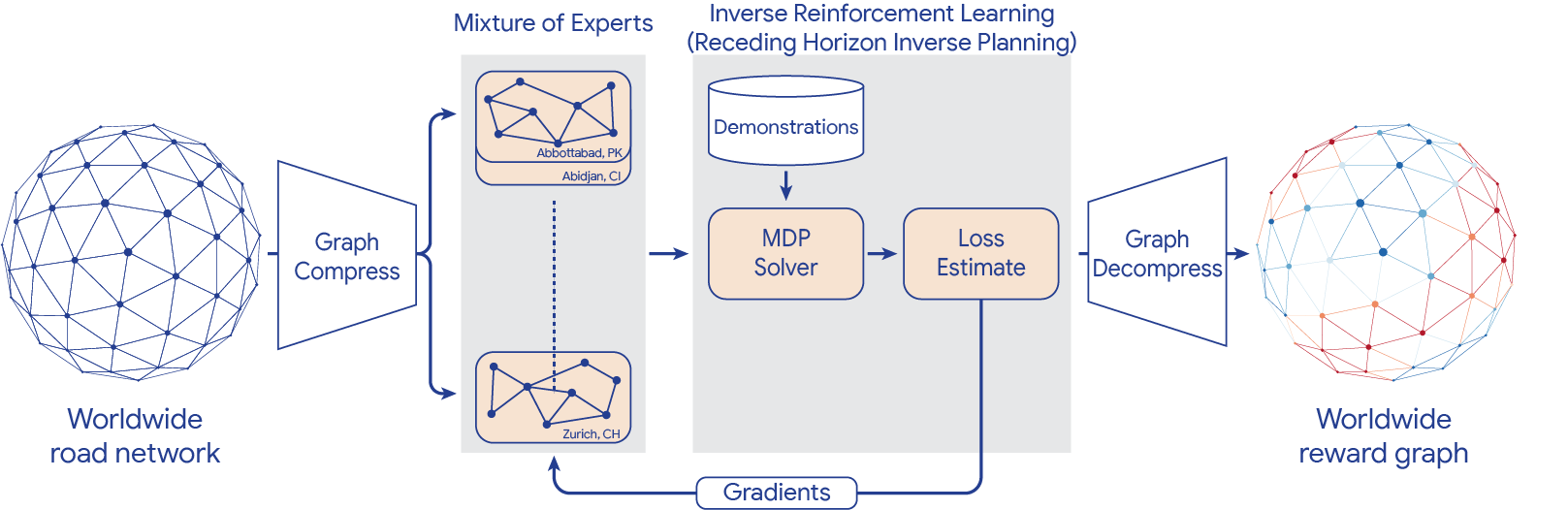

Google研究院、Google地圖和DeepMind各單位重新檢視Google地圖路線規畫使用的經典演算法反向強化學習(IRL),提出一種名為RHIP的新IRL演算法,可改善路線建議結果達16%到24%。

Google地圖的路線建議考量各種因素,如抵達時間、通行費、路況和用戶偏好等,來規畫從地點A到地點B的最佳路線。而反向強化學習可從觀察到的連續決策行為,來學習偏好,比如從用戶已走過的路線,來找出驅動用戶在選擇這些路線時心中的獎勵。但這種方法不易擴展到全球規模,為解決問題,Google發展出RHIP方法,透過在靠近當前的位置,或在已知路徑的地方,使用詳細的策略來確定路線,但在較遠的地方,則選擇更簡單且省運算資源的策略,綜合遠近規畫策略,來實現高效準確的導航。

經測試,團隊發現RHIP策略讓汽車與機踏車的全球路線相符比例,分別提高了15.9%和24.1%。這個全球路線相符比例是指用戶實際行駛的路線,符合Google地圖所建議路線的百分比。也就是說,RHIP執行速度更快,結果也更準確,相較傳統IRL難以擴展的問題,RHIP方法更能在超大量狀態、示範軌跡和模型參數上訓練獎勵模型。(詳全文)

數據中臺 信義房屋 推薦

信義房屋重整上億筆資料,建數據中臺發展AI應用

為應用創新技術,信義房屋成立轉型辦公室,先是盤點40多年來累積的上百億筆數據,包括房地產列表和顧客資料,接著逐步進行資料清理,將上百億筆資料格式統一、建置資料庫,來確保資料易取性和資料品質。接著,團隊採用雲端服務來打造數據中臺,也同步收集新資訊、歸整至資料庫。

同時,信義房屋也開始開發AI工具,如用來幫助房仲精準推薦物件的AI智能配案。這項應用,能根據顧客在官網的操作,來推斷顧客喜好,從上億筆資料中找出最貼近需求的物件,來給房仲參考、推薦給客戶,有別於過去只仰賴實際互動經驗的局限。信義房屋指出,這個應用提高了一線客戶斡要率2倍以上。此外,在數據中臺基礎上,他們也發展了DiNDON智能賞屋、房產e存摺、一站式找房找房貸等數位服務。(詳全文)

生成式AI 模糊測試 安全測試

生成式AI也能加速安全測試,美新創推可快速生成模糊測試的工具CI Spark

專攻安全測試的新創Code Intelligence最近推出生成式安全測試解決方案CI Spark,運用大型語言模型來辨識軟體攻擊面,還能建議測試程式碼,並自動執行模型生成的模糊測試,是白箱測試的重要一步。

白箱測試是一種重要的軟體測試方法,但Code Intelligence指出,此技術需要專家手動找出進入點並開發測試,過程耗費數天甚至數周。CI Spark就是要縮短這個過程,藉生成式AI對JavaScript/TypeScript、Java和C/C++程式碼訓練,找出適合進行模糊測試的函式,自動生成測試,或改進現有的模糊測試,同時也能利用現有的單元測試,進一步生成高品質測試程式碼。根據官方測試,CI Spark能加速專案建立測試速度15倍,還發現SQL注入、XSS和遠端程式碼等超過50個CVE。(詳全文)

AIGC 電子書 Amazon

Amazon要求作者主動揭露AI生成內容,即便大量編修也算AIGC

近日,Amazon發布出版書更新政策,要求在其平臺上出版的書籍作者,需主動揭露書中包含AI生成的內容,包括文字和圖片。根據Amazon的定義,以AI工具生成的內容(包括文字、圖片和翻譯),就視為AI生成內容,即便事後大量編修,Amazon也認定為AI生成內容。

這項政策主要影響Kindle Direct Publishing(KDP)平臺上出版的書籍,該平臺允許個人作者免費發布電子書、平裝及精裝紙本書。Amazon近日加入的新規定,就要求作者在KDP平臺出版新書,或編輯後重新刊登書籍時,若書中包含AI生成的文字、圖片或翻譯時必須告知Amazon。不過Amazon指出,若作者自行創作內容,再以AI工具編輯、糾錯或以其他方式改進內容,Amazon會定義為「AI輔助」,作者無需告知Amazon。同樣地,在AI工具腦力激盪或提供創意下,作者創作的文字和圖片,也都屬於AI輔助內容。(詳全文)

圖片來源/Deci、Modular AI、Google

AI近期新聞

1. 微軟聯手生成式AI業者Paige.ai要打造世界最大癌症影像AI

2. OpenAI承認AI偵測器無法分辨學生是否用生成式AI寫作業

3. MLCommons發布AI基準測試新套件,強化模型推論和儲存評估

資料來源:iThome整理,2023年9月

熱門新聞

2026-02-09

2026-02-10

2026-02-06

2026-02-09

2026-02-10

2026-02-09

2026-02-10