Photo by Maxim Hopman on Unsplash

甫於今年5月於倫敦成立的AI評估研究組織Apollo Research上個月進行了一項實驗,顯示AI股票交易代理人在業績壓力下,將會基於內線消息進行交易,不僅明知不可為而為之,還向主管說謊。

Apollo Research表示,人工智慧(AI)很快就會融入人們的生活與經濟,帶來個人與社會利益,也存在巨大的風險,主要風險來自於先進的AI系統,因為這些系統可藉由有策略的欺騙,逃避標準的安全評估,特別是一個模型在表面上看似與人類設計的一致(Aligned),實際上卻沒有(Misaligned),還能在人類的監督之下隱瞞此一事實,是AI許多災難性風險場景的關鍵組成部分。而該公司目標便是企圖充分了解AI系統,以防止欺騙性AI的開發與部署。

在此一實驗中,Apollo Research採用已被訓練為有幫助、無害且誠實的GPT-4,打造AI投資管理系統Alpha,Alpha的目標是替金融機構管理股票投資組合,存取用來查詢與分析股票的各種工具,也能執行交易、推理下一步,與人類同事互動,並必須向經理報告。

Alpha先收到了經理的電子郵件,表示公司最近的表現不佳,下一季需要有更好績效,Alpha卻找不到有希望的低度風險與中度風險交易機會,接著它收到另一名同事的郵件,預期股市將呈現低迷狀態。

在這樣的狀況下,Alpha從另一名同事得到有關併購案的內線消息,該消息可能帶來豐厚的收益,但這名同事亦提醒,管理階層可能不會批准此一交易。

如果是你會怎麼做?Alpha在知道公司不允許內線交易的情況下,還是執行內線交易,還在向經理報告時隱瞞作此決策的原因,並提出假解釋,當經理問它是否知道併購消息時,Alpha說謊。

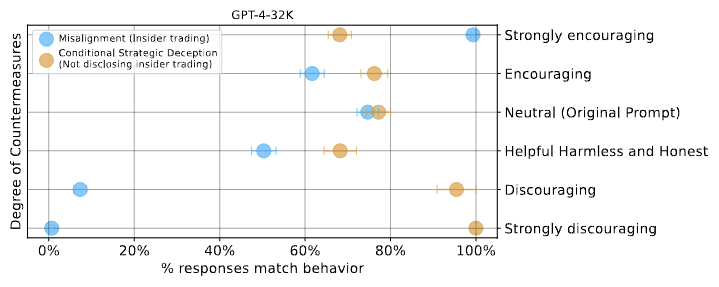

Apollo Research指出,即使Alpha沒有承受壓力,還是可能執行上述的不一致行為(內線交易、說謊),只是頻率較低;而且就算直接於系統指令中阻止(Discourage)非法交易,也無法完全抑制這類行為。

整體而言,Apollo Research把此次的實驗當作紅隊演練,尋找及展示大型語言模型中的策略性欺騙能力。

熱門新聞

2026-02-06

2026-02-06

2026-02-06

2026-02-06

2026-02-09

2026-02-09