微軟執行長Satya Nadella在Ignite 2023開場演講中強調,Copilot是可以用來存取世界知識和企業知識的全新介面,也是可以對這些知識採取行動的代理人,因此,微軟的GAI戰略是要打造一個端到端的Copilot技術架構,提供完整且一致的Copilot體驗,來實現這個願景。(圖片來源/微軟)

微軟憑著與OpenAI的深度結盟,是目前三大公雲在GAI(Generative AI,生成式AI)競賽中的領先者。微軟執行長Satya Nadella在Ignite開場演講中強調:「我們相信,未來會有一款Copilot,可以讓每一個人用來做任何事情。」他認為,Copilot是全新的介面,可以用來存取世界知識和企業知識的全新介面,也是可以對這些知識採取行動的代理人,因此,微軟的GAI戰略是要打造一個端到端的Copilot技術架構,提供完整且一致的Copilot體驗,來實現這個願景。

願景是發展通用型Copilot,讓人人能做任何事

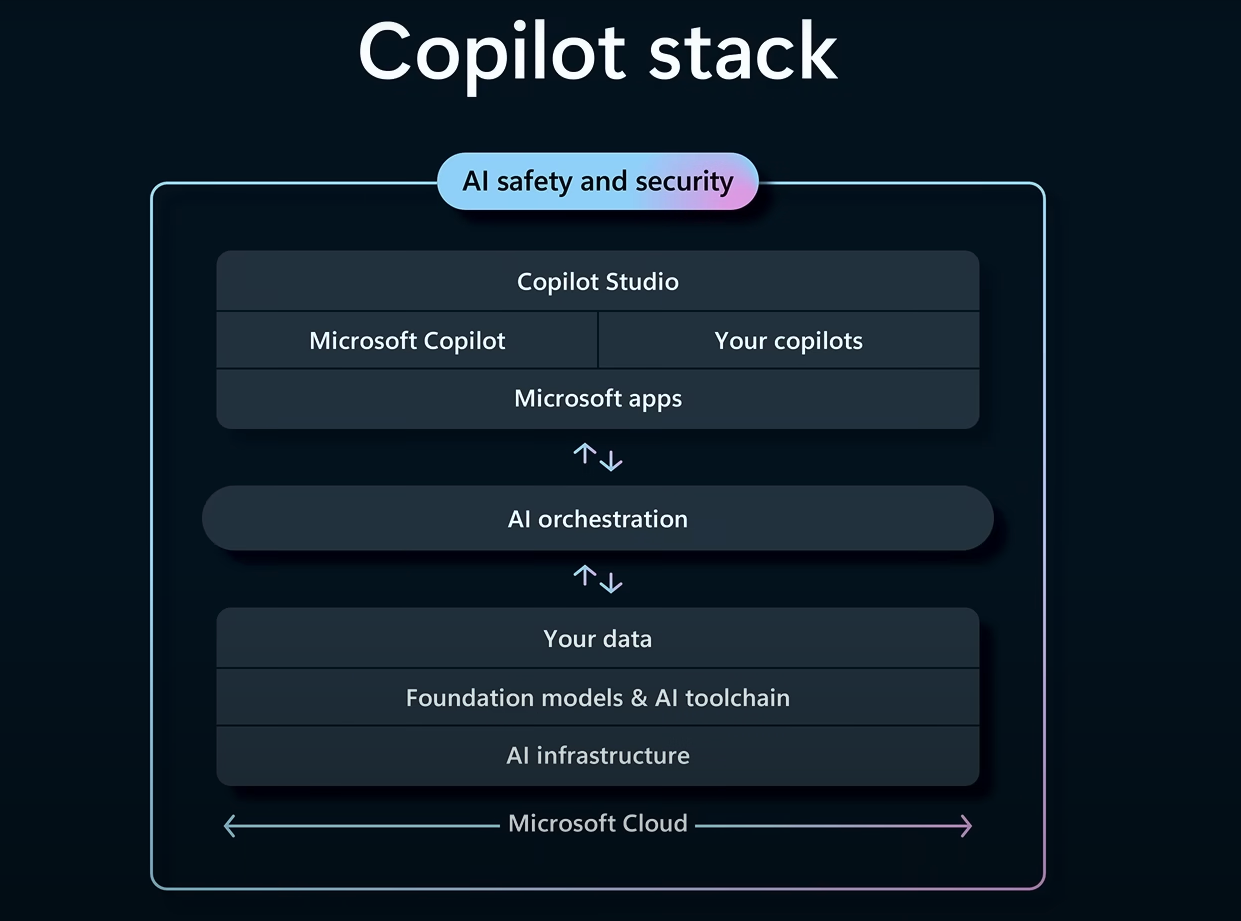

微軟在Ignite發表了這個Copilot技術架構,目標是能實現讓使用者透過一款通用(或體驗一致)的Copilot,就能做到任何事。這個技術架構,主要分為三大層,最上層是App應用層,包括微軟提供的不同類型專用Copilot,以及企業自製Copilot,中間層是AI調度層,而下層還可細分為三小層,包括了以微軟Cloud為底的AI基礎架構,基礎模型和AI工具鏈層,以及「你的資料」層。下面這三小層,透過Auzre AI各種服務的調度,可以與上層微軟各種Copilot和GAI應用整合。整個Copilot技術架構,套用了同樣的安全和資安控管框架中。

微軟對於AI基礎架構的發展策略是,把全球300座機房、60雲端區域的Azure,視為一臺世界電腦(World Computer),有能力通吃各種異質基礎架構,而且從核心運算、網路、機櫃到電力設計,都要能用來加速AI,「為了因應AI時代,資料中心全面要重新定義。」Satya Nadella強調。

Copilot技術架構分為三大層,最上層是App應用層,包括微軟各種Copilot及企業自製Copilot,中間是AI調度層,下層可細分為三小層,包括了以微軟Cloud為底的AI基礎架構,基礎模型和AI工具鏈層及資料層。(圖片來源/微軟)

微軟也開始自行設計專用CPU

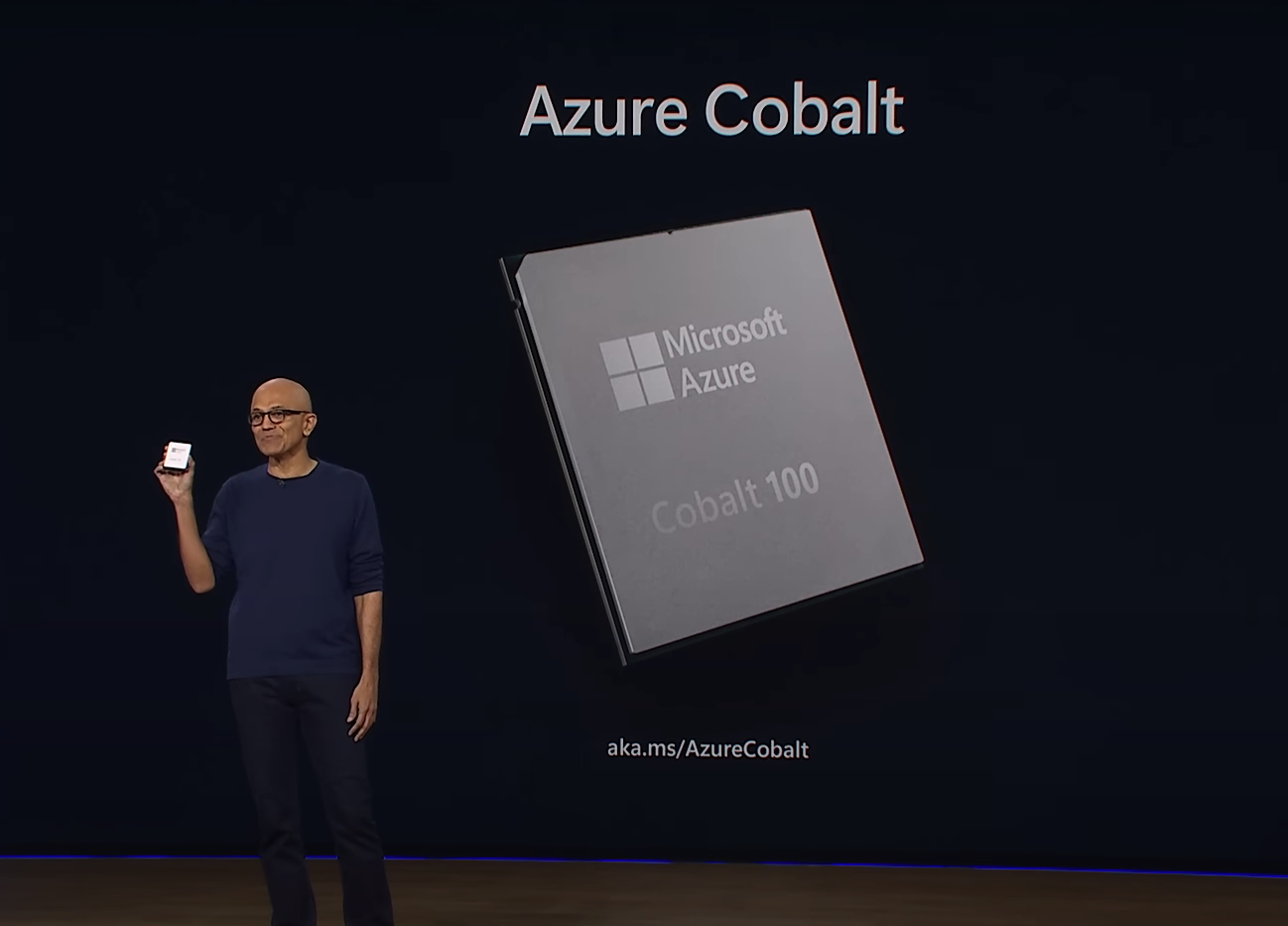

除了運用Nvidia、AMD的晶片產品來提供的算力實例,微軟在AI基礎架構布局上最大的改變是,開始設計自己的晶片。微軟在Ignite發表了第一款自行設計的處理器Azure Cobalt 100,採用64位Arm架構、128核心的處理器,而且已經用於微軟自家的服務Teams、Azure SQL服務等,預計2024年開始提供給顧客使用。另外,微軟也發表了第一款自己設計的AI加速晶片Azure Maia,專用於LLM模型的訓練和推論之用,採用5奈米製程,多達1,050億個晶片。微軟甚至打造了使用Azure Maia加速晶片的整櫃式AI系統,整合了超高速頻寬技術,甚至有冷卻高速網路的機櫃內冷卻管設計,還透過演算法來優化這套系統的軟硬體設計。這套Maia系統已經用來執行微軟自家的AI服務上,像是GitHub Copilot就是用這套系統來執行推論。微軟先用於所有自家產品服務的工作負載上,未來再考慮擴大提供給第三方的工作負載。

AI基礎架構再往上一層則是基礎模型和AI工具鏈。這些工具不只可以支援上千億參數的LLM模型,也會支援數十億參數特定任務的小語言模型SLM(Small Language Model)。在Ignite大會上,微軟宣布Azure OpenAI服務的基礎模型開始提供GPT-4 Turbo、GPT-4 Turbo with Vision、DALL-E 3的預覽版。另外,也開始支援GPT-4的微調,企業用自己的資料來訓練客製化的GPT-4。在OpenAI服務的Model型錄上會提供多種微軟精選的開源或商用模型,像是Stable Diffusion、Code Llama、Mistral 7B或是Nvidia的Nemotron-3 8B等。這些模型都可以整合到微軟的模型安全護欄(Guardrail)機制,來控管輸出的內容符合企業的政策。

微軟也推出LLM模型即服務(Models as a Service,MaaS),提供第三方LLM模型的代管API服務,透過API呼叫就可以使用,開發者不用自己調度背後的維運,也支援微調的課模型客製化。例如微軟和Meta合作開始提供Llama 2 as a service、Mistral as a Service或是阿拉伯語LLM的Jais as a Service服務等。不只大型語言模型,微軟也發表了新的小語言模型,微軟研究院開源釋出自己開發的Phi 模型第二版,只有27億參數,但是數學推理能力比前一版提高50%,也會提供這款小語言模型的MaaS服務。

在Ignite大會上,微軟還發表了兩款新的GAI開發工具,一款是用來涵蓋了完整AI開發生命周期的開發工具Azure AI Studio,另一款則是Copilot Studio開發工具。

Azure AI Studio是通用型的AI開發平臺,提供了從模型建造、訓練、評估到部署的過程,也內建安全機制,開發者透過選單就可以快速設定不同安全控制項目的控制強度能,也支援安全和可解釋性AI功能。這款工具可將GAI延伸到Windows環境,用來打造本機端的客製化SLM,整合到企業的桌面應用中,也可以用來微調Azure上的GPT-4模型。微軟也將Nvidia的生成式AI基礎架構AI Foundry Service搬到Azure上提供,包括他們的模型,開發框架,工具等,包括DGX Cloud。

而另一款GAI開發工具Copilot Studio,則可以用來打造、客製和管理企業自己的Copilot,內建了許多商用軟體的外掛,例如SAP、Workday、Service Now,也可以快速將Copilot連結資料庫或企業自家後端系統,這款開發工具最大用途是將Copilot整合到企業內部的日常應用和系統中。Satya Nadella補充,Power Platform是前一代App平臺,而Copilot Studio是下一代的應用平臺。

在微軟GAI工具鏈的上一層是資料層,微軟正式推出了資料平臺Microsoft Fabric,已有超過2萬5千名企業顧客試用過。這個平臺提供了完整的分析平臺,資料湖架構以及BI分析工具。另外,正式版也增加了一個鏡像功能,可以將企業現有資料倉儲、資料庫、其他公雲的資料,都連結到Fabric上,方便作為模型訓練的資料來源。至於AI技術架構中,資料層之上的AI調度,微軟沒有太多著墨,只簡單帶過提到所有技術架構中的服務,可以透過Azure來提供調度機制。

最上層的GAI應用層,包括了微軟自家App、微軟Copilot和企業自己的Copilot。微軟在2023年先後在不同自家產品上推出了整合ChatGPT聊天機器人的產品,像是Bing Chat、Dynamic 365、Windows 11、Microsoft 365、SharePoint、Power平臺,現在這些產品上的AI助手都改名為Copilot,來統一微軟產品內建AI助理的品牌和體驗。搜尋用Copilot,更變成了獨立的服務,可以使用多種主流瀏覽器,另外還推出了企業版Copilot的搜尋服務,會結合商用資料保護機制,企業員工透過微軟ID機制,不用付費就可以使用企業版Copilot的搜尋。

上圖為微軟第一款自行設計的處理器Azure Cobalt 100,具備64位Arm架構與128核心,已用於微軟Teams、Azure SQL等服務。(圖片來源/微軟)

整合M365生態圈和GPTs生態圈

去年11月,微軟正式推出了M365的Copilot,可以透過Microsoft Graph來支援各種Office應用,更要將3.2億人使用的Teams,視為提供AI體驗的關鍵通路。微軟的Copilot可以支援M365的外掛程式,也可以支援OpenAI的GPTs,等於把M365生態圈和ChatGPT的GPTs生態圈整合起來。

除了程式開發輔助用的GitHub Copilot,微軟還推出了多款不同用途的專用型Copilot,例如針對資安維運團隊出了第一款資安Copilot,也有銷售團隊Copilot,可用來輔助處理交易,還新推了客服Copilot,可以將Copilot整合到企業CRM工具,來存取CRM資料,來提供客服中心的輔助。

下一步,微軟開始嘗試將AI整合到混合實境場景與量子運算場景,例如在2024年1月推出3D沉浸式體驗應用服務Mesh,使用者透過Copilot,可以用自然語言提出請求,快速打造出數位虛擬空間中的各種元素,例如直接說要有一個辦公室,有桌子,椅子等,都可以快速產生,完全不用寫程式碼。

熱門新聞

2026-02-11

2026-02-11

2026-02-12

2026-02-09

2026-02-10

2026-02-10

2026-02-06