資安業者Wiz曾針對譽為AI界GitHub之稱的Hugging Face平臺進行調查,揭露該平臺有可能允許駭客透過惡意模型進行跨租戶攻擊的情況,並指出這種提供AI有關服務的平臺資安弱點,並非只有Hugging Face獨有,本週他們公布另一個開源AI模型共享平臺Replicate的弱點,攻擊者也有機會透過惡意模型上下其手。對此,今年1月Replicate獲報後已迅速緩解相關弱點,並表示沒有用戶資料外流的跡象。

研究人員指出,為了能容易執行AI模型的推論(inference),Replicate採用了專屬的模型容器化格式Cog,這種格式能協助使用者將AI模型容器化,並納入正確的相依性套件與程式庫,以及RESTful HTTP API伺服器。一旦將模型轉換成Cog格式,用戶就能將其上傳到Replicate,以便進行後續操作。

為了驗證這樣的機制是否能防範有心人士在此發布具有惡意的AI內容,他們上傳惡意的Cog容器,並透過Replicate的使用者介面與容器互動,從而利用Replicate的基礎設施遠端執行程式碼(RCE)攻擊。

在這之後,研究人員取得容器的root權限,並針對該平臺的基礎設施進一步調查,發現該公司採用Google Cloud Platform代管Kubernetes叢集,接著,他們針對網路環境進行研究,結果發現容器已建立TCP連線,而該連線卻是由不同的PID名稱空間執行的處理程序進行處理。研究人員表示,這代表有另一個容器與他們共用網路名稱空間。

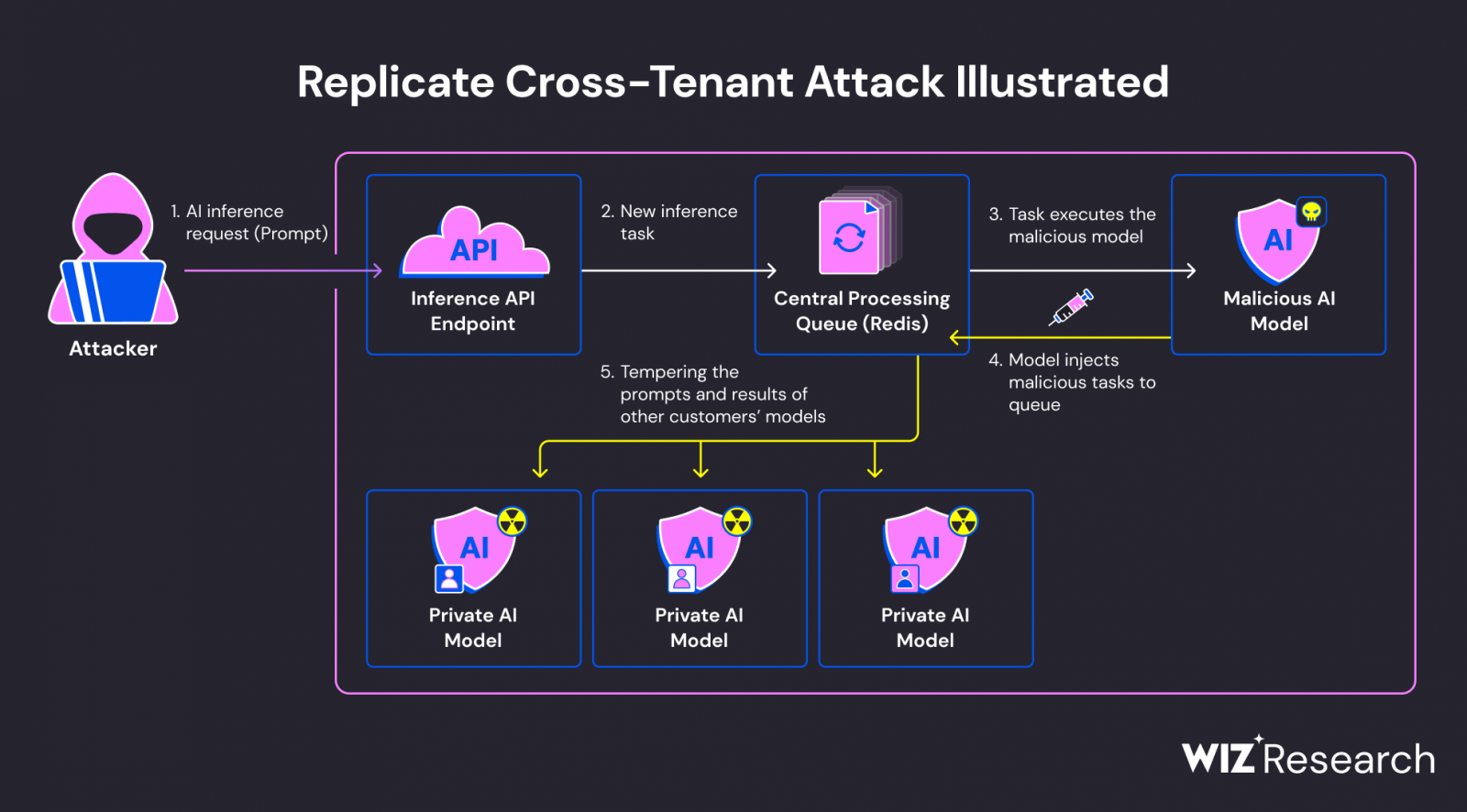

由於他們已得到容器的root權限,研究人員藉此檢查TCP連線內容,從而得知另一臺容器其實是Redis主機,而這臺伺服器通常會多個用戶提供服務,而讓他們發現有機會對其他用戶下手。

研究人員透過名為rshijack的TCP命令注入工具,將特定資料注入Redis伺服器的TCP連線,從而繞過身分驗證,從而對他人的AI模型下手。

而對於這項弱點帶來的影響,研究人員指出,攻擊者竟然可查詢其他用戶在此存放、僅供自用的AI模型,從而曝露模型訓練過程有關的專屬知識及敏感資料,或是攔截提示資料,而有可能操縱人工智慧的行為並破壞模型的決策流程,直接左右輸出結果的準確性、可靠性,並破壞自動化決策的完整性。

熱門新聞

2026-02-09

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-06

2026-02-09