背景圖片來源/Dynamic Wang on Unsplash

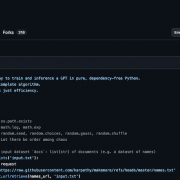

紐約時報報導,OpenAI於2023年遭駭客存取公司系統,但該公司認為不嚴重而未公告亦未通報主管機關。不過OpenAI因此事後因相關事件解僱了員工。

報導引述消息人士指出,OpenAI去年被一名外部人士存取了內部系統,但並未存取開發和儲存ChatGPT或其他AI系統的系統,而是員工討論區。OpenAI認為,由於並沒有涉及敏感資訊,且存取者是一個人而非已知駭客組織,故OpenAI認為這並非重大安全事件,因而未公開此事,也未通報主管機關或聯邦調查局(FBI)。

但是有員工仍對此感到憂心而提出建言,不過遭到公司懲處。OpenAI前技術計畫經理Leopold Aschenbrenner上周在其podcast討論此事。Aschenbrenner是公司AI superalignment團隊成員。Superaligment是OpenAI為了在AGI發展過程中,確保AI符合人類利益而推動管理及安全設計而設立。Aschenbrenner也是今年稍早離職的OpenAI首席科學長Ilya Sutskever的重要副手,後者和執行長Sam Altman因AI安全理念不和而另創公司Safe Super Intelligence。

Aschenbrenner提及,他在公司一起「重大資安事件」後,向公司董事會提出呼籲。他將一份OpenAI建構AI模型防護的備忘錄分享給了董事會成員,他事後公布備忘錄內容,其中並無涉及技術或商業敏感內容。但董事會為此問責公司的AI倫理措施是否確實,包括現有保護機制是否足以阻擋中國國家駭客的間諜入侵,顯然這令高層不滿,他在今年4月和另一名員工被HR解聘,理由是洩密為由解聘。

OpenAI尚未對此回應。

Techcrunch指出,這事件也顯示,像OpenAI這類擁有眾多AI技術及用戶的供應商,對駭客來說是多麼令人垂涎的攻擊目標。

熱門新聞

2026-02-11

2026-02-12

2026-02-11

2026-02-10

2026-02-09

2026-02-13

2026-02-10