國科會

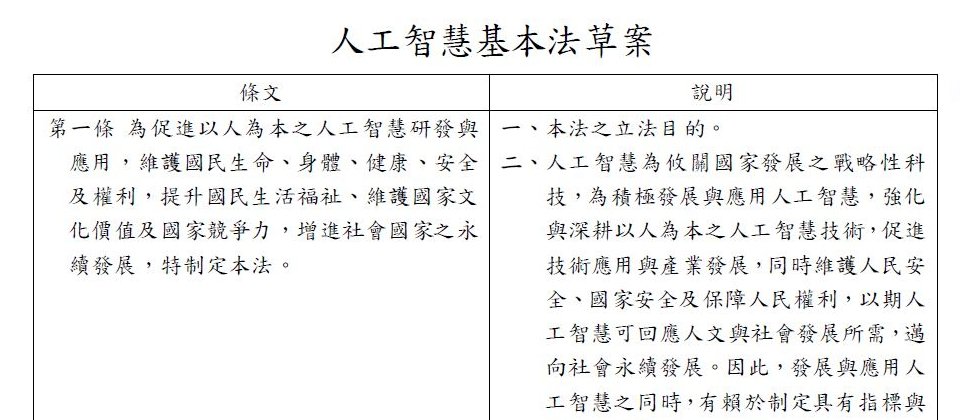

趕上其他國家發展腳步,在蒐集各方意見,參考國外立法內容後,國科會終於在今天(7/15)預告我國人工智慧基本法草案,作為我國發展與促進人工智慧應用的原則,該草案揭露我國AI發展的7大原則及4大推動重點,共計18條條文,預告60天,後續施行日將由行政院決定。

國科會表示,AI在氣候變遷、環境、醫療、金融、交通、內政、農業、公共服務等各領域均對民眾帶來影響,對社會及經濟帶來效益的同時,也可能衝擊及風險,因此各國研擬對AI的治理及方針,例如歐盟在2021年提出AI法案(Artificial Intelligence Act),並在2024年通過審議,美國也在2023年提出AI行政命令,目的為推動聯邦部門使用安全且可信任的AI。

國科會從前任主委吳政忠開始,便跨部會討論,並蒐集外界意見,同時參考國外立法,研擬我國的AI基本法,原本國科會預期在今年10月提出草案,在各界期望下提前研擬草案,提出我國對AI研發及應用的基本原則,政府推動重點。

揭示永續、人權、隱私保護、問責等7大原則

AI基本法首先對AI定義為,以機器為基礎的系統,該系統具備自主運行能力,透過輸入或感測,經由機器學習及演算法,提供明確或隱含的實現目標的預測、內容、建議或決策,影響實體或虛擬環境的產出,有別於其他軟體系統。

基本法的第3條主要提出我國發展AI技術及應用應遵循的7項基本原則,包括永續發展、人類自主、隱私保護及資料治理、資安與安全、透明與可解釋、公平不歧視、問責。

首先是永續發展原則,AI研發及應用需兼顧社會公平、環境永續,通過適當的培訓,降低AI帶來數位落差的影響;另外,AI發展應尊重人類自主,例如自主權、人格權等基本人權與文化價值,並且可受人類監督,以人為本,法治及民主價值觀。

在隱私保護及資料治理原則上,由於AI發展不可避免涉及資料蒐集,需遵守隱私保護及資料治理,避免資料外洩風險、採用資料最小化原則,相對地,也促成非敏感資料開放及再利用。資安與安全的原則,要求在人工智慧研發及應用的過程,應建立資安防護措施,防範安全威脅及攻擊,確保系統的穩健性及安全性。

透明與可解釋原則,要求對AI產出的資訊內容作適當的資訊揭露或標記,以利評估可能的風險及影響,提升對AI的可信任度。公平不歧視原則要求AI研發及應用應應避免演算法產生偏差或歧視風險。最後的問責原則,要求承擔相應的責任,包括內部治理及外部社會責任。

建立風險分級管理框架,由目的事業主管機關提供AI創新實驗環境

此外,該草案也明示4大推動重點,包括創新合作及人才培育、風險管理及應用負責、權益保障及資料利用、法規調適及業務檢視。

政府應在AI推動上扮演更積極的角色,鼓勵AI研發、應用及基礎建設、資源分配、產業輔助等等,並且依AI作法規調適。此外,參考歐盟AI法案鼓勵會員國政府提供可受控制的AI實驗沙盒制度,為鼓勵創新及永續發展,我國AI基本法草案以政府鼓勵創新,各目的事業主管機關提供AI研發及應用服務的創新實驗環境。

政府應對AI應用帶來的歧視、偏差風險,或對民眾造成的生命、財產等損害提出建議或驗證的工具或方法;另外,該草案也希望建立我國的AI風險管理框架,由數位部參考其他國家或經濟體對AI提出的風險分級、管理框架,建立與國際對接的管理框架,讓各目的事業主管機關得以風險分級框架就主管業務訂定風險分級規範。

政府各機關或機構對其業務及服務使用人工智慧,建立風險評估及因應措施,應建立使用規範或內控管理機制。AI基本法草案其他條文也涵蓋AI可能的衝擊及政府的角色,包括勞工權益、建立民眾的AI素養、個資保護、資料治理等等。

熱門新聞

2026-02-09

2026-02-06

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-09