去年才成立的Mistral AI腳步飛快,於本周三(7/24)推出了具備1,230億個參數,支援12.8萬個Token脈絡長度的Mistral Large 2 ,此一Mistral AI的旗艦模型宣稱已可比美OpenAI的GTP-4o及Meta剛開源的Llama 3.1 405B。

Mistral Large 2支援包括中文、日文、韓文及德文等數十種語言,以及涵蓋Python、Java、C、C++、JavaScript與Bash等逾80種程式語言,它在設計時即著眼於基於長脈絡應用的單節點推論,其預訓練版本的MMLU基準測試準確率為84%,低於Llama 3.1 405B的88.6%,或是GPT-4o的88.7%。

不過,Mistral AI強調Mistral Large 2在程式碼及數學上的表現,足以比美同為開源模型的Llama 3.1 405B;也投入了大量資源來強化模型的推論能力,重點之一是盡量減少模型虛構答案,以確保它提供可靠及準確的輸出;另也改善了Mistral Large 2在指令遵循與對話上的能力。

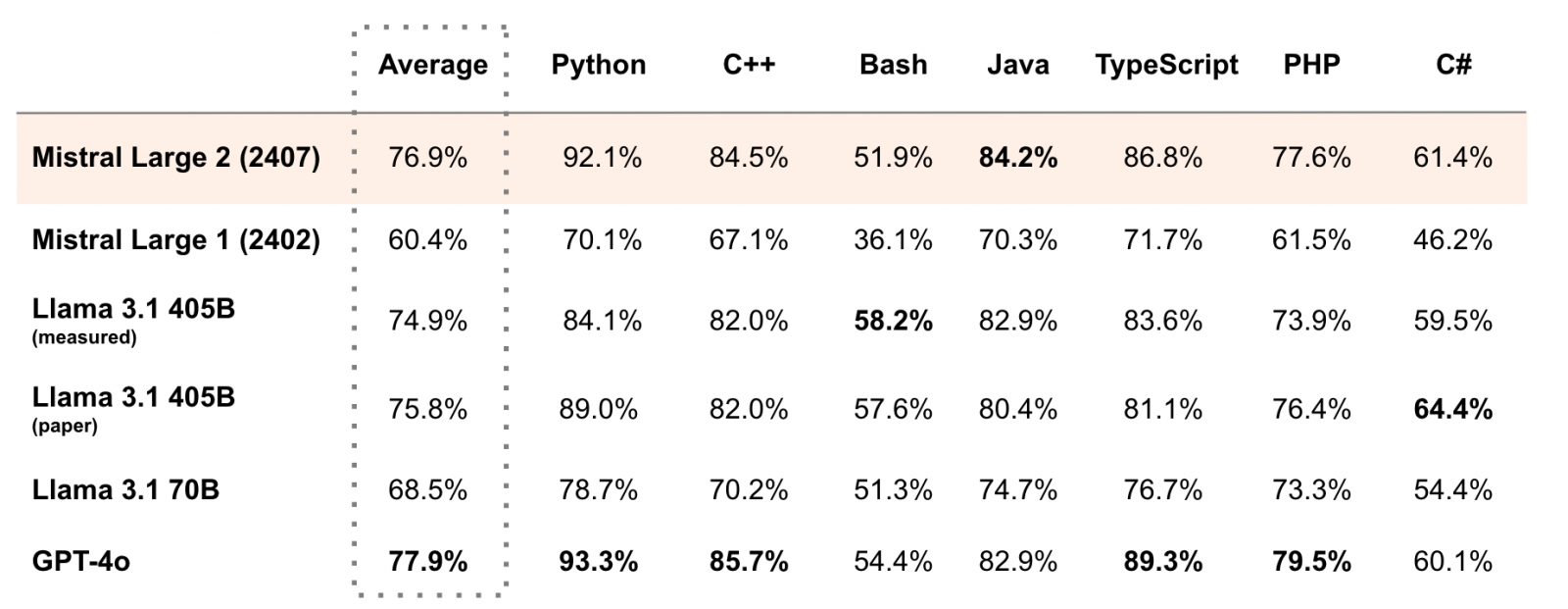

Mistral AI比較了Mistral Large 2、Llama 3.1 405B及GPT-4o在C++、Bash、Java、TypeScript、PHP與C#的程式語言的表現,平均表現最好的是GPT-4o的77.9%,Large 2以76.9%居次,Llama 3.1 405B則是74.9%。若單看不同的程式語言,Mistral Large 2在Java的表現最佳,準確率高達84.2%,勝過GPT-4o與Llama 3.1 405B的82.9%。

圖片來源/Mistral AI

至於GPT-4o則是在C++、TypeScript或PHP上的成績居冠,Llama 3.1 405B在Bash上取得領先。

Mistral Large 2採用的是Mistral研究授權,代表可供研究與非商業的免費使用或變更,商業授權則必須與Mistral AI接洽。

熱門新聞

2026-02-02

2026-02-03

2026-02-04

2026-02-02

2026-02-04

2026-02-03

2026-02-05