史丹佛大學團隊發表一款電腦視覺模型LogicTreeNet,結合邏輯閘網路和卷積網路,不僅模型小巧快速,還維持辨識精準度。在MNIST測試中,推論速度比SOTA模型快上160倍。

重點新聞(1108~1114)

推論速度 電腦視覺 LogicTreeNet

又快又小又準確,史丹佛大學提出另類電腦視覺模型

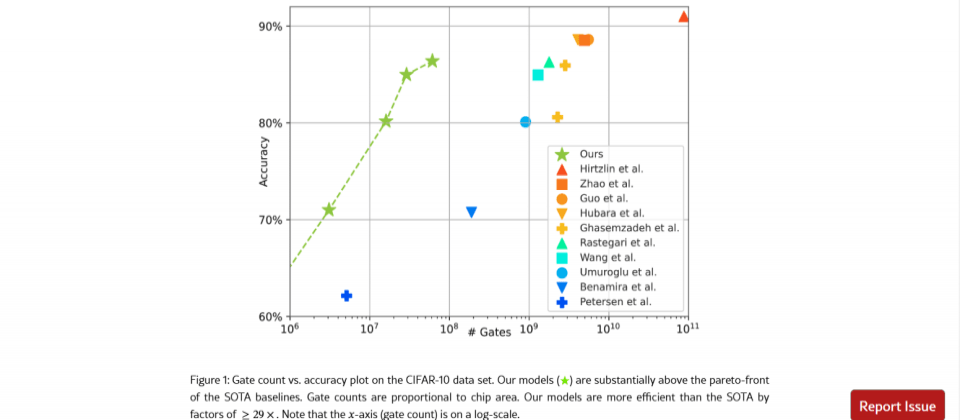

最近,史丹佛大學發表一項電腦視覺研究成果,整合了卷積網路和邏輯閘網路(Logic Gate Networks,簡稱LGNs),打造出名為LogicTreeNet的卷積可微分邏輯閘網路。在CIFAR-10測試中,這個網路只需6,100萬個邏輯閘,就能達到86.29%的辨識準確率,比SOTA高階模型表現更好,且模型還小了29倍,適合用於運算資源有限的場景。

團隊解釋,之所以會開發LogicTreeNet,是因為LGNs的運算速度,比傳統神經網路方法還要快許多。因為LGNs要執行推論,只需NAND、OR和XOR等邏輯閘運算子,而這些運算子是目前硬體溝通的重要元素,換句話說,這類網路在硬體執行上,比傳統網路更有效率。於是,團隊在這個基礎上,用深度邏輯閘樹卷積、邏輯OR池化、殘差初始化等3種方法,來將LGNs結合電腦視覺的卷積網路,並大規模擴展。

其中,殘差初始化可在深度網路中,盡可能保存資訊,防止梯度消失。而邏輯OR池化結合邏輯樹內核,可大幅提高訓練效率。經團隊測試,LogicTreeNet在MNIST測試中,推論速度比SOTA模型快上160倍,而在CIFAR-10測試中,則快上1,900倍。(詳全文)

AlphaFold 3 Google DeepMind 蛋白質結構

DeepMind開源學術版AlphaFold 3模型

Google DeepMind最近開源AlphaFold 3模型程式碼,供學術界研究者下載、進行蛋白質結構預測的相關研究。AlphaFold 3是一款可預測蛋白質和重要分子(如DNA、RNA、小分子等)三維結構及其交互作用的模型。

而且,有別於只能預測單一蛋白質結構的AlphaFold 2,AlphaFold 3進一步提升對複雜分子交互作用的模擬能力,研究者更能理解分子如何在細胞內互動,進而推動藥物開發和疾病治療的研究。之前,DeepMind只透過伺服器來提供AlphaFold3的預測服務,也限制預測的數量和種類。但在學界呼籲下,DeepMind重新評估該項政策,日前決定開放模型程式碼,供具學術資格的研究員下載使用。(詳全文)

多模態 GUI互動 微軟

微軟也用多模態LLM打造GUI代理工具

上個月,微軟開源一款GUI代理程式OmniParser,結合了多模態大語言模型(LLM)和其他模型,來辨識裝置UI畫面(如手機螢幕)、自動執行互動指令,是多模態LLM的另一新應用 。微軟團隊表示,GPT-4V和GPT-4o這類LLM,在處理一般任務時表現優異,但要作為通用代理、只靠視覺輸入來處理跨系統任務,仍不夠準確。

為解決難題,微軟先建立2個專屬資料集,包括網頁中可互動的icon資料集、icon描述資料集(即說明UI元件與其功能),來分別訓練2套模型。一套是偵測模型,以第一個資料集微調而成,用來辨識螢幕中可互動的icon圖標,另一套是圖說模型,以第二個資料集訓練而成,用來解釋偵測到的UI元件功能。這兩套模型都採Transformer解碼器架構,組合起來就是OmniParser。

微軟表示,經測試,OmniParser可精準辨識UI中的元件,並生成正確的功能解釋,可搭配GPT-4V執行精準的GUI代理任務、與系統互動。微軟並非第一家在該領域有所突破的企業,蘋果和Anthropic也發表過這類領域研究成果;隨著GUI解析技術的成熟,AI在跨平臺操作中的靈活性將大幅提升,讓自動化應用越來越可行。(詳全文)

AI評測 工研院 語言模型

工研院建AI測試實驗室,推語言模型可信任評測服務

去年底,數位部啟動AI產品與系統評測中心,要建立國家級AI模型評測機制,來衡量企業所使用的AI服務是否安全可靠。在數位部支持下,最近,工研院宣布建置臺灣第一家AI測試實驗室,參考了國際可信任AI框架和標準,也聯手AI產品與系統評測中心(AIEC)專家和技術委員,開發出可信任語言模型評測工具,可用來自動化測試模型的準確性、公平性、可靠性、隱私和資安等能力。

工研院量測技術發展中心執行長藍玉屏說明,這些測試工具,參考了國際和國內專家審議的測試題庫,來讓模型作答,並評估生成內容的可信任性。而隨著AI應用發展,工研院也會加強對AI技術的測試、探索新技術應用的評測方法。另一方面,工研院也與法國國家計量院(LNE)簽署合作協議,要來交流AI評測技術。(詳全文)

多代理 微軟 Magentic-One

微軟開源多代理AI系統

最近,微軟釋出一款多代理AI系統Magentic-One,專門為跨領域、開放式網頁與檔案操作任務設計,並在GitHub開源。進一步來說,該系統以Microsoft AutoGen框架為基礎,允許多個代理相互協作完成複雜任務,可用於程式開發、資料分析和研究等領域。

Magentic-One採多代理架構,由主導代理Orchestrator負責規畫任務、追蹤進度,也會分配具體子任務給其他4個代理。不同代理有不同專長,包括從本機檔案中擷取資訊、操作網頁瀏覽器,或編寫和執行Python程式碼等。Magentic-One高度模組化、隨插即用,可根據開發者需求,靈活添加或移除代理。在開源Magentic-One的同時,微軟也釋出相對應的評估工具AutoGenBench,供開發者在控制變數和隔離環境下進行系統測試,確保該系統的穩定表現。(詳全文)

GitHub Java Copilot助理

GitHub發布Java專用助理

最近,GitHub推出一款Java開發新工具:Java Copilot升級助理(Copilot Upgrade Assistant for Java),並開放技術預覽。該工具採用GAI來自動化升級Java應用程式的執行環境、框架和相依性,簡化企業用戶的操作。

在技術預覽版中,Copilot升級助理能協助開發者設定JDK、Maven路徑、特定功能分支名稱等參數,也能辨別專案中的主要相依項目,像是Spring Boot和JUnit等測試框架。完成設定後,Copilot助理能生成一系列升級任務,開發者也能在儀表板即時查看每個步驟的進度。要是在升級過程中發生錯誤,Copilot助理也會自動修復,並建立動態建置與修復迴圈嘗試多種解決問題的方法。(詳全文)

Hugging Face 小型語言模型 SmolLM2

Hugging Face發表輕量級小型語言模型SmolLM2

最近,AI社群Hugging Face發布一系列可在手機上執行的小型語言模型SmolLM2。這是繼7月首次問世後,SmolLM家族的最新版本,包括參數量135M、360M與1.7B三種版本。其中,135M參數模型又可分為基礎版和Instruct版,360M與1.7B參數模型則各自分成基礎、Instruct和GGUF(GPT-Generated Unified Format)版本,共11個模型,皆以Apache 2.0授權開源。

135M、360M與1.7B都是以公開資料集和Hugging Face編排的資料集訓練,但1.7B版本還多了數學與程式碼資料集。這些資料集分別有2兆、4兆與11兆個字符(Token)。相較於第一代,SmolLM2在指令遵從、知識與理解能力表現更好,也拜Argilla資料集之賜,Instruct模型還支援改寫、重要摘要與函式呼叫等任務。不過,SmolLM2模型只能理解和生成英文內容,也還存在事實準確性、邏輯一致性以及偏差等問題。(詳全文)

GitHub 引導式對話 開發

主動反問釐清需求!GitHub Copilot新添引導式對話功能

日前,GitHub更新Copilot助理,新添引導式對話能力,並在Visual Studio 2022 17.12第3預覽版上線。GitHub Copilot開發團隊指出,這項更新可讓Copilot在需求不清楚時,能主動提問開發者、釐清上下文,協助開發者更快完成任務。

他們表示,在之前的版本中,不少開發者要花時間思考,如何正確表達需求,可能還要篩選過多的生成內容。但新功能可減少開發者寫提示詞的困擾,能隨開發者需求調整回應,提供精簡的資訊。同時,GitHub Copilot也整合資料處理工具Data Wrangler,開發者能以自然語言進行資料清理與轉換,並透過資料的上下文生成程式碼,更精準地處理資料。(詳全文)

圖片來源/史丹佛大學、微軟、Hugging Face

AI近期新聞

1. 數位部數位產業署回覆民間對加強投資AI新創計畫的民間意見

3. 微軟替記事本及小畫家添增AI能力,改寫與自動填補邁入預覽

資料來源:iThome整理,2024年11月

熱門新聞

2026-02-11

2026-02-12

2026-02-11

2026-02-10

2026-02-09

2026-02-13

2026-02-10