道高一尺,魔高一丈,用這兩句話來形容當前資安防禦的嚴峻局勢,仍然十分貼切,許多企業或組織雖然不惜砸下重金,購買最新進、最受市場研究機構肯定的資安解決方案,當中整合了豐富的威脅情報、黑名單資料庫,以及廠商聲稱的各式人工智慧技術,但終究還是無法安心,「這樣擋得住駭客攻擊嗎?」的疑問,不只是困擾著用戶,對於開發資安產品、必須對用戶提出一定擔保的廠商來說,更是坐立難安,因為攻守之間瞬息萬變,存乎一心,即便我們派出千軍萬馬,設法將資安做到天衣無縫,所花費的物力、人力和時間,恐怕不敷成本效益。

而在今年HITCON Pacific大會,擔綱第一場主題演講的奧義智慧創辦人邱銘彰,就從「防守端花費越來越多錢,攻擊端竟也隨之賺了越多錢」的荒謬現實,開始談起,他認為,評估產品的關鍵,並非只關注它擋住了哪些威脅,而是在於以何種方法來處理它所無法阻擋的東西,而且,這麼做同時是必須要有成本效益的。

然而,該如何偵測自身無法偵測到的威脅,卻是一個大難題。因此,絕大多數企業會建置安全事件管理系統(SIEM)輔助惡意活動判斷,但是,在實際使用上,資安團隊所需要處理的各種資訊,非常龐雜;就系統發出的警報通知而言,誤判機率很高,可信度嚴重不足;就算有心想要深入調查,在有限的時間和人力之下,也只能以極低的比例完成審視;而在突發事件的反應(IR)上,也佔用了組織的年度資安預算(臺灣的狀況則跟全球相反,投入IR的比例過低,是因為不夠重視,而非預防措施做得好)

現行資安產品應用機器學習技術的挑戰

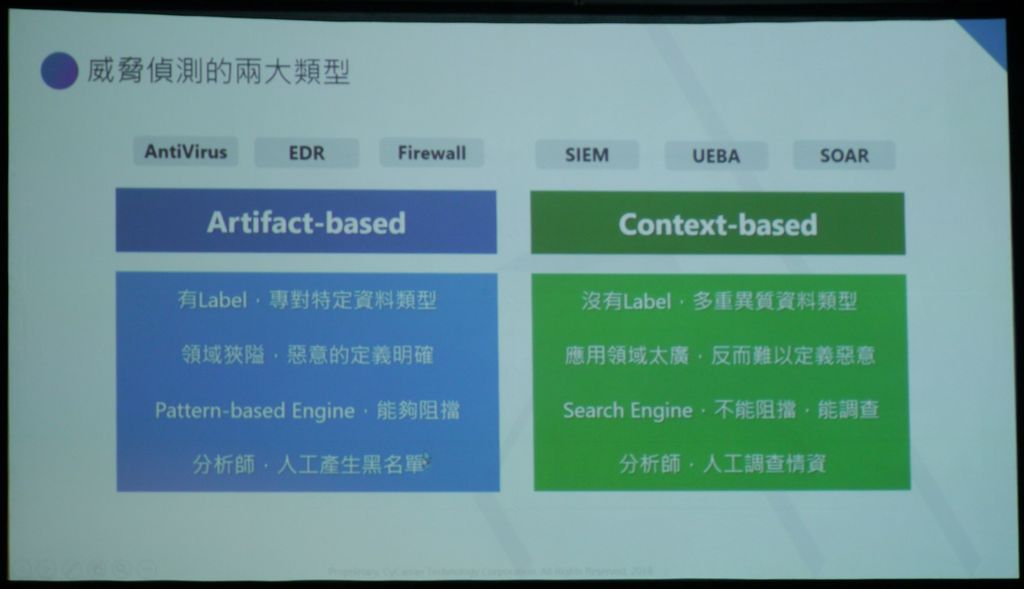

為了正本清源,邱銘彰將威脅偵測區分為兩大類:物證型(Artifact-based)與脈絡型(Context-based)等。

前者是有明確的領域,有特定的資料類型範圍,可針對具有顯性、共通特徵的惡意活動,而我們所熟知的防毒軟體、端點偵測與反應(EDR)、網路防火牆,種種採用特徵碼辨識技術的資安解決方案,都是代表性的產品。

而後者是不依靠標籤標記(Label),橫跨多種資料類型,應用領域更為廣泛,可針對難以定義的可疑活動,而這類解決方案的重點,往往在於提供搜尋、調查的能力,對於專業人力資源的需求較高,而應用這類技術的代表性產品,有安全事件管理系統、使用者暨實體行為分析系統(UEBA)、安全調度暨自動化反應系統(Security Orchestration, Automation and Response,SOAR)

針對人工智慧目前的應用,邱銘彰也提出幾個觀察重點。首先是在事件記錄分析上,採用監督式學習(Supervised Learning)與非監督式學習(Unsupervised Learning)所面臨到的挑戰。

前者需要在事件加上適合的標記,才能學習,而且這些資料本身是有前後脈絡的,不易找出特徵、特色;而後者若是用離群值來判斷,變化也會跟著變大,更何況離群也未必百分之百等於異常,因此誤判率仍然會居高不下。

而以實際的人工智慧應用來看,邱銘彰認為目前的技術仍存在許多挑戰。以圖片辨識為例,有些演算法可能並未考慮到圖片內雜訊的影響,而可能出現把虎斑貓的照片判斷為酪梨醬的狀況,因此,訓練機器學習的人必須要把更多各式各樣的照片,放到系統裡面去學習,才有可能觀照到全局,但這種求「資」若渴(data-hungry)的需求其實是無止盡的,我們不可能把所有資源都放置在這裡,而必須有所取捨。反觀在日常的資安管理工作當中,多數人都已經沒有時間看完所有的事件記錄,遑論在這些資訊當中加上適當標記。

此外,機器學習雖然號稱是由資料來驅動,但很多人並沒有注意到,一旦沒有輸入足夠的資料到系統當中,讓其能夠充分地進行分析,它們很可能最後會推斷出超乎人們預期的結果,而執行怪異的行為。同時,在決策上,我們可供機器選擇的反應也很有限,這也使得它們無法達到人們的期望。

恰巧在活動前幾天,臺灣發生首次Tesla電動汽車自動駕駛肇事的意外,邱銘彰也特別以此為例,說明自駕車人工智慧的局限,例如,能否辨識我國的交通錐與警示閃燈,而AI一旦遇到道路突發狀況,也只有左轉、右轉、煞車的選擇。

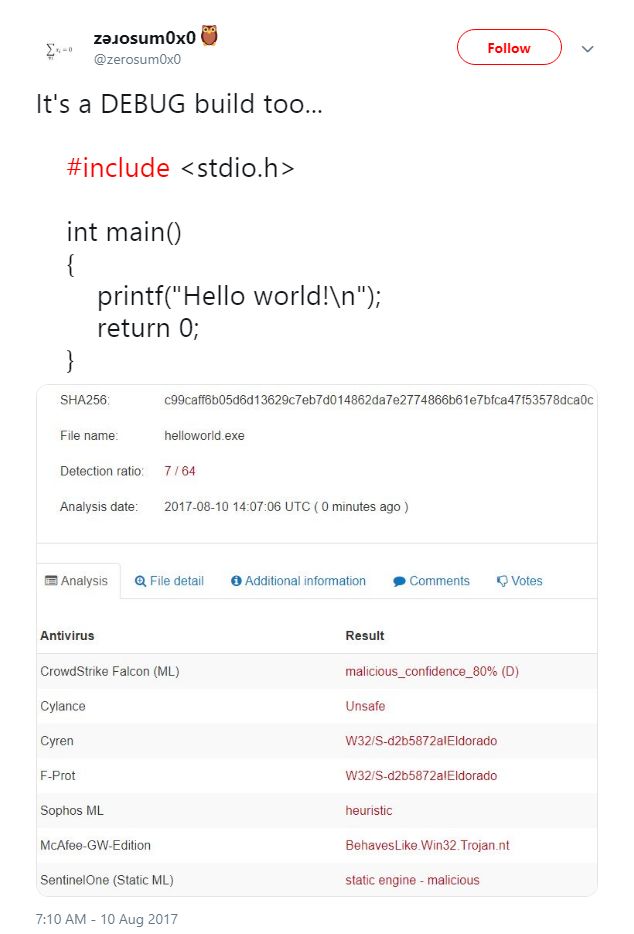

在資安防護技術研發的領域,也不乏AI誤判的例子。邱銘彰特別提到2017年知名資安研究員zǝɹosum0x0在推特上的發言,他說,程式開發者人盡皆知的Hello World程式碼,經過編譯之後,市面上眾多資安廠商的機器學習引擎,竟都誤判為惡意,不少網友也紛紛回報,表示若以MinGW、Cygwin編譯,同樣被多支防毒軟體的引擎判為惡意,而這樣的結果其實相當離譜。

除了上述這些例子,邱銘彰認為市面上不少基於AI的資安產品,其實存在著許多有待商榷的假設。首先是,假定系統在進行訓練學習時,所面對的用戶環境都是乾淨無毒的、沒有任何惡意程式或活動存在;其次是,認為用戶的資料分布和廠商實驗室一樣;接著,面對用戶資料,當中的每一種特性都是能夠量化、統計的;而這些資料經過運算之後,廠商也假定可以回答任何問題;最後,則是假設用戶不懂機器學習技術。

而就實際訓練出來的資料模型而論,其實跟大家所期待的差距甚遠。邱銘彰說,我們總認為能夠建構強大的模型,但實際上,因為資料的數量、有效性、多樣性不足,以及演算法本身設計上的問題、假設強度過高、優先順序不正確、偏好的影響,而使得產生的資料分析模型不夠穩定、容量不佳,而顯得貧瘠無力。

除此之外,邱銘彰提醒大家注意「時間」維度的影響。

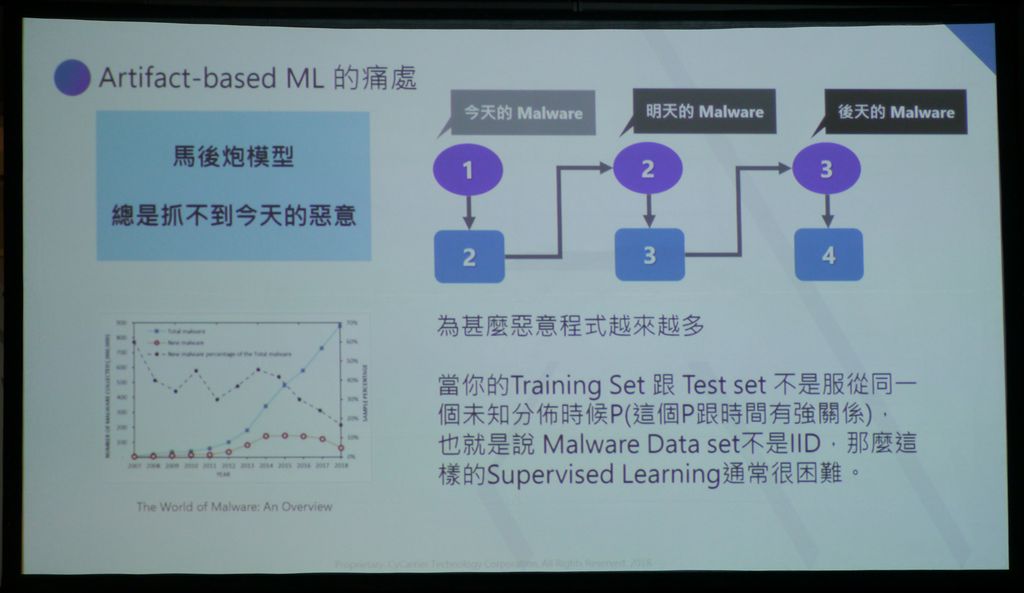

而在先前邱銘彰所提到的兩種威脅偵測方案之下,使用機器學習技術,也會受到上述這些因素的影響,而出現盲點。像是以物證式威脅偵測的方式來使用機器學習技術,有可能會出現「馬後砲」的結果,能夠針對過去出現的狀況來偵測,卻無法準確預估當下與未來不斷演化的惡意活動。甚至,因為你攻我擋的反覆循環,持續增強的資安防禦機制,長期下來,反而促成惡意軟體與活動的增多與不斷演化。

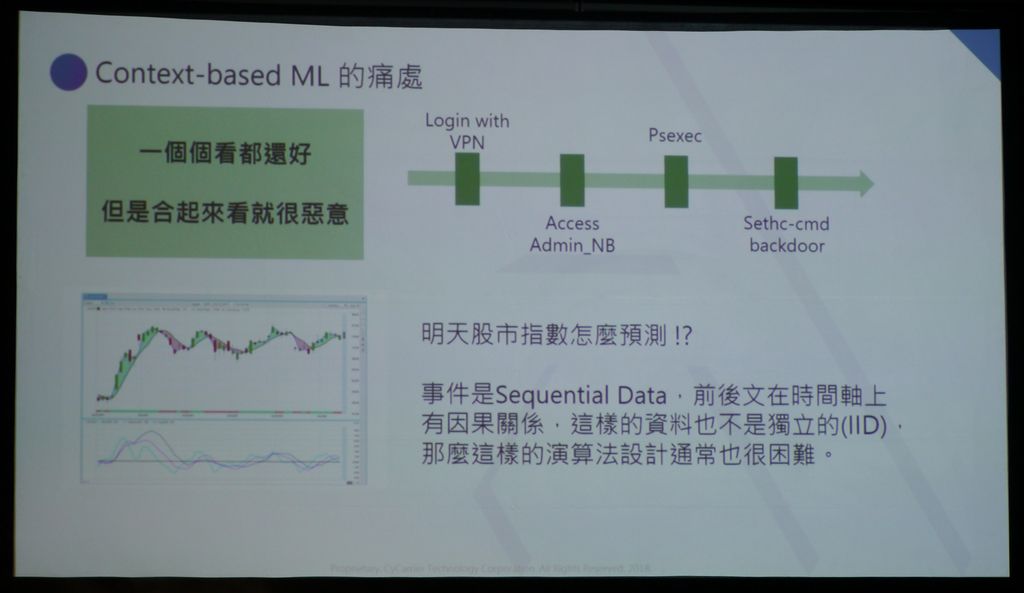

而基於脈絡式威脅偵測的機器學習,雖然能觀察到個別異狀,但對於連續性、有因果關係的組合式活動,可能就不易判定為具有惡意,相關演算法的設計也較為困難。

聚焦在主力大戶的動向預測,會是AI資安技術發展的新切入點

面對複雜多變的資安威脅趨勢,邱銘彰認為可以借鏡股市漲跌預測的角度,從中獲得一些啟發,那就是,與其預測指數的起起落落,若轉而分析股市大戶的行為動向,也能貼近目前與未來的狀況,因為股市的漲跌,有很大一部分的因素,取決於股市大戶的動向。

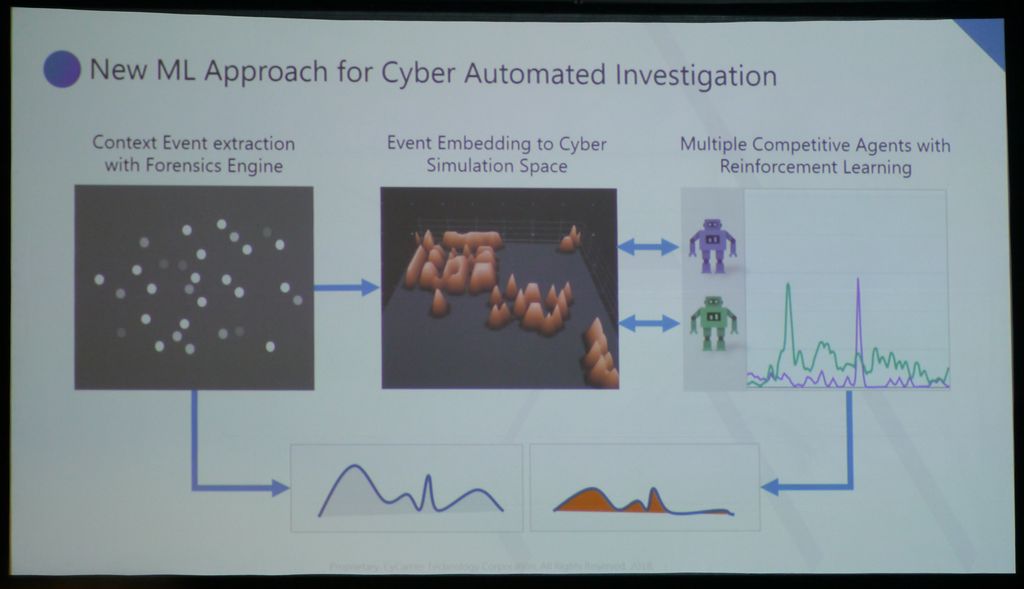

於是,奧義智慧目前發展出來一種新的機器學習防護模式,那就是先由鑑識引擎擷取出事件與脈絡,接著,將這些資料放到網路模擬空間,隔絕時間因素的影響,然後,利用增強學習(reinforcement learning)的方式來使用AI,並且使它們彼此競爭,促使準確度能夠自我提升,而經過上述流程所產生的模型,會再與最初擷取的事件脈絡之間,進行相互驗證。

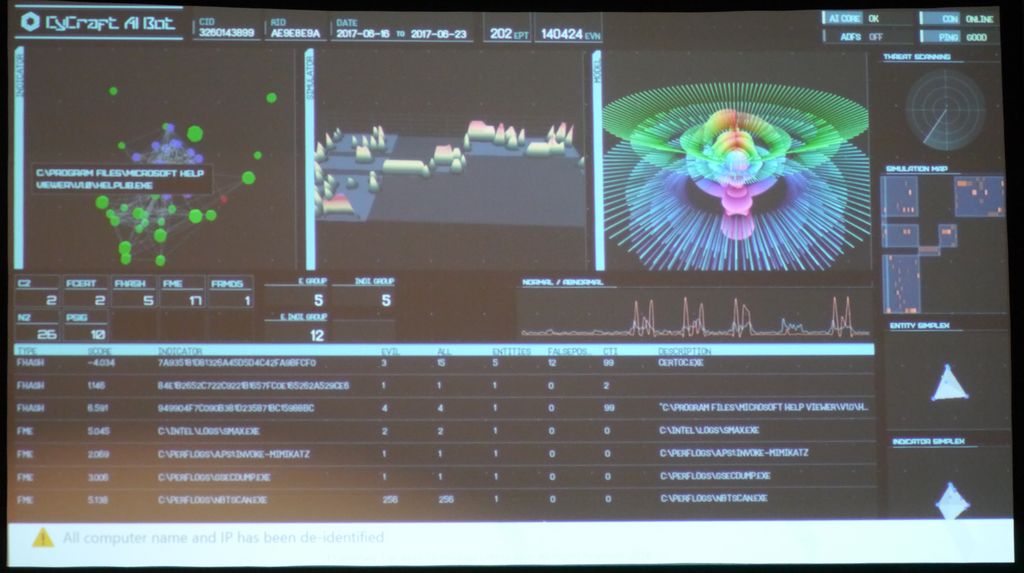

而這樣的整合運作架構和流程,已經實作為奧義智慧的產品功能,並且在用戶端環境獲得印證。

邱銘彰也在這次HITCON Pacific大會上,提出2個使用案例的偵測結果,並且列舉他們的AI Bot與EDR、專家之間的成效差異。

根據他們的觀察,就數量而言,AI Bot只有1項沒發現,而專家發現的數量少了4項,但找到了AI Bot沒發現的項目,至於EDR察覺的項目,則是遠遠落後。

熱門新聞

2026-02-09

2026-02-10

2026-02-06

2026-02-09

2026-02-10

2026-02-10

2026-02-10

2026-02-09