成大醫院過年前即啟動戰情資訊看板,一手掌握臺灣最新疫情動態、世界疫情、院內疫情摘要等,還有院內醫護人員班表、急診與ICU病床資訊,以及各單位物資統計。這些資訊,是成大防疫小組每日決策的重要參考。

成大醫院

在1月23日小年夜這天,街道上熙熙攘攘,許多人早已離開工作崗位,回家準備過年。然而,在成功大學醫學院附設醫院(簡稱成大醫院)中,仍有一群人聚集在會議室,盯著牆上的戰情資訊看板,兢兢業業地討論著。

他們,就是成大醫院防疫團隊的核心人物,以院長為指揮官,帶領了副院長以及站在第一線的感染科主任、臨床醫師,還有在幕後以IT推動防疫工作的資訊長團隊等數十人。這天,正是成大醫院武漢肺炎戰情資訊看板上線的第一天,也是衛福部成立中央流行疫情指揮中心成立後的第三天。

這個戰情資訊看板,匯集了關鍵的疫情動態消息,也是成大醫院每天早晨防疫會議的決策參考。資訊看板由六個大螢幕組成,首先是臺灣的疫情現況,斗大的數字清楚顯示確診人數、通報個案等,還有臺灣確診個案的地理分布圖,輔以衛福部的最新消息來補充。再來,則是世界疫情資訊與確診統計圖,可掌握各國動態,每分鐘更新兩次。

接著是成大醫院院內的最新疫情摘要,包括院內通報個案、待檢驗人數、確診個案、排除人數等關鍵訊息,另也附上院內排班表,可一眼掌握第一線醫護人員的工作狀態。

另一個螢幕,顯示著成大醫院院內急診與加護病房(ICU)的病床資訊,以一張圖表即時呈現每張病床的狀態和病人狀況,方便決策者調配資源。再來是院內的物資存量統計系統,涵蓋口罩、護目鏡、防護衣等資源,「特別是成大醫院擁有5,000多名醫護人員,後來口罩供不應求時,系統每天更新2、3次,來快速調配物資,」推動防疫關鍵IT應用的核心人物、成大醫院資訊長蔣榮先說。

以戰情資訊看板為核心,病歷自動化改善檢疫流程痛點

在過年前就啟動的,不只是戰情資訊看板這個核心系統,還有一系列的防疫計畫。比如,成大團隊在醫院入口皆設置了紅外線體溫感測裝置,用來確認入院人員是否發燒;團隊也從無到有,在短時間內,快速搭建了急診室外8個帳篷檢疫站,要是入院民眾耳溫超過37.5度,或是有上呼吸道症狀且本身或家人有中國旅遊史,就會由專員帶到臨床檢疫站,進一步處理。

作法1:搭建武漢肺炎臨床檢疫站

成大醫院自農曆年前,就啟動一系列防疫計畫,首先是在急診室外搭建8個臨床檢疫帳篷,讓耳溫超過37.5度的民眾,或是有上呼吸道症狀且自身或家人具中國旅遊史的民眾,在此處進行檢疫,以決定是否須進行病毒RNA篩檢。

這些檢疫站可說是醫院第一道防線,在農曆年初就正式運作了。雖然,團隊在短時間內就推出檢疫相關配套措施,但仍有改進空間。像是,檢疫流程很花時間、人力,當民眾進入檢疫站,還須仰賴護理人員一問一答、人工填寫檢疫表格,再輸入至電腦系統,才能建檔,以便後續追蹤。「這個作法,難免增加護理人員被感染的風險,」蔣榮先表示。

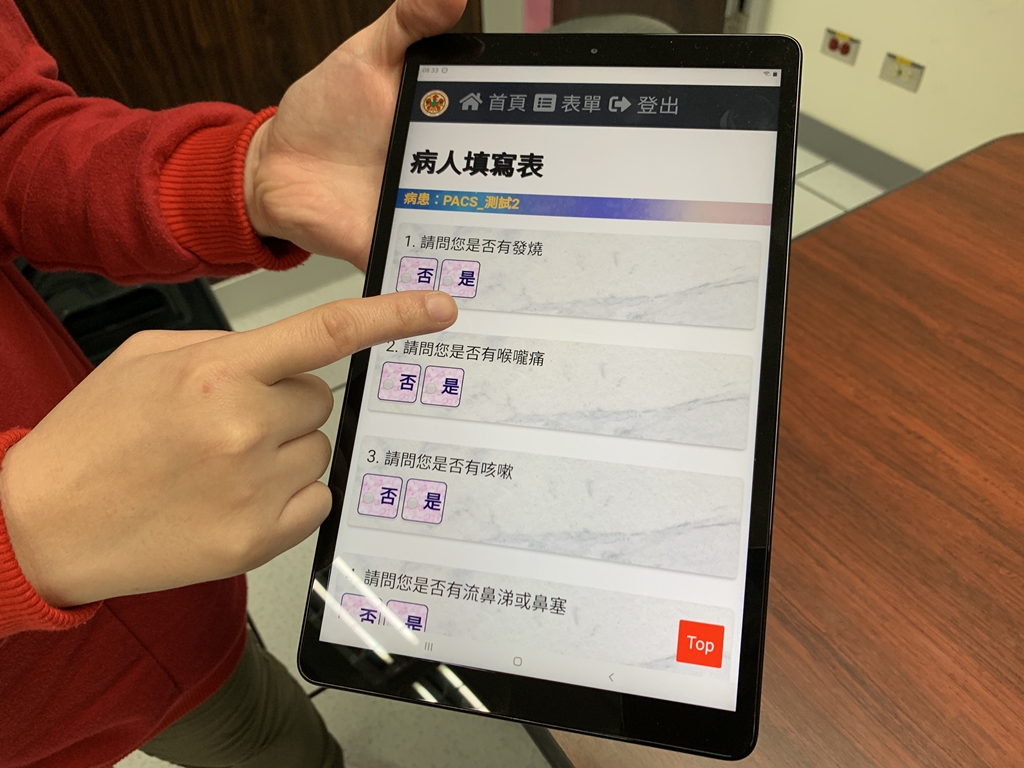

為解決這個痛點,團隊也快速拍板,從檢疫站的第一步改善。為提高效率,成大醫院導入了幾十套平板電腦,來取代原本需要手寫的檢疫表格,讓進入檢疫站的民眾,可於平板電腦上,自行輸入旅遊史、職業史、接觸史和群聚史等防疫必問的TOCC內容。資料填妥送出後,便直接匯入醫院電子病歷系統,醫護人員就可即時查看。

作法2:採用平板達到病歷自動化

為了降低交叉感染風險、提高資訊串接效率,成大醫院將檢疫站中,原本需要護理師一問一答、人工填寫的檢疫表單電子化,提供平板,由民眾自行輸入,之後再透過酒精來消毒。而填妥的資料,就會直接上傳至醫院電子病歷系統,供醫護人員即時查閱。

「如此作法,不只是病歷自動化,也能降低護理人員交叉感染的風險。」蔣榮先指出,相較於紙筆,平板在每次使用後,就會以酒精消毒,減少感染風險。

以半年智慧醫療專案為基礎,開啟武漢肺炎X光片AI計畫加速檢疫

除了從硬體下手,成大醫院也鎖定胸腔X光片判讀,要透過AI輔助、找出疑似武漢肺炎病癥,來加速醫師判讀的時間。這項武漢肺炎AI專案,由蔣榮先與成大醫院胸心血管放射線科主任蔡依珊來推動。他指出,原本的檢疫流程是民眾進入檢疫站後,須拍攝胸腔X光片,再由醫師判讀、找出疑似武漢肺炎的病癥,以決定是否要進行RNA病毒篩檢。

不過,由於一人不只拍攝一張X光片,「如果檢疫民眾人數較多,醫師就需花更多時間,來判讀X光片。」這樣一來,不只造成醫師疲勞,民眾也須長時間等待。而成大醫院整套檢疫流程跑下來,就要2個多小時。

因此,為提高檢疫效率,成大醫院團隊決定自行開發武漢肺炎AI。專案團隊整合了成大半年前組織的智慧醫療專案團隊,包括成大資工所與成大醫院影像醫學部,以當時研發的自發性氣胸AI預警系統為基礎,來發展新AI判讀模型。

這次,團隊著手改良了史丹佛大學機器學習小組的CheXpert-1開源模型,並利用美國國家衛生研究院(NIH)釋出的胸腔X光片資料集,取其中3,000張有無肺炎病癥的影像,來進行模型預訓練。

接著,團隊再以成大醫院標註的2,000筆資料,包括500筆具肺炎病癥正樣本,以及1,500筆無肺炎病癥的負樣本,來微調這套AI模型。最後,再利用醫院最近收集的92筆疑似武漢肺炎(COVID-19)的胸腔X光片,來進行驗證。

嘗試失敗找出癥結,武漢肺炎X光AI工具成功上線

「很可惜,AI辨識效果始終不理想,」蔣榮先表示。對此,團隊也與臨床醫師來回討論,歸納出最有可能的原因,「就是開源資料集的影像品質參差不齊。」他解釋,由於公有資料集的影像,來自不同等級的醫院,而這些醫院拍攝的影像目的不盡相同、影像品質也隨之不同,標註水準良莠不齊,影響了AI模型的表現。

後來,團隊進一步調整策略,來改善模型辨識能力。首先,團隊採用深度學習中容錯性較高的ResNeXt-1架構,來訓練、調整AI模型。再來,在特徵提取工程中,則加入了Squeeze-and-Excitation Network(SENet)網路架構,來讓「模型更專注於重點資訊。」此外,團隊也採用Feature Pyramid Network(FPN)網路,來增強模型的感知視野,強化模型對大小不一的病癥辨識能力。

另一方面,由於武漢肺炎案例仍屬少數,團隊也遇到了訓練資料正樣本不足的問題。為此,團隊以兩個方法來解決,首先,由於正樣本數量少、不易精準預測病癥定界框(Bounding Box),於是,團隊將原本的定界框預測任務,轉換為影像語義分割(Segmentation)任務。

再來,團隊採資料增強(Data Augmentation)方法,來增加訓練資料,也就是隨機將影像放大、縮小、左右旋轉、水平翻轉,或是傾斜、調整明暗對比;然後將影像隨機裁切為320 x 320,並在每一次迭代中,隨機進行影像調整。這個方法,可避免模型過度訓練(Overfitting),也能增加穩健性(Robustness)。

調整過後,接著,團隊再利用成大醫院額外標註的1,245份胸腔X光片,包含553分正樣本與692分負樣本,來訓練這套AI模型。

完成訓練後,團隊也以醫院近期收集的122筆疑似武漢肺炎病癥資料,來驗證模型辨識能力。結果顯示,AI模型對訓練集和測試集的敏感度(Sensitivity),分別是91.4%與76.9%,特異度(Specificity)為92.5%、90.8%,準確率(Accuracy)則是92%與89.8%。這個表現,「與院內專業醫師判斷相當,」蔣榮先說。

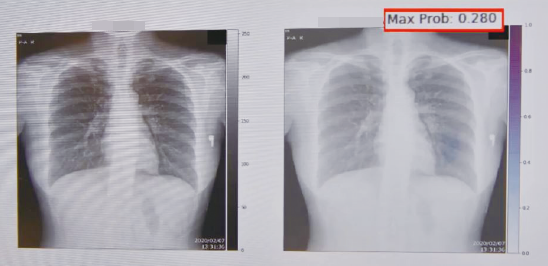

這項武漢肺炎AI專案從2月初啟動,短短兩周就完成開發和測試,近期也正式進入第一線,作為檢疫站臨床醫師的小幫手。蔣榮先表示,這套AI可在檢疫民眾拍攝胸腔X光片後,0.1秒內找出病癥位置,並以熱區圖(Heatmap)標示病癥之處,同時以顏色呈現罹武漢肺炎的機率,再由醫生確認。

作法3:藉助AI加速肺部X光片判讀

為加速判讀時間,成大醫院團隊開發一套武漢肺炎判讀AI,可將X光片中疑似病癥標示出來,並以顏色顯示患病機率(大於0.5即為高風險),再由醫師確認。本示意圖顯示,經AI判讀,患武漢肺炎機率為0.28,非高風險族群。

有了它,整趟檢疫流程從原本的2個小時,縮短為30分鐘不到。不只大幅縮短檢疫流程,「這套AI系統,還可輔助其他專科醫生或資淺的醫生,來判讀胸腔X光片,」蔣榮先指出。

.jpg)

精益求精,還要導入迎賓機器人攻病歷自動化2.0

至今,成大醫院檢疫流程已大幅精進,不過,團隊仍繼續思考改良之道,還要更上層樓;其中之一,就是目前評估要導入的迎賓機器人。蔣榮先指出,成大醫院每日都在衡量疫情變化,「我們思考,要是未來疫情加劇,會在檢疫站口導入國產Zenbo機器人,一方面迎賓,一方面輔助檢疫民眾在螢幕上輸入TOCC資料。」

在他看來,相較於全副武裝的醫護人員,能歌能舞的迎賓機器人,不只能帶給檢疫患者親切的第一印象,也能引導患者輸入病歷資料,或提供其他有幫助的檢疫醫療資訊。反過來說,當疫情更加嚴峻時,迎賓機器人也能減少醫護人員與檢疫民眾的接觸,進而降低感染風險。

作法4:以Zenbo機器人達到病歷自動化2.0(建置中)

目前,成大醫院團隊也正評估導入Zenbo機器人,作為檢疫站中,兼具迎賓功能,也能讓檢疫民眾填寫旅遊史、職業史、接觸史和群聚史等資料,並串聯醫院電子病歷系統。

不只如此,這套機器人,也是成大醫院未來長照與居家照護的策略重心。兩年前,成大成立科技部AI生技醫療創新研究中心,引進了Zenbo機器人,由蔣榮先與成大AI生醫長照研發團隊,來開發機器人背後的自然語言知識庫與相關AI應用,目的是要將Zenbo打造為陪伴照護型機器人。

蔣榮先指出,機器人的目標是要協助醫師,提醒長者用藥資訊,並同時透過藍芽穿戴裝置,記錄長者生活狀況,像是血糖、飲食、運動等。除此之外,還要能陪長者聊天、讀新聞,甚至要結合醫療雲端平臺,將機器人記錄的數據上傳,來進一步分析並提供給醫護人員或營養師參考。

就現階段而言,這款機器人已可做到聊天對話、讀新聞、提供相關衛教資訊等,也可透過長者親屬或照護人設定,來自動計算用藥提醒時間,讓長者按時服藥。目前,成大也已部署20多臺機器人,於臺南市社區及藥局進行測試。與此同時,團隊也正研發一套影像辨識AI模型,要來分析長者的臉部表情,進一步了解被照護者的情緒。如此一來,機器人就能根據長者的情緒,來進行不同的問候。

除了在硬體上下功夫,醫療影像AI也是成大醫院著墨的另一大領域。蔣榮先指出,成大醫院一年所產生的醫療影像,就超過3,400萬張,其中有X光片、電腦斷層掃描、心電圖、核磁共振影像、超音波影像等。在他看來,如此龐大的資料量,是AI在醫療影像領域上發光發熱的最佳條件;透過精準的醫療影像判讀AI,可減少放射科醫師判讀大量影像的負擔。

近幾年,成大與成大醫院團隊聯手,紛紛於腫瘤科、心臟科、放射科、重症醫學科、婦產科、腸胃消化科和急診科等科別,導入實驗性的AI計畫。其中一項,便是蔡依珊主導的非典型缺血性心肌梗塞AI,可在心臟主動脈電腦斷層掃描(CT)影像中,透過AI告訴醫師,在一份醫療影像中,不是只有一個故事;也就是除了判斷主動脈剝離之外,還可以確認病人是否患有非典型缺血性心肌梗塞。就初步成果來看,模型準確率達84%,且與院內表現最好的醫師相比,只相差4%。未來,成大團隊還要開發更多醫療影像AI,作為醫生輔助診斷的有力工具。文⊙王若樸

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-09

2026-03-09

2026-03-06