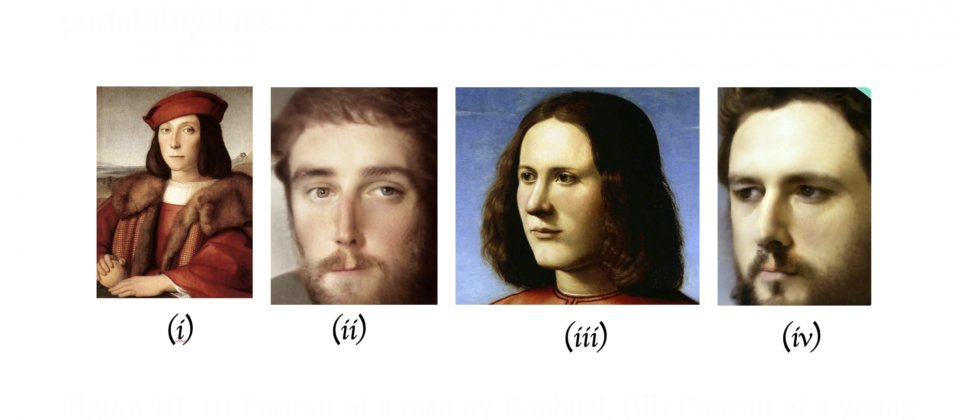

圖像編輯軟體常見的改變人像性別功能,由於AI系統誤將長髮男性(i,iii)辨識為女性,因此性轉功能後,在這些男性人像加上了鬍子以及男性特徵(i,iv)

由於人工智慧在臉部辨識,以及自然語言處理等領域的快速發展,這部分人工智慧論理開始受到重視,但是在人工智慧生成藝術畫作的應用,雖然普及程度已經大幅增加,不過,相關的倫理影響仍顯少受到關注。富士通研究人員利用因果模型(Causal Model),解析因當前藝術創作模型的不足,導致模型出現的各類偏差。

從2014年開始,就有研究人員嘗試使用人工智慧來產生藝術作品,而由於近年深度學習的發展,人工智慧生成技術有了很大的進展,已經可以從多張圖像創建混合圖像,或是將肖像以卡通風格重繪,2018年Christies拍賣行以432,500美元,售出人工智慧生成的藝術品,博物館也開始收藏這類作品,2020年不少相關應用程式和工具的出現,更加強了人工智慧藝術的普及。

而這股浪潮的興起,開始有研究人員對此感到擔憂,在2018年,研究人員Aaron Hertzmann在論文〈Can computers create art?〉中提到,藝術品由人定義的程式所創造,因此電腦所產生的藝術品可能受偏見影響。人類先入為主的觀念、非理性和情感的元素,可能會無意間進到訓練模型所使用的資料,像是Morgan Sung在2019年的研究指出,AI Portraits人工智慧照片應用程式,會淡化有色人種的皮膚顏色。

這種情況就如同大型語言模型所生成的文字一樣,語言模型並非真的理解文字意義,僅是善於操縱文字,富士通研究人員提到,生成藝術存在許多類型的潛在偏見,尤其是與藝術史相關的偏見,在過去沒有進行過類似的分析,也沒有這些偏見對社會文化影響的研究,而他們試圖解決這些問題。

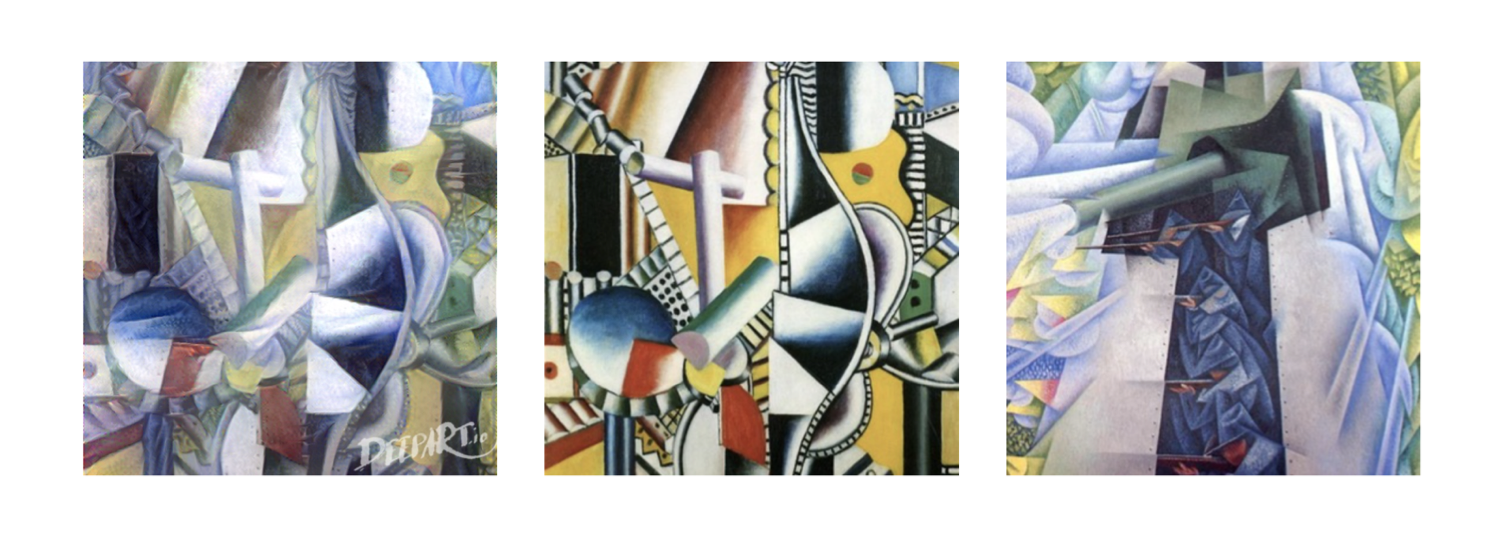

研究人員使用因果有向無環圖(DAG),來分析演算法設計和資料集所造成的幾類型偏見,透過視覺化藝術品中的重要元素,來理解這些元素之間的關係。他們發現了多種偏見,包括可將圖片轉換成特定風格的Deepart應用,經轉換之後的畫作會丟失某些重要特徵,像是立體派畫作《Propellers》(圖中),採用未來主義畫作《Armoured Train in Action》(圖右)風格重新繪製,所產生的輸出(圖左),失去了未來主義的重要特徵。

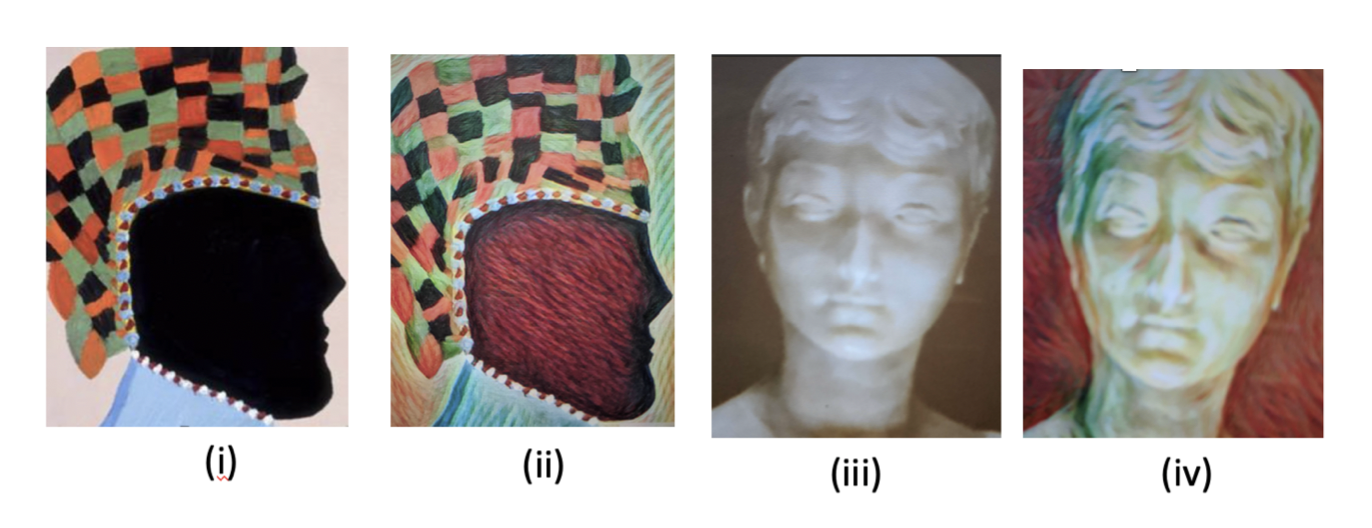

另一個,類似Deepart的平臺GoART,則產生更嚴重的偏見,GoART在改變藝術品風格時,會傾向改變深色膚色人臉的顏色,例如《Black Matriarch》(圖左1)畫作以表現主義呈現,則原本畫作中人物的黑臉被改成紅色(圖左2),研究人員提到,這類的錯誤不會發生在膚色較淺的人臉上,像是雕像《Giovinetto》(圖右2),GoART僅會對雕像加上陰影(圖右1)。研究人員還拿了其他文藝復興的畫作來測試,線上人工智慧工具Abacus則會錯認畫作的性別,把長髮的年輕男性辨識為女性。

造成這些錯誤的主要原因有兩個,第一個是用來訓練人工智慧模型的資料集失衡,研究人員提到,像是訓練AI Portraits就用了45,000張,以白人為主的文藝復興時期肖像畫作,因此容易在輸出結果出現種族偏差。另一個潛在的偏差來源,則可能是資料標註過程不一致,不同的標註者可能因為偏好、文化等因素,影響創建的標籤。

研究人員提到,這些存在於人工智慧藝術生成系統中的偏見,對社會文化產生負面影響,不只可能會出現種族、性別偏見,或是其他類型的歧視,演算法還可能錯誤理解畫作,強化對藝術家風格的刻板印象,並且忽略藝術家的意圖和情感,在生成畫作中呈現相反的意思,且人工智慧對歷史事件和人物的描繪,可能與事實相反,進而影響人們對史實的理解。

熱門新聞

2026-02-11

2026-02-11

2026-02-09

2026-02-10

2026-02-10

2026-02-06

2026-02-10