杜克大學針對放射科醫師,開發了一個人工智慧平臺,能夠用於分析乳房X光片,找出潛在的癌變組織,提供醫師額外的資訊,以決定是否要進行侵入性檢驗。這個系統的特別之處在於,其所使用的演算法能夠被解釋,也就是說,醫生能夠知道演算法做出決定的理由,因此也就更能相信人工智慧給出的結果。

研究人員提到,電腦要助醫生做出重要的醫療決策,首先醫生必須相信人工智慧所得到的結論,是根據有意義的證據,因此他們開發的演算法不僅可以推理出結論,還可以自我解釋,展示得出結論的過程,如此人工智慧才能夠協助醫生做出更好的決定。

即便FDA已經批准了百種以上可用於臨床的演算法,但是不少演算法缺乏可解釋性,一旦醫生使用人工智慧出現失敗案例,人工智慧在高醫療風險決策中的使用便會遭到質疑,研究人員提到,人工智慧模型的確很容易失效,在不同的設備上部署模型,就可能因為設備本身微小的差異,使得模型出現錯誤。

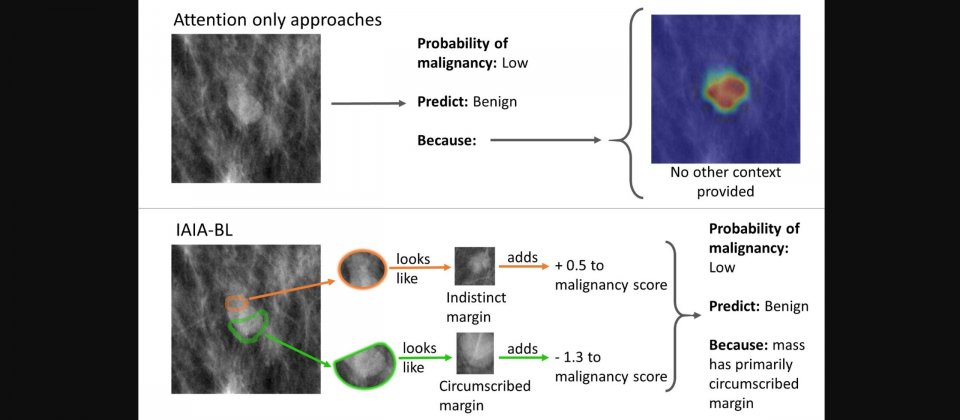

因此當模型能夠自己說明結果推論的過程,模型的可信度將會明顯上升。研究人員使用來自484名患者所拍攝的1,136張圖像,訓練人工智慧模型,研究人員提到,他們教人工智慧找到可疑的病變組織,但同時忽略健康的組織與不相關的資料,且聘請放射科醫生,仔細的標記圖像,來教會人工智慧精確地辨識癌變組織的邊緣,並將這些邊緣和圖片中已知癌症和良性腫瘤的邊緣進行比較。

放射狀線條以及模糊的邊緣,通常是腫塊的邊緣,也是惡性胸線腫瘤的最佳預測指標,研究人員提到,因為癌細胞複製快速,擴散速度非常快,導致X光片中並非所有擴張中的腫瘤邊緣都容易被發現,該特徵是放射科醫生第一優先尋找的標的。而杜克大學研究人員所開發的人工智慧模型,則能模仿醫生的行為,把焦點放在這些難以發現的邊緣上,並在解釋診斷過程時,把這些邊緣圈選出來。

研究人員以訓練真正的放射科醫生一樣的方式,來訓練人工智慧模型,而非讓模型自由發展辨識過程,與其他無法解釋,存在黑盒子的模型相比,這個新的模型由於其可解釋性,因此甚至可以成為訓練平臺,教學生檢視乳房X光片,或是可以在醫療資源稀缺的地區,提供更好的乳房X光檢查。

研究人員表示,他們以特別的方式來訓練人工智慧檢視醫學圖像,與其他人工智慧模型的差異在於,其他模型並未嘗試模仿放射科醫生,甚至在特殊情況下,可能會從有缺陷的推理過程獲得結果。這個新的人工智慧模型模型,辨識結果雖然無法超越人類放射科醫師,但是能與其他模型的表現一樣好,並且在出現錯誤時,讓使用者發現模型出現錯誤,並且知道發生錯誤的原因。

熱門新聞

2026-02-09

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-06

2026-02-09