Google在2021年開源的低位元率音訊編解碼器Lyra,經過社群的熱心貢獻與改進,不只修復和格式化程式碼,還對專案建構持續整合工作管線,甚至增加支援WebAssembly,現在Google宣布釋出Lyra V2。

由於全球COVID-19疫情的關係,對遠端語音通訊需求大幅上升,因此Google創建Lyra,目的是要將其應用在遠端工作和低頻寬環境中,藉此改善語音通話品質,Lyra是一款極低位元率音訊編解碼器,並運用機器學習技術來提高音訊品質。

Lyra獲得不少開發者的歡迎,並要求在更多平臺上運作Lyra,以更多種程式語言開發應用程式,同時也希望運算速度可以更快、有更多的位元率選項,還有延遲更低、音質更好且失真更少等功能。Lyra V2肩負這些期待,採用全新的架構,並且支援更多的平臺,提供用戶可擴充的位元率功能,效能也較第一版更好,也能夠產生更高品質的音訊。

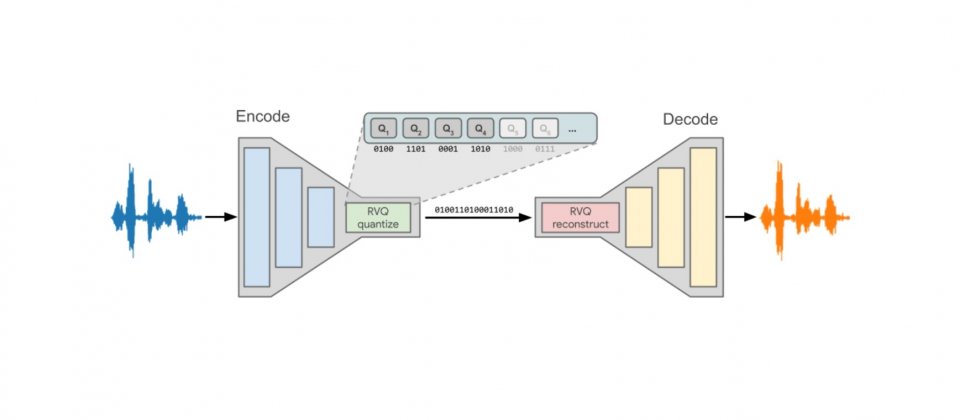

Lyra V2採用一種稱為SoundStream的端到端神經音訊編解碼器,該架構在傳輸通道之前和之後,都有一個殘差向量量化器(Residual Vector Quantizer,RVQ),可將經編碼的資訊量化成位元串流,並在解碼端進行重建。Google解釋,將RVQ整合到架構中,便能夠透過選擇量化器數量,隨時更改Lyra V2的位元率,使用更多量化器,就會產生更高品質的音訊。

Lyra V2支援三種不同的位元率,分別是3.2 kps、6 kbps和9.2 kbps,供開發者依網路條件和品質需求選擇適當的位元率。由於Lyra V2模型使用TensorFlow Lite匯出,而TensorFlow Lite是輕量版本行動的TensorFlow,支援各種平臺和硬體加速。

開發團隊已經在Android手機和Linux上進行過測試,並且實驗性支援Mac和Windows,目前仍不支援在iOS與其他嵌入式平臺,但開發團隊提到,這種範式將透過TensorFlow Lite,使Lyra未來也能夠支援該平臺所支援的任何平臺。

在使用新架構之後,Lyra V2的延遲從原本的100毫秒降低到了20毫秒,這樣的延遲程度已經能夠與當前最被廣泛使用的音訊編解碼器Opus for WebRTC媲美,Opus for WebRTC的一般延遲落在26.5 毫秒、46.5毫秒和66.5毫秒。

Lyra V2的解碼和編碼速度也比之前的版本快5倍,Google在Pixel 6 Pro手機上試驗,Lyra V2僅需要0.57毫秒編碼和解碼一段20毫秒的音訊框,比即時快上35倍,而降低複雜度代表有更多手機能夠即時運作Lyra V2,並且降低電池消耗。

另外,Lyra V2的音質也因為機器學習技術的進步而獲得提升,聽力測試顯示Lyra V2在3.2 kbps、6 kbps和9.2 kbps的音質,已經與Opus的10 kbps、13 kbps和14 kbps相同,也就是說,Lyra V2要達到與Opus相同音質,只要使用Opus的50%到60%頻寬。這代表在頻寬受限的環境,可以連接更多的裝置,或是透過網路送出更多訊息,並更有機會透過前向錯誤更正和封包丟失補償技術,避免語音斷斷續續的問題。

Lyra V2提供的內容涵蓋Lyra V1,包括所有的建置工具、測試框架、C++編碼和解碼API、訊號處理工具鏈和範例應用程式,Lyra V2雖然與Lyra V1存在部分差異,但是開發體驗大致相同。

熱門新聞

2026-02-11

2026-02-12

2026-02-11

2026-02-10

2026-02-09

2026-02-13

2026-02-10