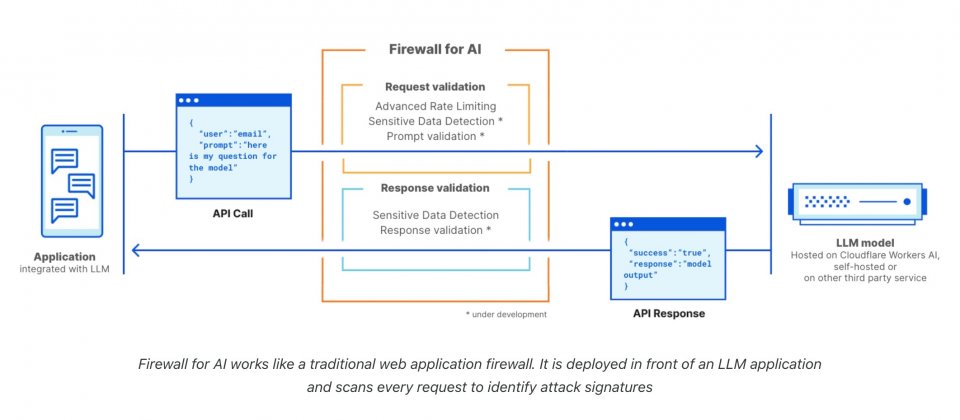

Cloudflare針對大型語言模型應用推出Firewall for AI,目的是要在大型語言模型部署之前,提供一個保護層,阻擋有問題的請求輸入模型,避免模型遭到濫用。Firewall for AI是一個針對大型語言模型設計的進階網頁應用防火牆(WAF),不只能夠偵測漏洞也提供視覺化工具,方便用戶管理人工智慧應用的安全性。

企業正大量地採用大型語言模型,但由於應用程式與網際網路連接,因此同時也引入了新的漏洞,可能遭惡意攻擊者濫用。Cloudflare提到,大型語言模型應用除了需要面對傳統網頁和API應用程式領域,諸如注入或是資料外洩等資安威脅之外,由於大型語言模型在操作上的不確定性,還須面對像是模型劫持並執行未經授權操作等問題。

而Cloudflare推出的Firewall for AI,主要是針對提示詞注入(Prompt Injection)、模型拒絕服務(Model Denial of Service),以及敏感資訊洩漏(Sensitive Information Disclosure)三種模型攻擊提供保護措施,減少被濫用的風險。

Firewall for AI的部署方式與傳統網頁應用防火牆相同,每個帶有大型語言模型提示詞的API請求都會經防火牆掃描,以偵測可能的攻擊模式和特徵。Firewall for AI可以部署在託管於Cloudflare Workers AI平臺,或是其他第三方基礎架構的模型之前,並且能夠與Cloudflare AI Gateway合併使用,透過網頁應用防火牆控制平面來控制和設定Firewall for AI。

模型拒絕服務與傳統應用程式所面對的流量攻擊(Volumetric Attack)類似,都是藉由消耗大量資源,進而導致服務品質下降或是增加模型運作成本的攻擊方式。Firewall for AI會透過速率限制策略,來控制各個對話請求的速率,以限制脈絡長度(Context Window)降低DoS的風險。

在偵測敏感資料方面,Firewall for AI讓用戶使用敏感資料偵測(Sensitive Data Detection,SDD)網頁應用防火牆管理規則集,辨識模型在回應中回傳的個人識別資訊(PII)。用戶可以在網頁應用防火牆安全事件中審查SDD的比對狀況。

目前SDD提供了一套管理規則,掃描信用卡號碼等財務資訊,以及API金鑰等機密資訊,Cloudflare將會讓用戶創建自己定義的規則。另一方面,Cloudflare也將擴展SDD,避免使用者向外部大型語言模型供應商例如OpenAI或Anthropic等,共享PII或其他敏感資訊。

而模型濫用則是一個廣泛的類別,包括提示詞注入,攻擊者透過特別設計的輸入來操縱語言模型。抑或是提交導致模型產生幻覺、不準確或冒犯性回應,甚至是偏離主題的請求等行為。另一方面Cloudflare也提到,企業也希望避免人工智慧應用生成有毒或是冒犯性的回應。

Firewall for AI會進行一系列偵測,針對提示詞注入和各種濫用,防火牆將自動尋找嵌入在HTTP請求或是JSON Body中的提示詞。一旦用戶啟用防火牆,系統將會分析每個提示詞並根據惡意可能性給予分數,搭配上機器人分數或是攻擊分數,用戶可以創建規則阻擋符合一或是兩個維度以上,具特定分數的請求,達到保護大型語言應用的目的。

要使用Firewall for AI,企業用戶需要訂閱Application Security Advanced方案。目前已經能夠使用進階速率限制與SDD功能,而Cloudflare還在開發Firewall for AI的提示詞驗證功能,預計還需要幾個月才會正式推出。

熱門新聞

2026-02-11

2026-02-11

2026-02-09

2026-02-10

2026-02-10

2026-02-06

2026-02-10

2026-02-10