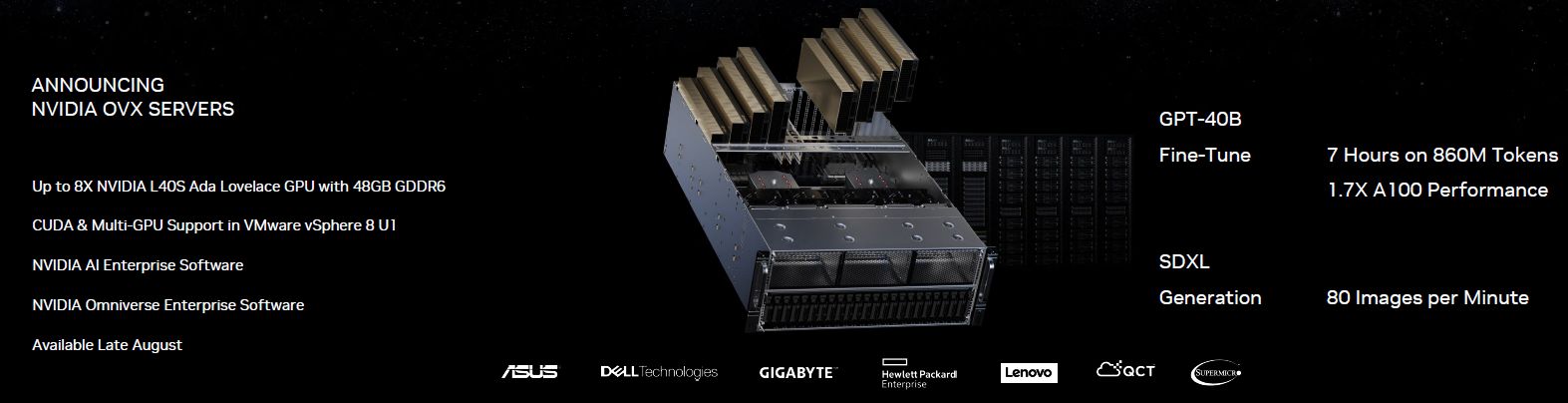

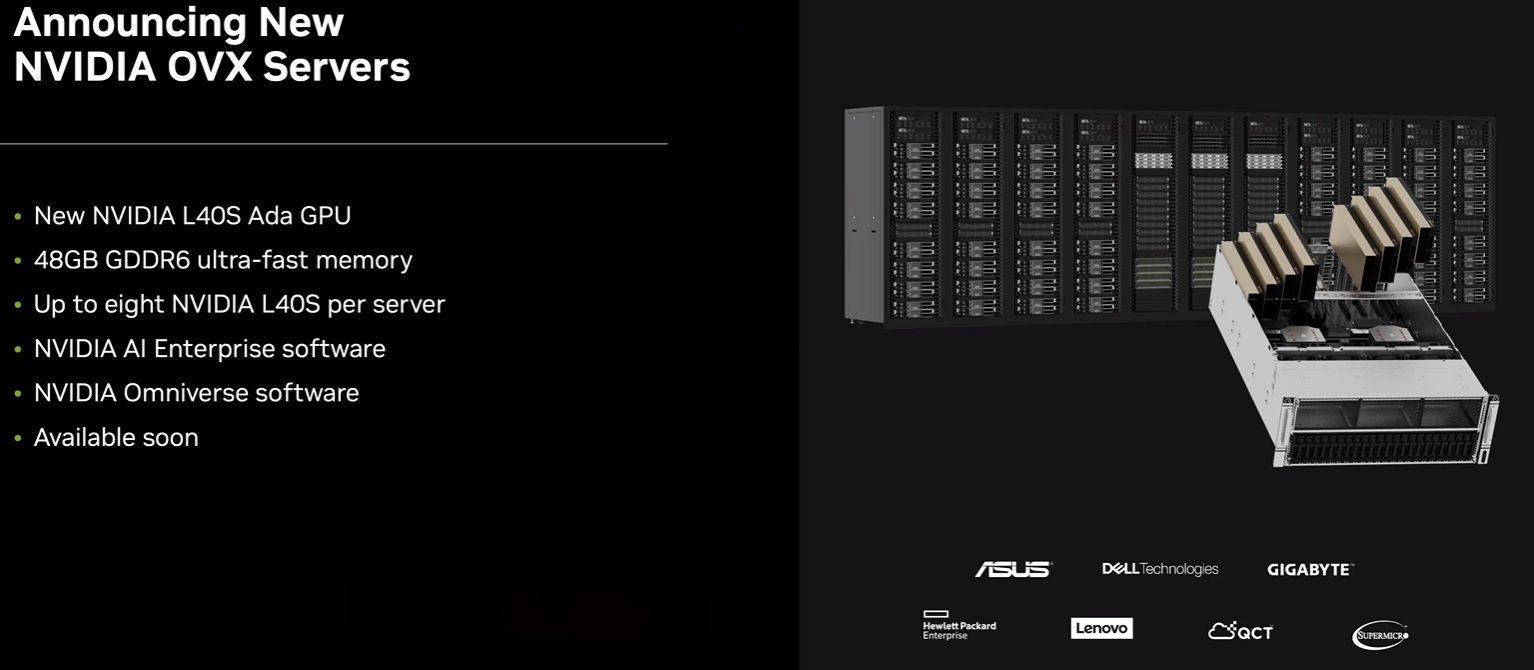

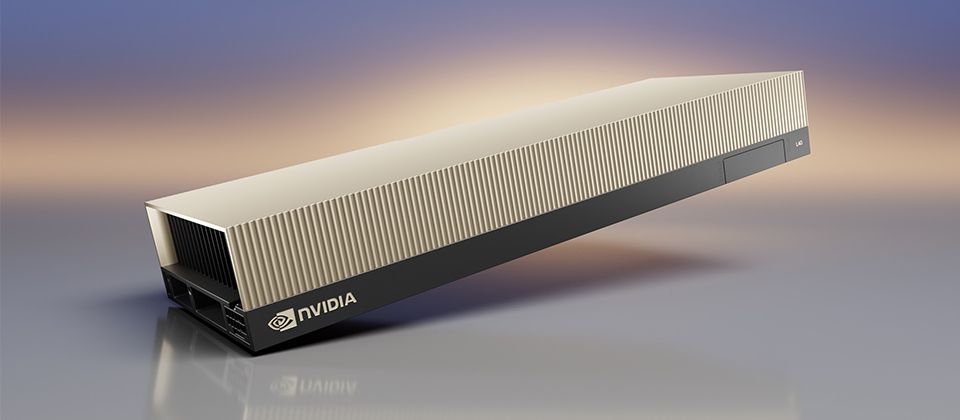

關於導入Ada Lovelace架構的資料中心GPU產品,Nvidia去年上半陸續推出L40、L4,8月初舉行的年度電腦繪圖技術大會SIGGRAPH,他們發表另一個款式的資料中心GPU產品L40S,目的是標榜2022年開始主推的OVX伺服器,搭配該公司持續發展的3D協同工作流程Omniverse平臺,支援數位雙生(Digital twins)的圖像呈現,以及其他用到大量AI與圖形運算的工作負載加速需求,預計秋季將由多家伺服器廠商供應L40S,隨後將提供搭配L40S的OVX系統。

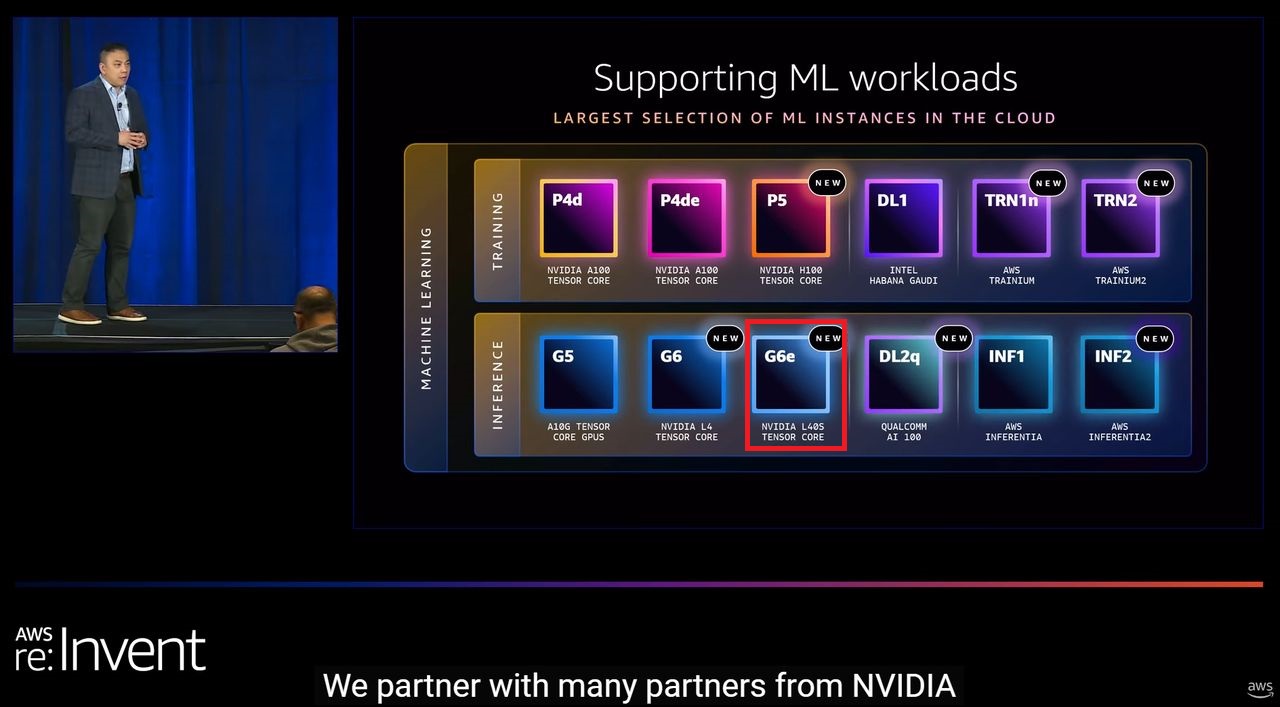

而在幾週之後登場的VMware Explore年度用戶大會,兩家公司宣布將推出支援VMware Private AI Foundation的AI就緒伺服器,預告年底開始供應搭配L40S與BlueField資料處理器的系統,而在後續幾個月內,也將由多家雲端服務業者提供這類型執行個體。果然,9月底召開的甲骨文年度用戶大會Oracle CloudWorld期間,Oracle Cloud Infrastructure(OCI)預告將推出GPU執行個體BM.GPU.L40S.4;11月底AWS年度用戶大會,AWS揭露將推出GPU執行個體EC2 G6e。

到了今年2月底,Nvidia在L40S的網站產品英文介紹頁面當中,終於將「此產品上市時請通知我」的字樣拿下(正體中文版網站仍保有這些敘述),

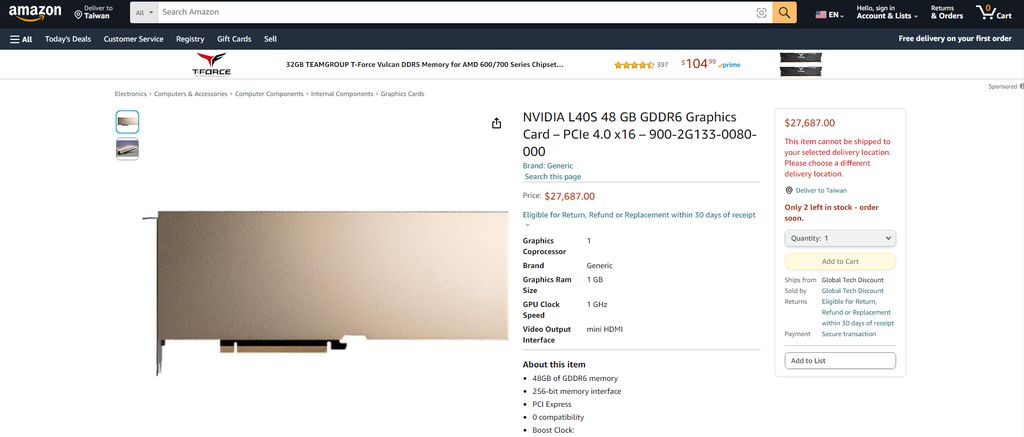

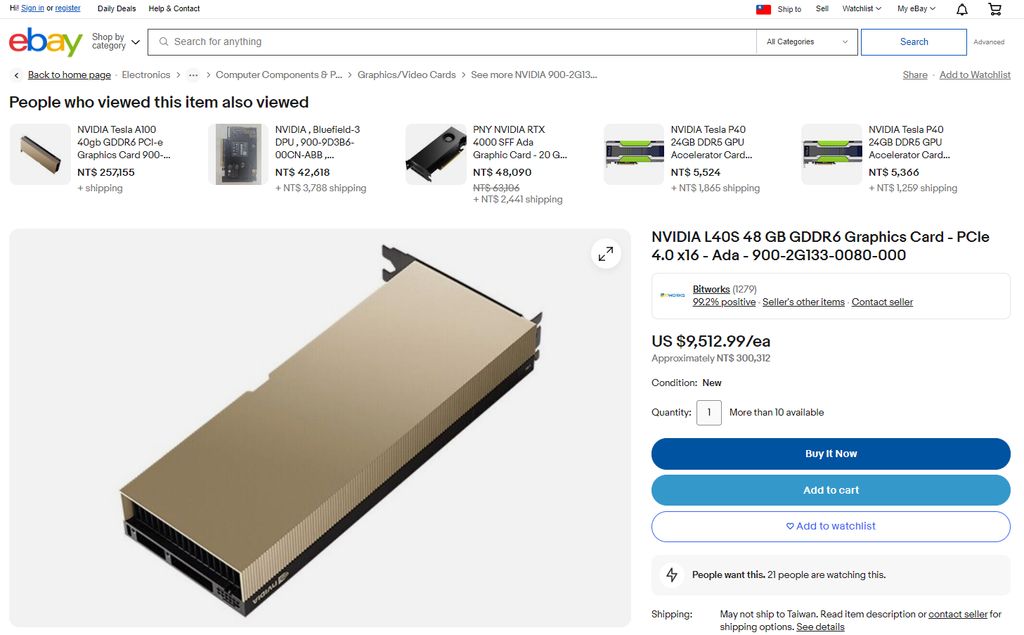

而在臺灣的線上購物網站PC,我們也看到裡面居然陳列L40S,並標示預計出貨日為4月23至25日。

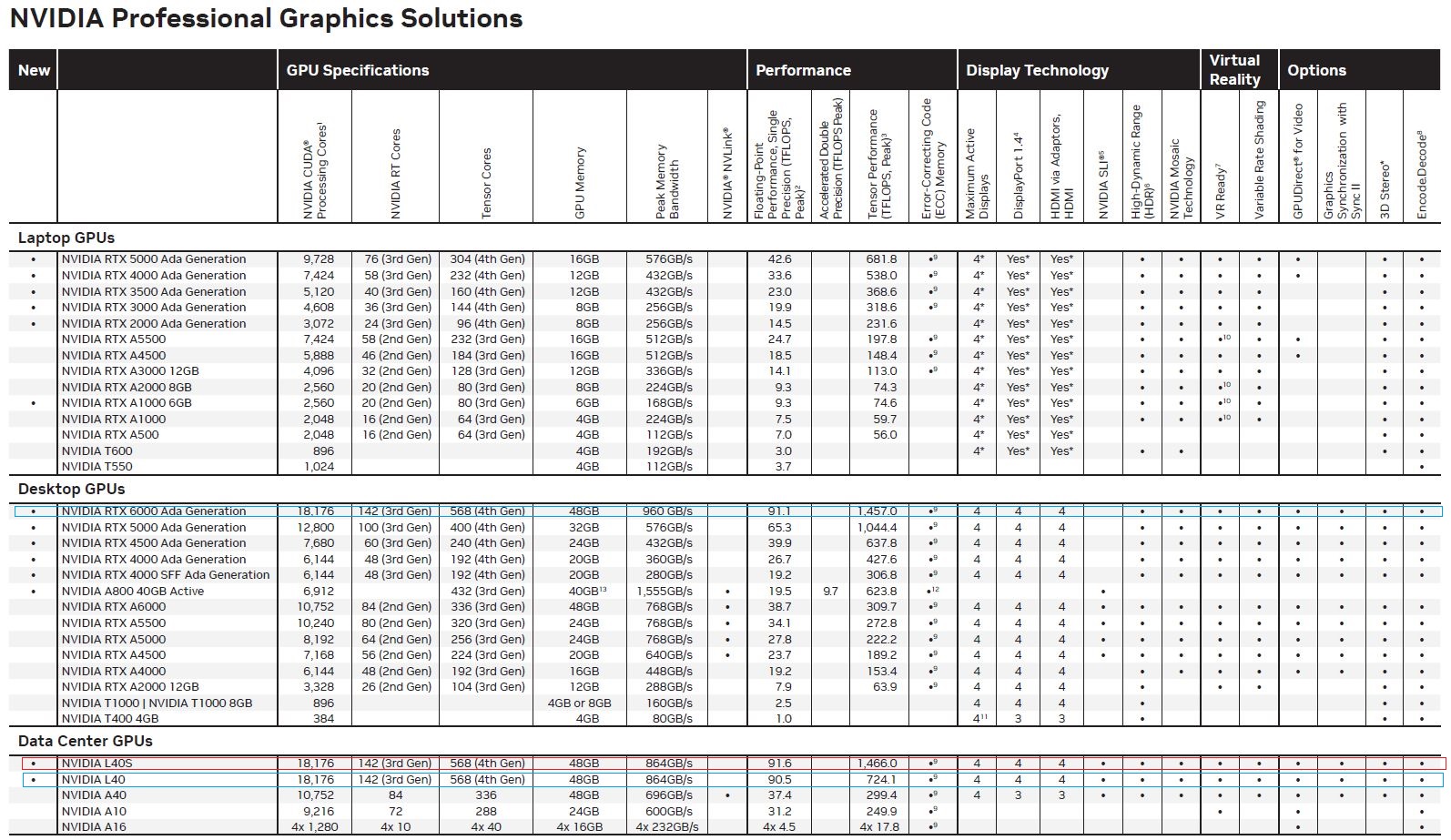

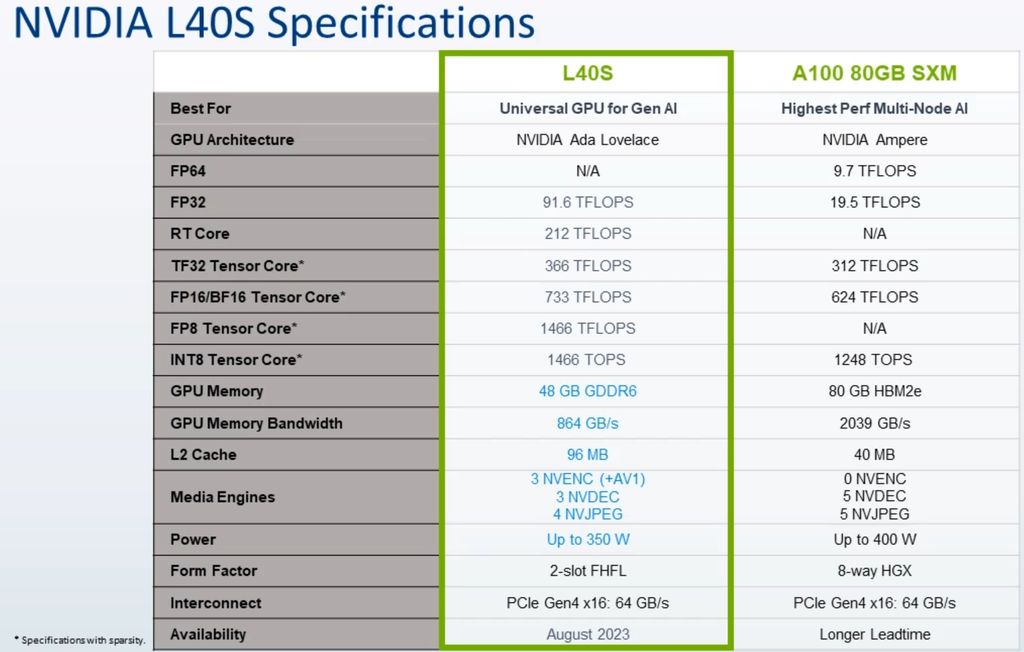

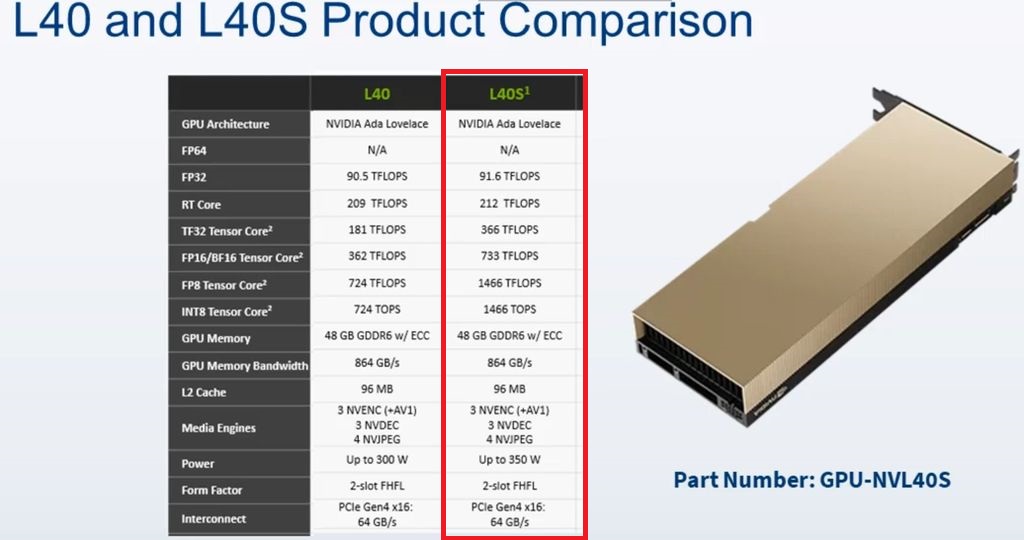

在L40S發表之初,Nvidia先公布產品技術規格,與L40所差無幾,例如,均配備48 GB的GDDR6記憶體,同樣內建18,176顆CUDA核心、568顆第三代Tensor核心,以及142顆第四代RT核心。

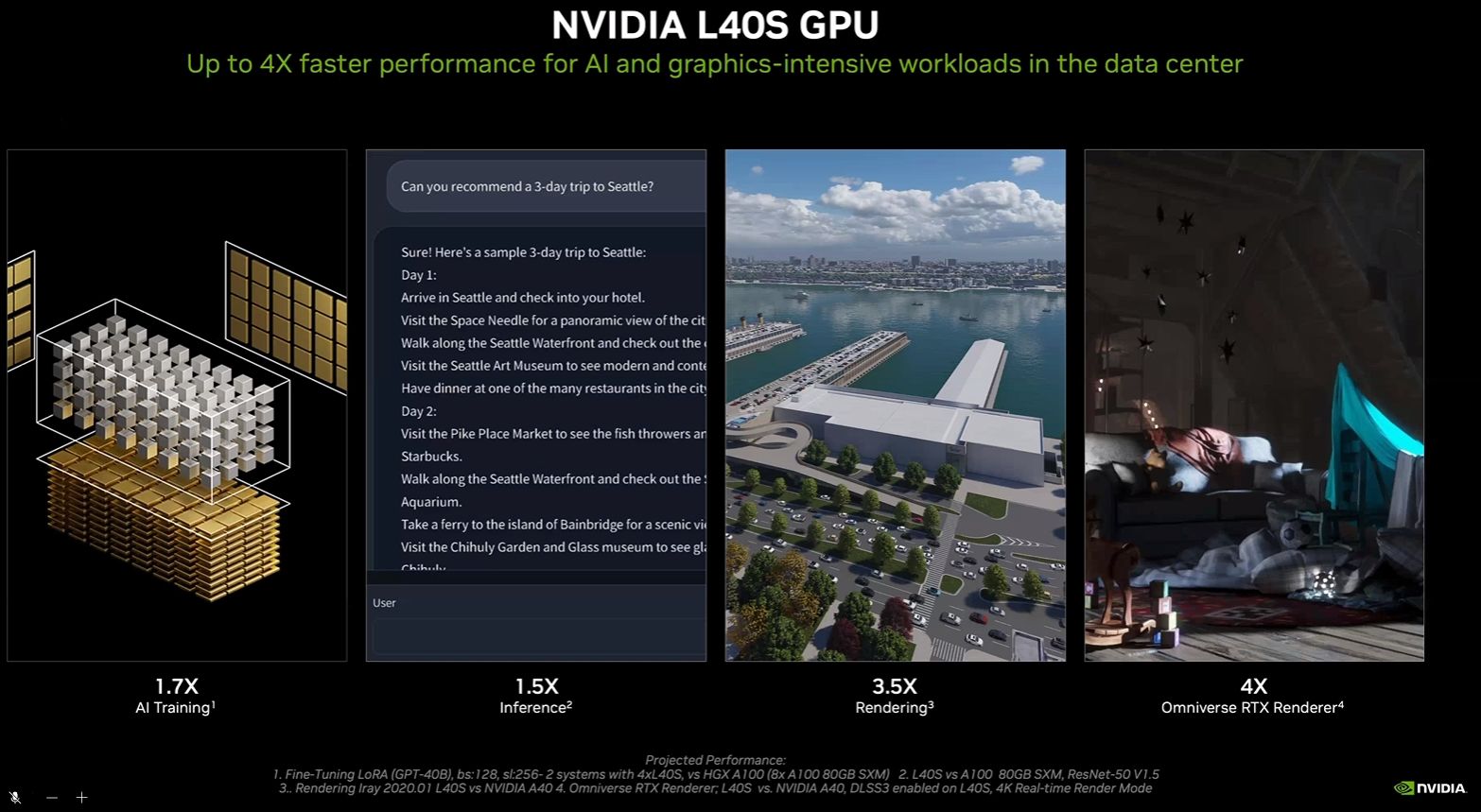

效能方面,L40S的FP32浮點運算為91.6 TFLOPS(L40為90.5 TFLOPS),Nvidia上一代頂級資料中心GPU產品A100,若同樣用於這類運算,僅提供19.5 TFLOPS;而在RT核心浮點運算效能的部分,L40S與L40皆為209 TFLOPS。

而在Tensor核心的運算效能上,這兩款GPU之間就有很顯著的差異,例如,TF32、BF16、FP16、FP8、Peak INT8、Peak INT4,都領先了1倍,部分類型的運算甚至最高可達到1.45 PFLOPS,可加速複雜的運算與資料密集型分析作業。

既然L40s具有更高超的效能,因此,L40S的熱設計功耗較高,可達到350瓦,L40則是300瓦。

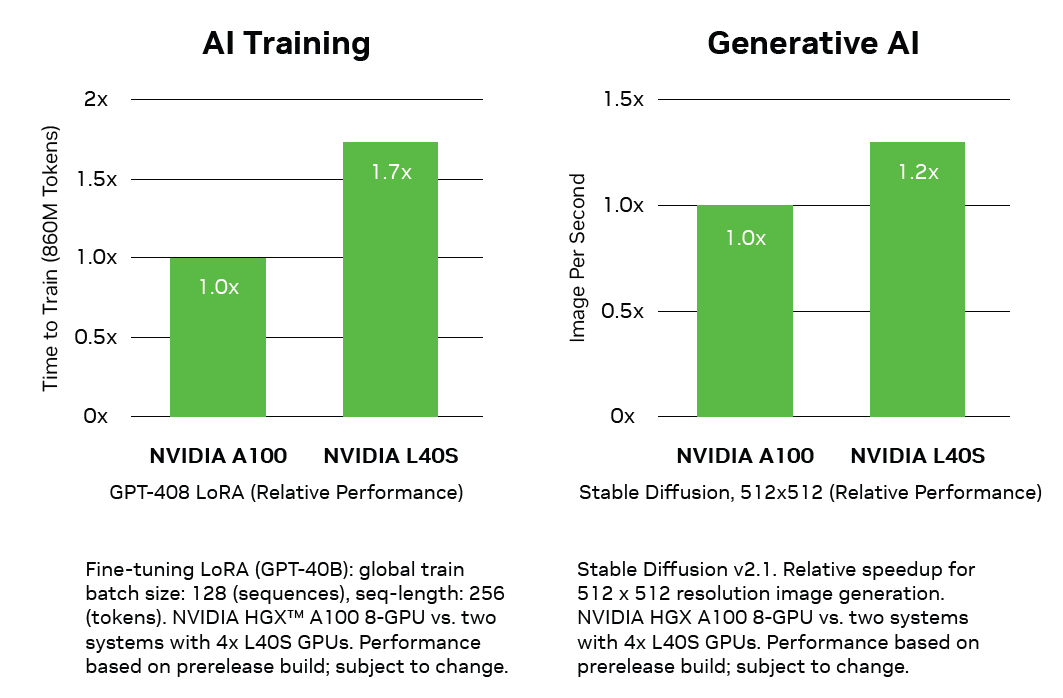

若就AI應用效能而言,比起A100,L40S也有顯著改善,例如,推論能力提升20%,訓練能力增強70%。

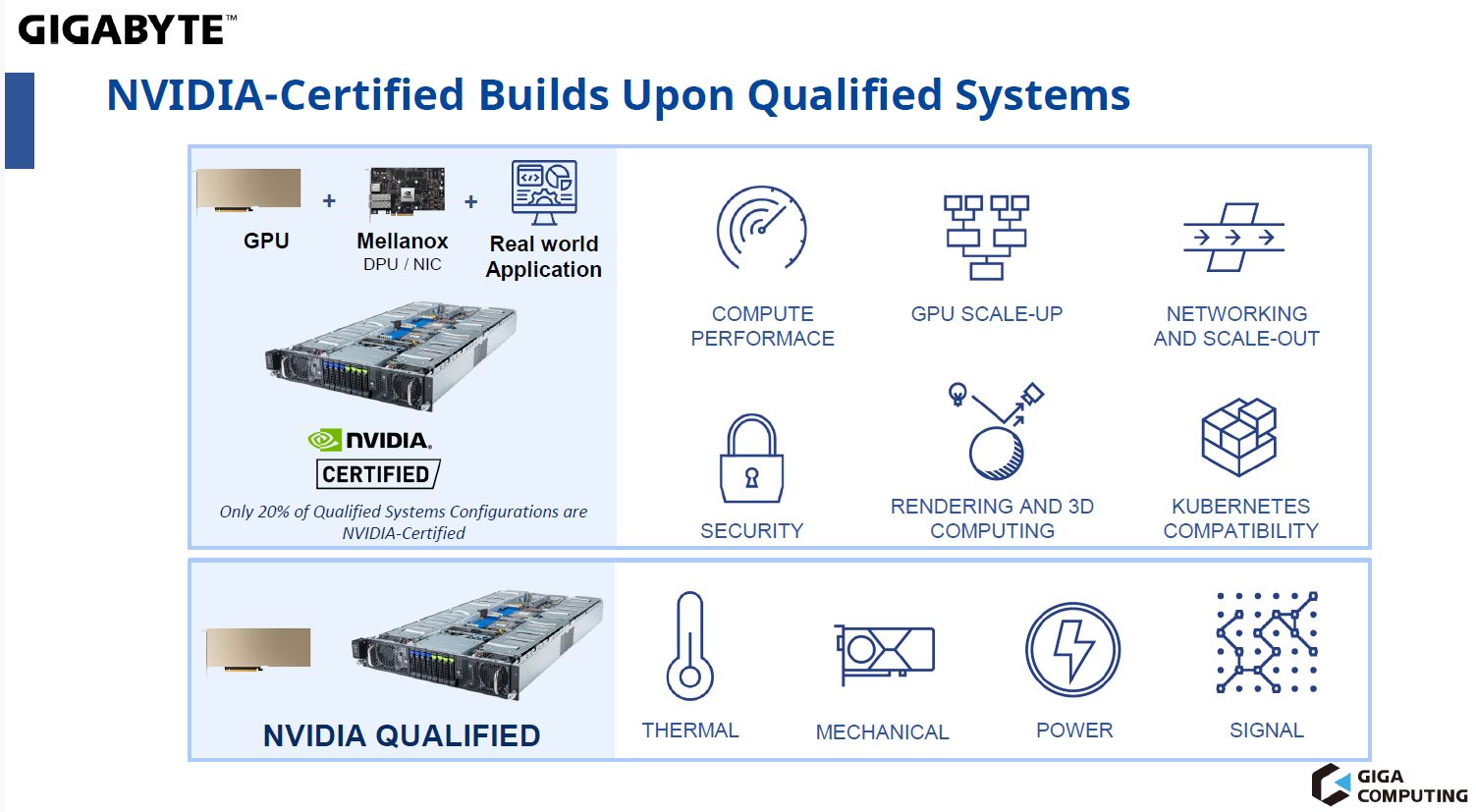

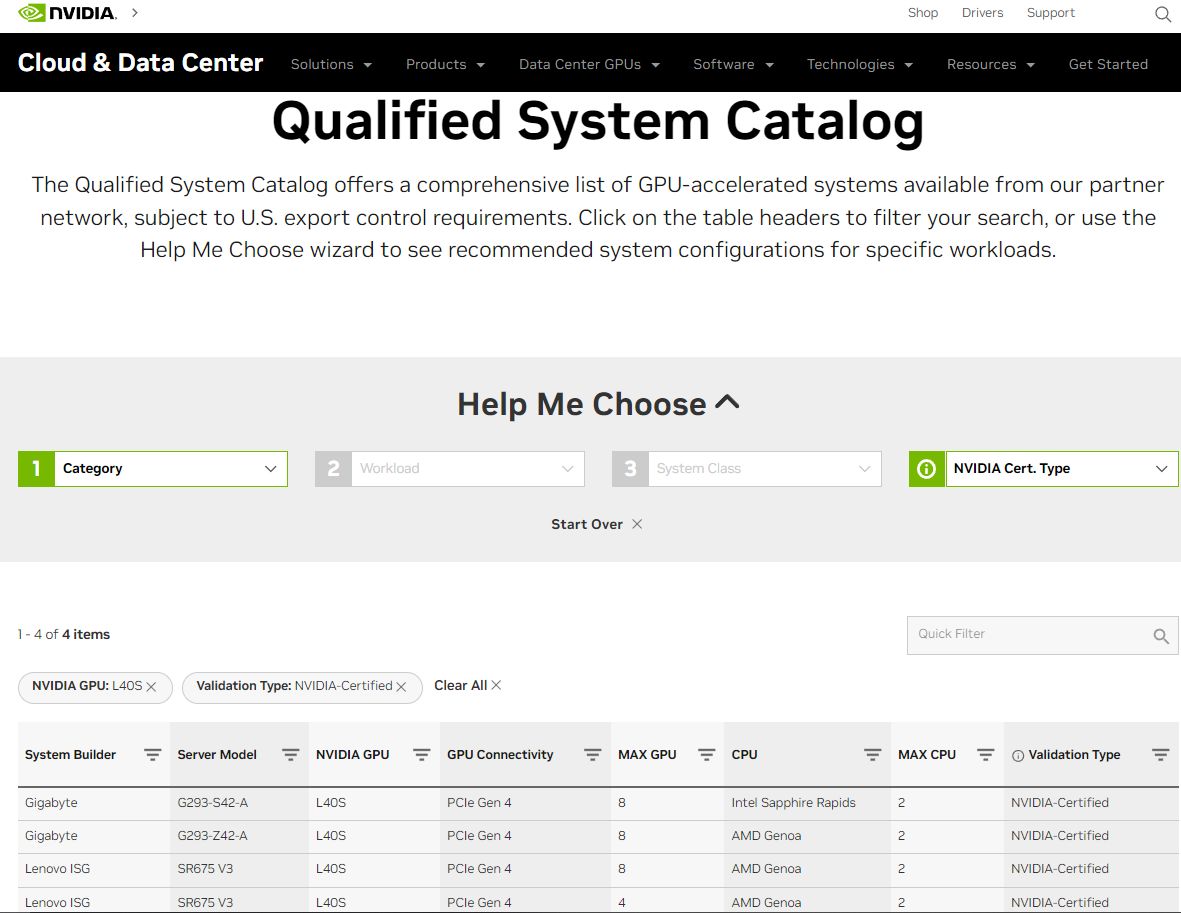

而從2023年8月發表至今,L40S已陸續有多款伺服器採用。根據Nvidia認證系統型錄來看,有67款Nvidia認可(Qualified)的機型搭配L40S,提供最多機型的前三大廠牌,依序是Supermicro(18款)、技嘉(15款)、華碩(13款),我們先前介紹的雲達QuantaGrid D54U-3U,就是其中之一而通過Nvidia-Certied認證的,有3款機型,分別是:技嘉的G293-S42-A、G293-Z42-A,以及聯想的SR675 V3。

若以Nvidia這幾年圖形運算整合伺服器平臺OVX來看,也可以發現他們搭配的GPU與網路介面組態變化,這當中也突顯L40S成為最新搭配的主力產品

例如,Nvidia先在2022年3月發表第一代系統的參考設計,搭配8張GPU產品Nvidia A40,以及3張網路卡Nvidia ConnectX-6 Dx;同年9月發表的第二代OVX伺服器,預告2023年上半將搭配8張GPU產品Nvidia L40,以及3張網路卡Nvidia ConnectX-7;2023年3月揭露第三代OVX運算系統,搭配4張GPU產品Nvidia L40、2張網路卡Nvidia ConnectX-7,以及資料中心處理器BlueField-3,Nvidia當時表示,預計稍晚推出此項設計。

目前他們已公布最新一代OVX伺服器配置,就GPU而言,他們提供搭配4張L40S GPU與8張L40S的選擇,前者採用32核心的英特爾第四代Xeon Scalable處理器(Xeon Gold 6448Y),或32核心的AMD第四代EPYC處理器(AMD EPYC 9354),後者採用56核心的英特爾第四代Xeon Scalable處理器(Xeon Gold 8480),或AMD第四代EPYC處理器(AMD EPYC 9554);記憶體容量分別是384 GB以上、768 GB以上;網路介面的部分,就南北向傳輸而言,分別搭配2張、4張ConnectX-7(200Gb),就東西向傳輸而言,均搭配1張BlueField-3(B3220)。

產品資訊

Nvidia L40S

●原廠:Nvidia

●建議售價:廠商未提供

●CUDA處理核心數量:18,176顆

●Tensor核心數量:568顆

●RT核心數量:142顆

●內建記憶體容量:48 GB GDDR6

●記憶體頻寬:864 GB/s

●連接介面:PCIe 4.0 x16

●支援NVLink:否

●單精度浮點運算效能:91.6 TFLOPS

●外觀尺寸:雙槽全高

●DisplayPort埠:1.4a版規格,4個

●耗電量:350瓦

【註:規格與價格由廠商提供,因時有異動,正確資訊請洽廠商】

熱門新聞

2026-02-02

2026-02-03

2026-02-04

2026-02-02

2026-02-04

2026-02-03

2026-02-05