人工智慧席捲全球,雲端服務業者爭相擴充硬體加速運算解決方案,不只是積極與GPU、FPGA等運算平臺廠商合作,陸續推出搭配這些產品的執行個體服務,他們本身也投入AI加速晶片的開發,並且持續關注市面上其他的發展,開始提供搭配這些硬體加速器的雲端服務。

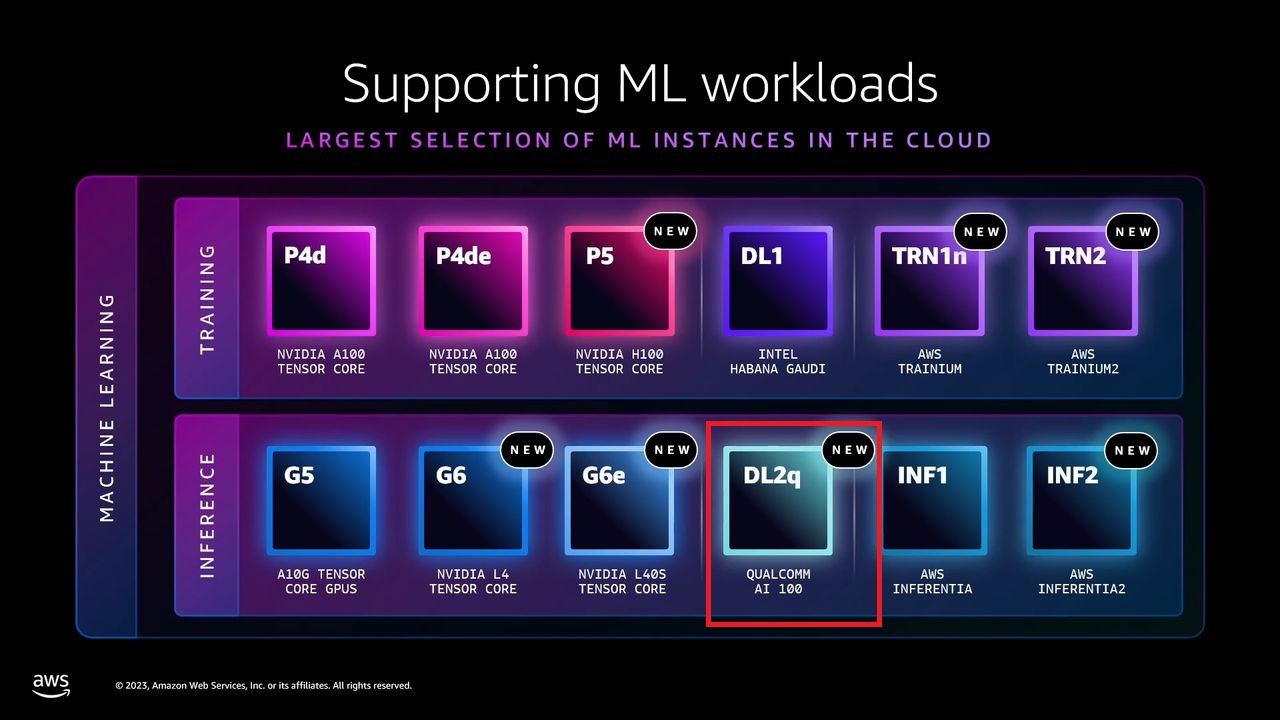

以陣容最豐富的AWS而言,目前提供的GPU執行個體服務與搭配的GPU產品,包含Amazon EC2的P5(Nvidia H100)、P4(Nvidia A100)、P3(Nvidia V100)、G5G(Nvidia T4G)、G5(Nvidia A10G)、G4(Nvidia T4、AMD Radeon Pro V520);FPGA執行個體服務與搭配的FPGA產品,有Amazon EC2的F1(AMD / Xilinx Virtex Ultrascale+ VU9P)、VT1(AMD / Xilinx Alveo U30);搭配自行開發AI晶片的執行個體服務,有Amazon EC2的Inf1(AWS Inferentia)、Inf2(AWS Inferentia2)、Trn1(AWS Trainium);採用其他廠商開發AI晶片的執行個體服務,有Amazon EC2的DL1(英特爾Gaudi),以及最新登場的DL2q(Qualcomm Cloud AI 100)。

Amazon EC2 DL2q是在2023年11月中問世,當中採用的AI加速卡Qualcomm Cloud AI 100,是高通公司於2019年4月發表的,而這套雲端加速運算服務的正式上線,也標示AWS是第一家將其引進自家運算服務產品線的公有雲業者,初期開放美國西部的奧勒岡、歐洲的法蘭克福等兩個區域使用。

關於Qualcomm Cloud AI 100,我們曾於2022年4月報導,當時提到2021年他們與伺服器廠商技嘉科技合作推廣,該公司的G292-Z43機型可搭配16張Qualcomm Cloud AI 100,提供6.4 Peta OPS運算能力,到了2023年下半,聯想與HPE陸續宣布旗下伺服器搭配Qualcomm Cloud AI 100的消息,11月又有Cirrascale、AWS這兩家雲端服務業者,推出搭配這張AI加速卡產品的運算服務。

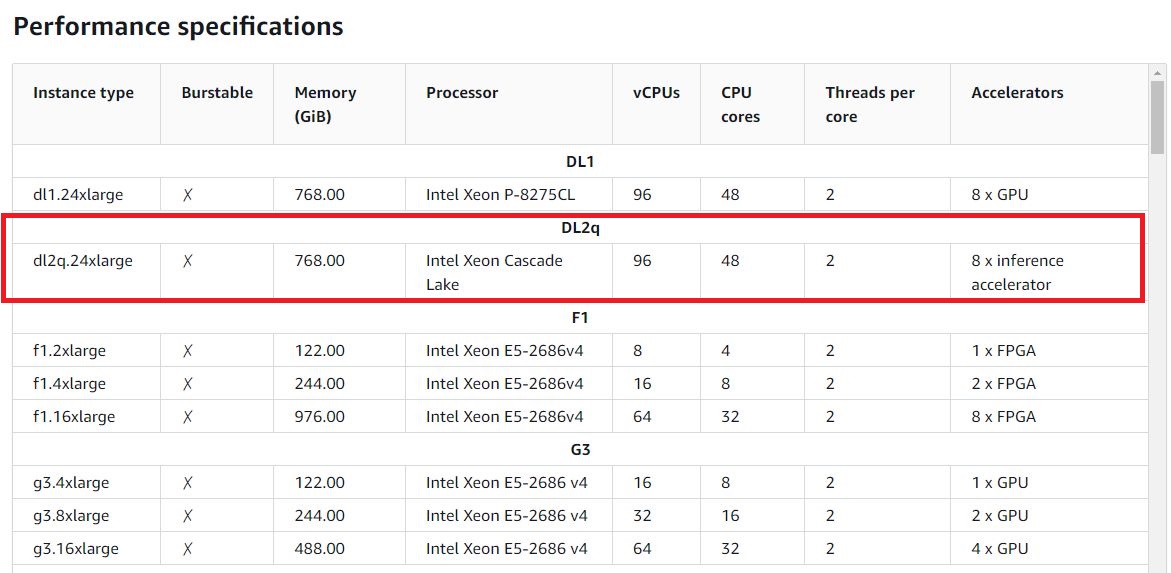

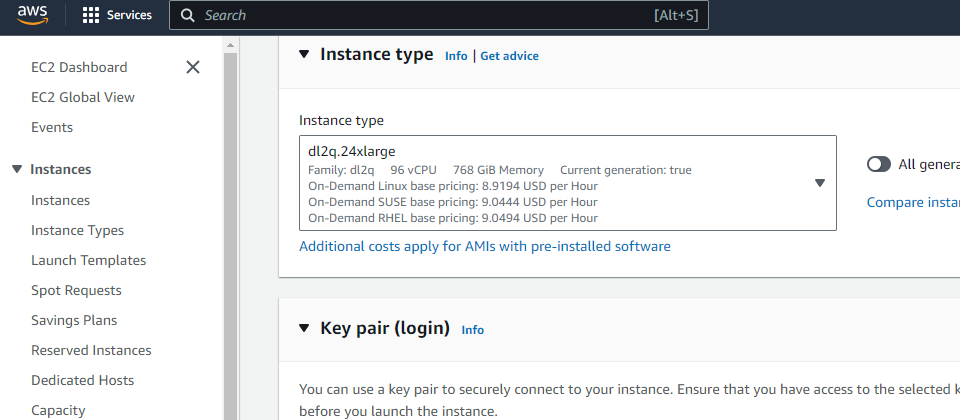

對於AWS而言,Amazon EC2 DL2q目前僅提供1種組態:dl2q.24xlarge,配備8張Qualcomm Cloud AI 100(各自內建16 GiB記憶體),匯聚這些加速運算資源之後,總共能運用112顆AI核心、128 GB記憶體(記憶體頻寬為1.088 TB/s),Int8整數推論效能可達2.8 PetaOps,FP16推論效能為1.4 PetaFlops。

這裡的CPU採用英特爾第二代Xeon Scalable(Cascade Lake架構),提供96顆虛擬處理器,配置768 GiB記憶體,網路頻寬為100 Gbps。用戶可在這個雲端運算服務當中,執行內容產生、文字摘要、虛擬助理等常見的生成式AI應用,像是,以及自然語言處理、電腦視覺等傳統AI應用。

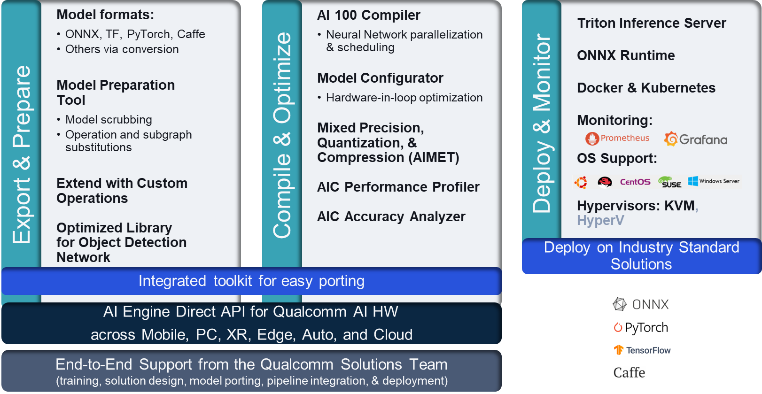

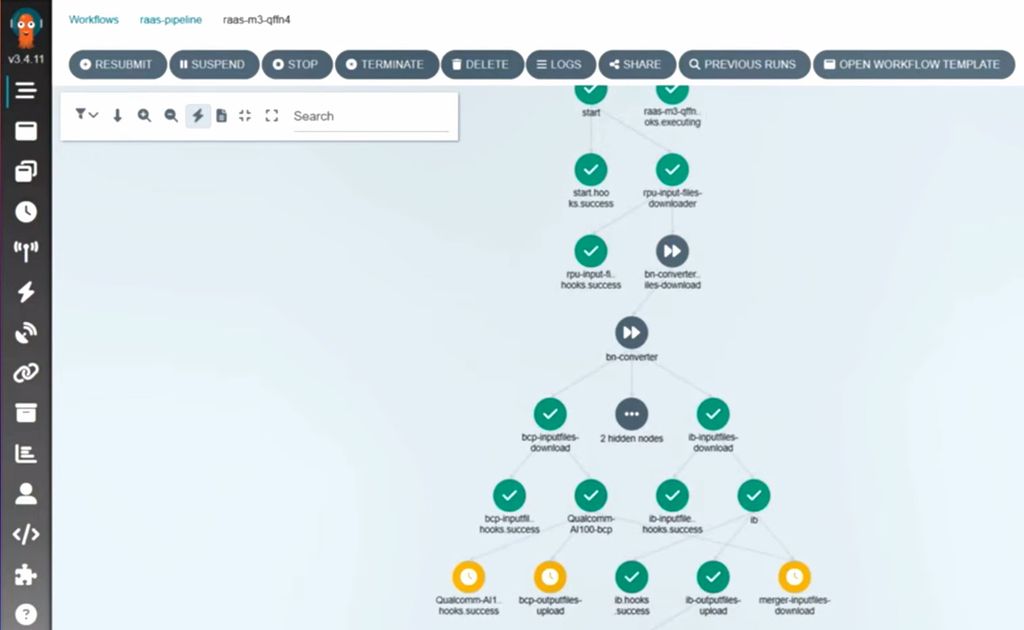

而在軟體開發的協助上,DL2q用戶可藉由AWS專為Qualcomm AI加速器提供的深度學習系統映像檔(Deep Learning AMI,DLAMI),快速投入相關的工作。這套DLAMI預先打包Qualcomm的軟體開發套件,以及PyTorch、TensorFlow等常用的機器學習框架,若搭配存放在AWS環境的實體與模擬資料,AWS宣稱可大幅減少用戶成本,開發相關應用的時間也從數週縮減至數小時。

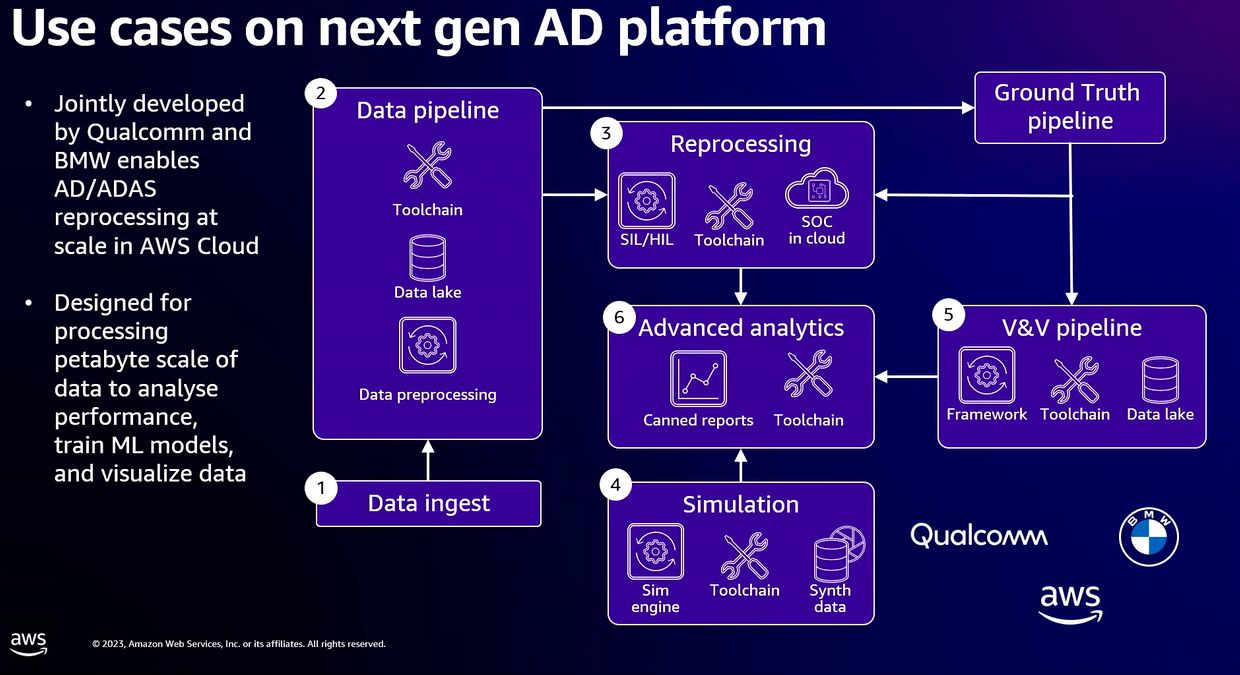

關於企業使用案例,AWS宣布BMW集團將是首家採用Amazon EC2 DL2q的汽車製造商,用於開發下一代汽車Neue Klasse標榜的自動駕駛功能,此項車用技術預計2025年推出,他們表示,透過這項合作,也展示雲端技術與軟體定義車輛的設計、開發之間的整合,將有助於部署時程的加速。

其實,AWS、高通、BMW相關的合作,早在同年9月露出一些端倪。當時BMW集團預告將開發下一代進階駕駛輔助系統(ADAS),裡面提到採用AWS雲端服務來發展Neue Klasse的新功能,其中包含既有與AWS合作發展的Cloud Data Hub,以及AWS旗下的運算、生成式AI、物聯網、機器學習等功能,加速推出高度自動化運作的汽車,該公司也談到與高通公司的合作,包含雙方共同開發的下一代自動駕駛系統,將基於開放、模組化的Snapdragon Ride Platform而成,以及與AWS、高通合作發展的自動駕駛開發平臺,當中將結合先進的硬體、軟體、雲端功能,高通公司資深副總裁暨汽車與雲端運算部門總經理Nakul Duggal針對促成BMW集團技術創新的關鍵技術時,不僅標榜Snapdragon Ride Platform,還特別提到Qualcomm Cloud AI 100,但從當時發布的內容來看,大家很難猜到這張AI加速卡會以AWS雲端服務的形式來供應。

產品資訊

AWS Amazon EC2 DL2q

●原廠:AWS

●建議售價:隨需購買每小時8.9194美元

●基礎運算規格:英特爾第二代Xeon Scalable處理器、768 GiB記憶體

●提供服務規模選擇與組態:dl2q.24xlarge,96顆虛擬處理器、768 GiB記憶體、8張Qualcomm Cloud AI 100、網路頻寬為100 Gbps,網路儲存:使用AWS區塊儲存服務EBS,存取頻寬為19 Gbps

●軟體堆疊架構:Qualcomm Cloud AI SDK(Apps SDK、Platform SDK)

【註:規格與價格由廠商提供,因時有異動,正確資訊請洽廠商】

熱門新聞

2026-02-06

2026-02-06

2026-02-09

2026-02-06

2026-02-06

2026-02-06

2026-02-06