Marvell

當前CXL產品應用重點,聚焦記憶體擴充模組,以及記憶體池。

除了這兩種主流產品型態,過去1年多,陸續有廠商發表新的CXL產品應用概念,進一步擴展了CXL技術應用面向,其中最吸引我們的,是下列3家廠商的解決方案與產品,包括:Marvell的記憶體加速器晶片,Panmnesia的CXL-GPU記憶體共享解決方案,以及UnifabriX的UnifabriX MAX記憶體池。

這些產品方案有個共同點:可以更直接地支援AI運算。

在CXL技術誕生的2019年,生成式AI技術尚未崛起,因此,當時CXL應用的重點,放在擴展伺服器CPU的記憶體運用能力,打破CPU的記憶體瓶頸。

但隨著生成式AI技術的爆發性發展,資料中心的運算力需求,也從CPU轉到GPU,這也讓圍繞著CPU打造的CXL技術失去著力點。CXL裝置所提供的記憶體資源,都是是配置給伺服器主機的CPU存取,而非提供給GPU。

儘管CXL產品近來也強調對於AI訓練資料預處理的助益,藉由CXL記憶體模組為CPU所擴展的記憶體空間,可預載更多資料、減少載入時間、加速預處理過程,但這些都只算是讓CXL裝置「間接地」幫助AI與GPU運算,總有隔靴搔癢之感,沒有「直接」參與AI運算。

而這3家廠商則從不同面向,讓CXL裝置更直接地參與AI應用的運算過程。

CXL記憶體加速器

CXL控制器是CXL周邊設備的核心,負責記憶體模組對外連接,執行CXL協定存取,一些CXL控制器還能支援CXL 2.0的資料完整性與加密(IDE),提供AES加、解密與驗證功能。

控制器晶片大廠Marvell則更進一步,在2024年7月發表的Structera系列CXL記憶體擴展控制器,,內含更多運算功能,不僅整合有AES加解密功能,還整合有LZ4即時壓縮/解壓縮引擎。

不僅如此,Marvell這系列產品中的A 2504款式,本身還含有內建16顆核心的Arm Neoverse CPU,可用於執行運算工作,無須先將資料讀取、存放到伺服器CPU,而是單靠CXL記憶體模組,就能完成運算工作,適用於對延遲敏感的任務,例如:AI推論運算、深度學習推薦模型(DLRM),記憶體資料庫等,該項能力也讓這款控制器超越一般CXL控制器範疇,Marvell將其稱為「CXL近記憶體加速器」(near-memory accelerator),也就是靠近記憶體的運算加速器。

Structera A2504的基本概念,類似SK Hynix在2022年底OCP大會展出的運算型記憶體解決方案(CMS),都是具備運算能力的CXL擴充記憶體,但SK Hynix的CMS只是概念展示的原型;而Marvell的Structera則是正式的產品,2024年第4季便能向用戶提供樣品。

CXL-GPU記憶體共享解決方案

韓國廠商Panmnesia在2024年10月OCP大會中,首次提出讓CXL記憶體裝置直接支援GPU,暫稱為CXL-GPU記憶體池解決方案構想,後來在CES 2025大會展出時,該公司正式將這套解決方案更名,稱之為「基於CXL的GPU擴展套件」(CXL-based GPU Memory Expansion Kit)。

大規模生成式AI運算受限於GPU記憶體容量,然而,GPU配置的HBM記憶體,通常不過數十GB等級,但AI運算需要的記憶體空間,卻可能高達數百GB以至TB等級。而在傳統GPU運算架構之下,用戶只能透過增加設置GPU卡或GPU伺服器的方式,來取得更多記憶體資源,但這種硬體擴充作法不僅成本高昂,也沒有精確對應實際的使用需求。

而他們的CXL-GPU解決方案,則能利用外部的CXL記憶體裝置,為GPU伺服器叢集提供彈性配置的記憶體資源,以更低的成本滿足TB等級的記憶體需求,進而降低GPU伺服器的建置成本。

我們可將Panmnesia這套解決方案,看作專門針對GPU伺服器的CXL記憶體池.他們所用的基本概念,是透過Panmnesia的CXL 3.1交換器晶片,以及CXL SoC晶片,建立分解GPU運算資源與記憶體資源的AI運算架構,讓GPU節點經由CXL交換器的介接,存取同分散式記憶體池,也能透過Panmnesia CXL控制器構成的主機端橋接裝置,將GPU的HBM記憶體,與其他CXL記憶體裝置組成統一的虛擬記憶體空間,進而藉由外部記憶體資源擴展GPU可用記憶體。

CXL外接布線架構新發展

UnifabriX是致力於CXL記憶體池解決方案的以色列新創廠商,相較於同類廠商,吸引人之處在於引進新的CXL外接布線架構,試圖藉此達到兼顧CPU與GPU記憶體資源運用的目的。

CXL是基於PCIe實體層的延伸應用,需要藉助PCIe外接介面與纜線,才能夠實現外接形式的CXL記憶體池應用。UnifabriX表示,在PCIe 4.0時期,可透過SFF-8644 mini-SAS連接埠與纜線,來提供PCIe 4.0的外接應用。但是,對於CXL使用的PCIe 5.0與6.0,目前缺乏成熟的解決方案,因而記憶體池廠商是從乙太網路領域尋求臨時解決方案,例如QSFP-DD(x8),以及CDFP(x16)等,如Liqid與H3 Platform的記憶體池機箱,都是採用CDFD(x16)作為外接連接介面。

而UnifabriX則為他們的UnifabriX Max記憶體池選擇QSFP MSA,作為外接連接埠規格,包括8鏈路的QSFP與16鏈路的QSFP-XD,每條鏈路可支援224G PAM信號速率,能相容於PCIe 5.0/CXL 1.x與2.0的32G NRZ信號,PCIe 6.0/CXL 3.x的64G PAM信號,甚至是未來PCIe 7.0的128G PAM信號,UnifabriX也在電氣傳輸規格,為發展中的UALink加速器互連介面做準備,與UALink相容。

UnifabriX MAX目前提供6組CXL 1.1/2.0 QSFP-XD前端埠,用於與主機連接的,加上2組112G QSFP-XD後端埠,用於記憶體池機箱互連。UnifabriX聲稱,藉此可在後端提供遠高於CXL的標準傳輸速度,相當於NVLink 4。而他們正在發展速度提高到224G的版本,相當於NVLink 5。

他們最終的目標,是待UALink發展完成後,讓UnifabriX MAX記憶體池混合使用CXL與UALink傳輸埠,兩者的實體層,都使用相同的QSFP與QSFP-XD連接埠,只需依需求調整設定,就能分別透過CXL或UALink,來為CPU或GPU提供外部記憶體資源,進而獲得最大的記憶體資源配置彈性。

向AI應用靠攏

我們前面提過,近幾年來隨著生成式AI技術崛起,讓資料中心運算力需求,從CPU向GPU的轉移,導致CXL這項以CPU為核心的技術失去著力點,是造成CXL應用進展緩慢的原因之一。

而Marvell、Panmnesic與UnifabriX等廠商,新近發表的這幾項新產品概念,則展現CXL技術直接用於AI運算,以及直接支援GPU記憶體運用的潛力,這些現象可視為克服CXL推廣困境的一項解答——更加靠攏AI應用,從而為CXL產品尋求更廣泛的應用需求。而這樣的發展方向,可望在未來獲得更多重視,成為推動CXL技術應用擴展的關鍵要素。

Marvell的CXL記憶體加速器

.jpg)

Marvell Structera A系列CXL記憶體擴展控制器,不僅能增加伺服器的記憶體資源,還能透過內含的Arm Neoverse CPU,為伺服器提供額外的運算能力,如Marvell圖中的舉例,為96核心伺服器安裝2組Structera A加速器,能增加50%的處理器核心數,以及兩倍的記憶體頻寬。圖片來源/Marvell

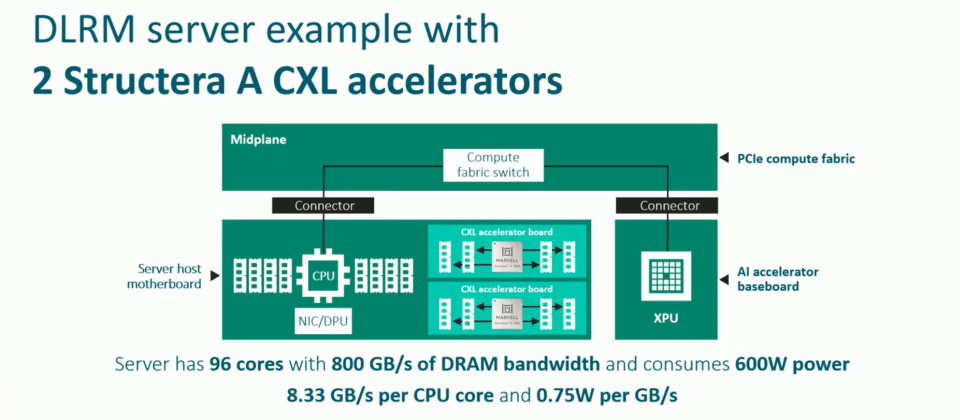

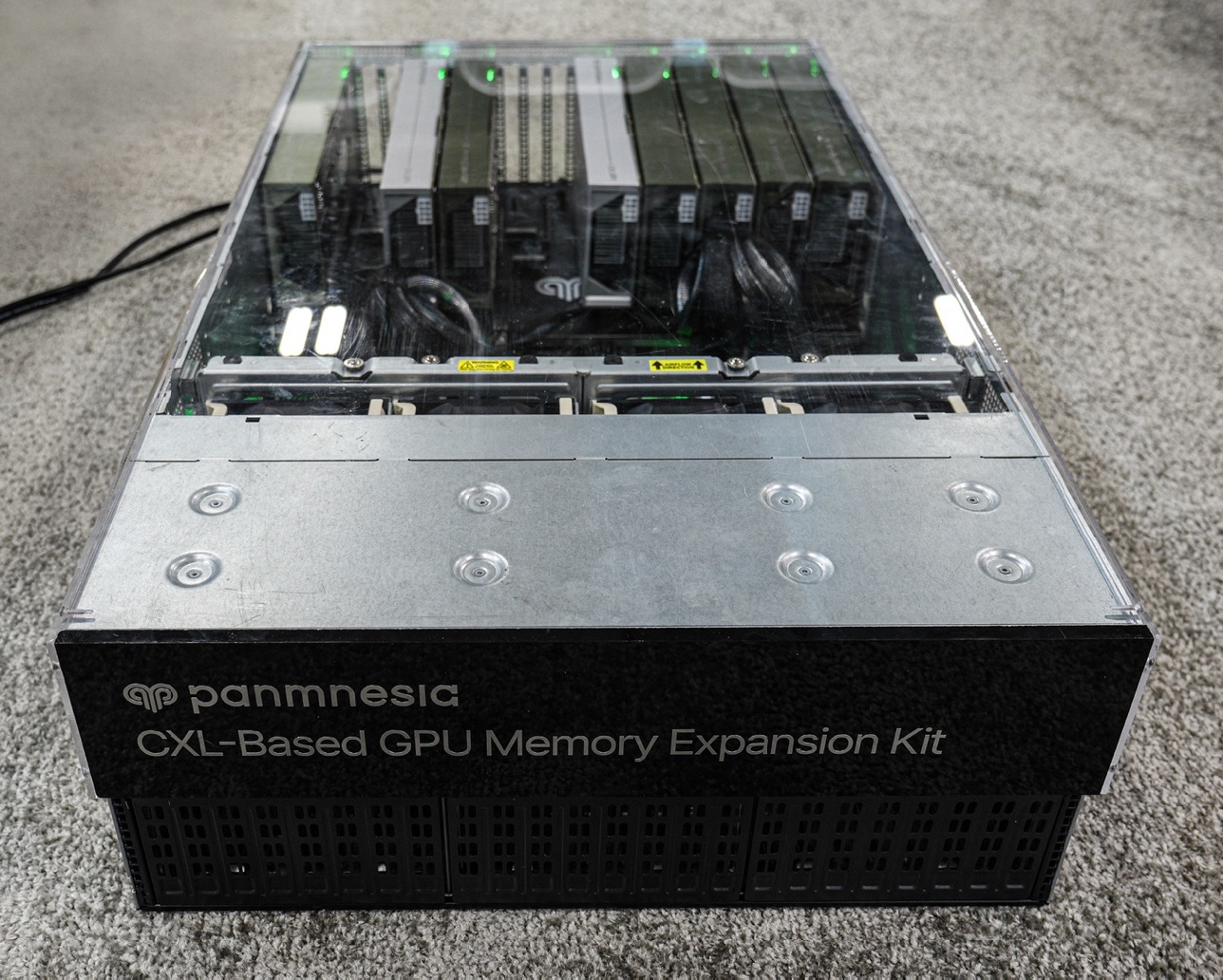

Panmnesic的CXL-GPU記憶體擴展套件

透過專屬的CXL控制器與主機端橋接架構,Panmnesic的CXL-GPU記憶體擴展套件,可從外部為GPU提供額外的記憶體資源,讓GPU不再被卡版上搭載的HBM記憶體容量所限制。圖片來源/ Panmnesic

UnifabriX的CXL外接布線架構

UnifabriX率先採用基於224G PAM4信號傳輸速率的QSFP-XD,作為其CXL記憶體池機箱與前端主機間的外接傳輸介面,可提供空前的高頻寬,也為日後相容UALink介面、支援GPU應用做好準備。圖片來源/UnifabriX

熱門新聞

2026-02-06

2026-02-09

2026-02-06

2026-02-09

2026-02-06

2026-02-06