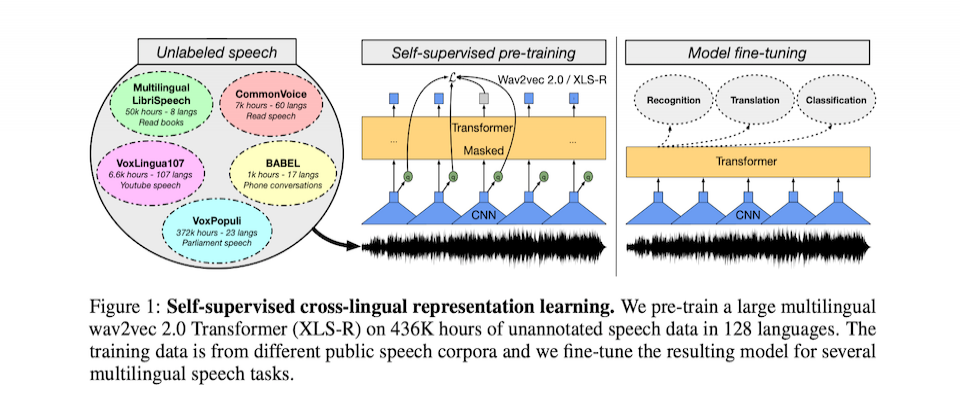

Meta旗下臉書AI研究院發表一套語音辨識預訓練模型XLS-R,具20億個參數,可辨識128種語言,整個模型用了43萬6千多小時的公開語音檔案訓練而成,比前一代XLSR-53模型還要多了10倍。

重點新聞(1126~1201)

Meta 語音辨識 XLS-R

Meta開源懂128種語言的大型語音辨識預訓練模型

Meta旗下臉書AI研究院開源一套大型語音辨識預訓練模型XLS-R,是一套自監督學習模型,具20億個參數、懂128種語言,能執行多種語音相關任務。這套模型架構是以臉書AI研究院先前打造的wav2vec 2.0為基礎,整個模型用了43萬6千多小時的公開語音檔案訓練而成,比前一代XLSR-53模型還要多了10倍。

團隊表示,他們這次用了各種主題的語音資料,從法庭程序到有聲書都包括在內,語言種類更是比前一代多了2.5倍。他們認為,XLS-R雖是單一模型,但能執行多語言任務,為驗證這個想法,團隊微調了XLS-R,讓它執行語音辨識、語音翻譯、語言辨識等任務,並在多個測試基準拿下高階表現,如BABEL、CommonVoice、VoxPopuli、CoVoST-2和VoxLingua107等。臉書AI研究員表示,XLS-R是一個重要進展,代表跨語言預訓練模型,能有效改善資源不足的語言表現。(詳全文)

AWS 機器人服務 IoT RoboRunner

AWS發布企業級機器人服務預覽版,要加速機器人App開發和部署

AWS在近日年會re:Invent上發布新服務AWS IoT RoboRunner預覽版,是一款專為機器人應用設計的服務,可讓企業更容易打造和部署機器人App,方便集中管理各種類型的機器人。

進一步來說,這款服務是建立在AWS倉庫中已使用的機器人管理技術,能讓使用者將機器人和現有的自動化軟體連結起來,來統一管理機器人。使用者也能在服務中的集中式資料庫整合數據、進行標準化,如功能、地點、任務等。開發者可用IoT RoboRunner來存取建立App所需的資料,也能利用內建的軟體函式庫來打造任務App,如工作分配等。此外,IoT RoboRunner還能以API整合至企業的儀表板,來讓使用者查詢機器人表現指標和KPI。與此同時,AWS也揭露AWS機器人新創加速器,與非營利組織MassRobotics聯手,來解決機器人自動化、IoT技術中的難題。(詳全文)

Nvidia GauGAN2 圖像生成

Nvidia發布新一代AI藝術應用GauGAN2,一句話就能生成精美風景圖

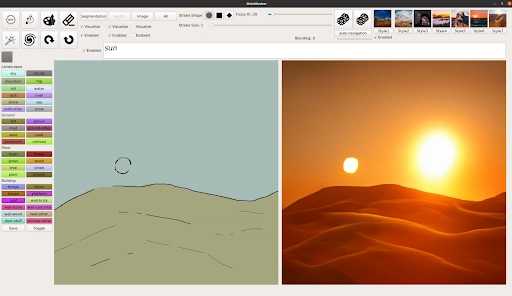

Nvidia揭露新一代圖像生成AI:GauGAN2,使用者只要輸入一句話,這套AI軟體就能即時產生場景圖,現已開放Navidia AI Demo讓大眾使用。Nvidia在2019年發布GauGAN第一代,以生成對抗網路訓練而成,可根據使用者簡單的草圖,產生出栩栩如生、更加精緻的圖畫。

現在,使用者只需輸入一句話,如「Sunset at a beach」,GauGAN2就會即時產生場景圖,使用者只要額外增加形容詞,像是「Sunset at a rocky beach」,或是將Sunset改成Afternoon,模型就會立刻修改圖片。Nvidia指出,GauGAN2在單個模型中結合了分割映射、圖像修復和文字到圖像生成功能,使其能根據文字和手繪,來建立逼真的藝術。這是首次在單個對抗網路框架中,結合文字、語義分割、草稿圖和樣式等多個模式,來生成豐富的圖像。(詳全文)

Google Chatbot Bot-in-a-Box

小型企業與顧客溝通新選擇!Google商家留言版新增聊天機器人功能

在Google搜尋和Google地圖的商家簡介中,原本就有提供了聊天室功能Business Messages,可讓顧客留言或發問。最近這項聊天室功能,新增了聊天機器人功能(Bot-in-a-Box),這是Google用自家AI對話工具DialogFlow所開發的新功能,商家不必撰寫任何程式碼,就能建立一個自動回答的Chatbot,例如商家可以用常見問題網頁,來快速建立一個能回答這些問題的Chatbot。而且這支Chatbot可準確理解「顧客意圖」,就算顧客以不同方式來表達類似問題,都能得到準確的回應。(詳全文)

資料中心 A2 Tensor Core 邊緣運算

Nvidia推出入門級資料中心GPU,搶攻邊緣運算AI推論市場

Nvidia在GTC 2021秋季大會上發表Ampere架構的入門款Tensor Core繪圖處理器A2,鎖定邊緣環境,來支援低功耗、小型的深度學習推論加速處理。若以處理器為基準,A2可提供20倍以上的推論運算效能。在Nvidia主導的產品認證系統當中,也將涵蓋A2這款用於邊緣伺服器的GPU。

除了用於推論處理,A2還可支援智慧型視訊分析應用(IVA),以及其他的多精度機器學習與深度學習部署,也能涵蓋到視訊轉碼、渲染、音訊與視訊的AI特效處理、數據分析、虛擬工作站、桌面虛擬化等工作負載。由於它的體型較小,本身是採用被動式散熱的單槽短版PCIe介面卡,採用熱功耗為40瓦到60瓦,特別適合空間與散熱需求局限的場所使用,像是5G邊緣設備與工業環境。(詳全文)

Alphabet 日用機器人 Everyday Robot

Alphabet日用機器人專案新進展!掃地、做家事沒問題

Alphabet旗下創新研發射月計畫實驗室Alphabet X,最近公布日用機器人專案Everyday Robot新進展,旗下機器人學會更多技能,已能在Alphabet員工餐廳擦桌子、整理會議室。

Alphabet X在2019年發起通用型學習機器人專案Everyday Robot Project,要打造能執行日常任務的機器人,如倒垃圾、擦桌子、整理家具等,甚至還要能幫助獨居長者自理家務。該專案用攝影機和一組ML演算法來讓機器人認知環境,並將一種任務學習的能力擴大到其他任務,如此就不必重新打造另一個機器人,或從頭撰寫程式。經兩年發展,該專案已有100多座Everyday Robot原型機器人,不但具備更多技能,如拿抹布擦桌子、開門、排椅子,還已在Alphabet公司廠區執行各種任務,且動作執行成功率從75%進步為現在的90%,(詳全文)

字節跳動 BERT 影像辨識

字節跳動以BERT架構打造SOTA等級影像辨識新模型

字節跳動聯手約翰霍普金斯大學和上海交大,共同開發一套以BERT為基礎的自監督影像辨識預訓練模型iBOT,且在影像分類上達到高階表現。團隊指出,BERT在自然語言處理(NLP)任務中,表現突出的關鍵是遮罩語言模型(MLM),也就是以克漏字方式,來雙向預測被遮住的字詞機率,比傳統的單向預測更準確。

於是,團隊將這個概念延伸到影像辨識上,想發展一個遮罩影像模型(MIM)來解決電腦視覺任務。他們先打造一個視覺標記器(Vision tonkenizer),來將遮罩的區塊轉換為系統性訊號,給目標模型處理。接著,團隊將MIM轉化為知識蒸餾(KD)來學習標記器的知識,並以一個老師模型作為線上標記器,來讓MIM進行自蒸餾。如此一來,目標網路就能將遮罩的影像視為輸入值,線上標記器則能保有原影像。這麼做,也能讓目標網路學會復原被遮罩的影像區塊。最後,團隊表示,iBOT在ImageNet-1K資料集的測試中,在影像分類裡達到高階表現(83.8%),在一些下游任務中也比現有的模型表現還要好。(詳全文)

圖片來源/AWS、Nvidia、Google、Alphabet

AI趨勢近期新聞

1. 微軟釋出高效能MoE函式庫Tutel

2. 愛立信聯手瑞典大學,用ML和聯合學習來預測空氣品質

資料來源:iThome整理,2021年12月

熱門新聞

2026-02-11

2026-02-09

2026-02-11

2026-02-10

2026-02-10

2026-02-06

2026-02-10

2026-02-10