圖片來源:

蘋果

繼去年底發表的多模態大型語言模型(Multimodal Large Language Model,MLLM)Ferret之後,蘋果上周再度發表另一個多模態模型家族MM1,特別注重模型的架構元件以及預訓練中所使用的資料,以優化MLLM。

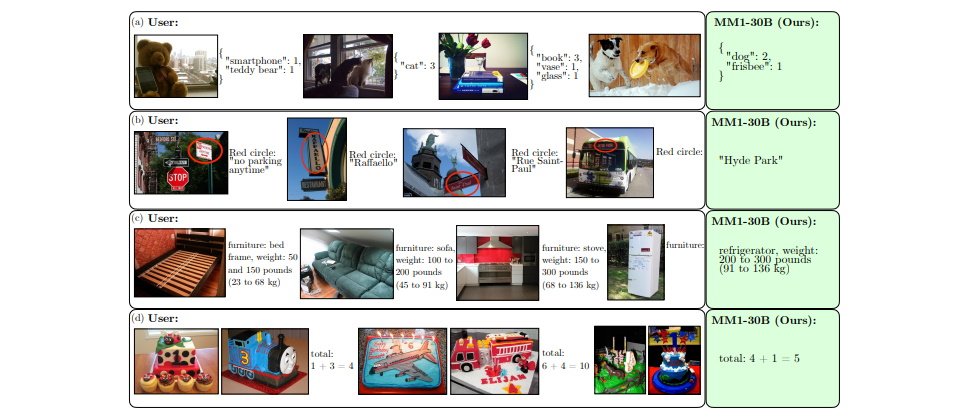

蘋果團隊研究了MLLM架構的各種元件,諸如用來處理視覺資料的圖像編碼器,或是整合兩種模態資料的視覺語言連接器,用來訓練的資料則混合了圖像說明、配對的圖像與文字,或是純文字資料等,開發出支援300億個參數的MM1多模態模型家族,此一家族的模型結合了密集模型與混合專家模型,不管是在預訓練基礎模型或是微調後的模型,在多模態基準測試上都達到了良好的效能。

研究人員表示,MM1的各種模型受益於大規模的預訓練,而強化了它們在脈絡學習、多圖像推論,以及有限提示的思考能力,代表相關模型將更能夠理解脈絡,基於不同圖像展開推論,也能在最少的提示下生成回應。

根據市場分析機構Stocklytics的調查,蘋果已經買下了高達32家的AI新創,居美國科技大廠之冠,加拿大AI新創DarwinAI也在今年初被納入蘋果麾下,蘋果亦已對外承諾會在今年部署生成式AI,使得外界引頸期盼落後各大科技業者的蘋果,今年會端出什麼樣的AI產品。

熱門新聞

2026-02-11

2026-02-09

2026-02-11

2026-02-10

2026-02-10

2026-02-06

2026-02-10

2026-02-10

Advertisement