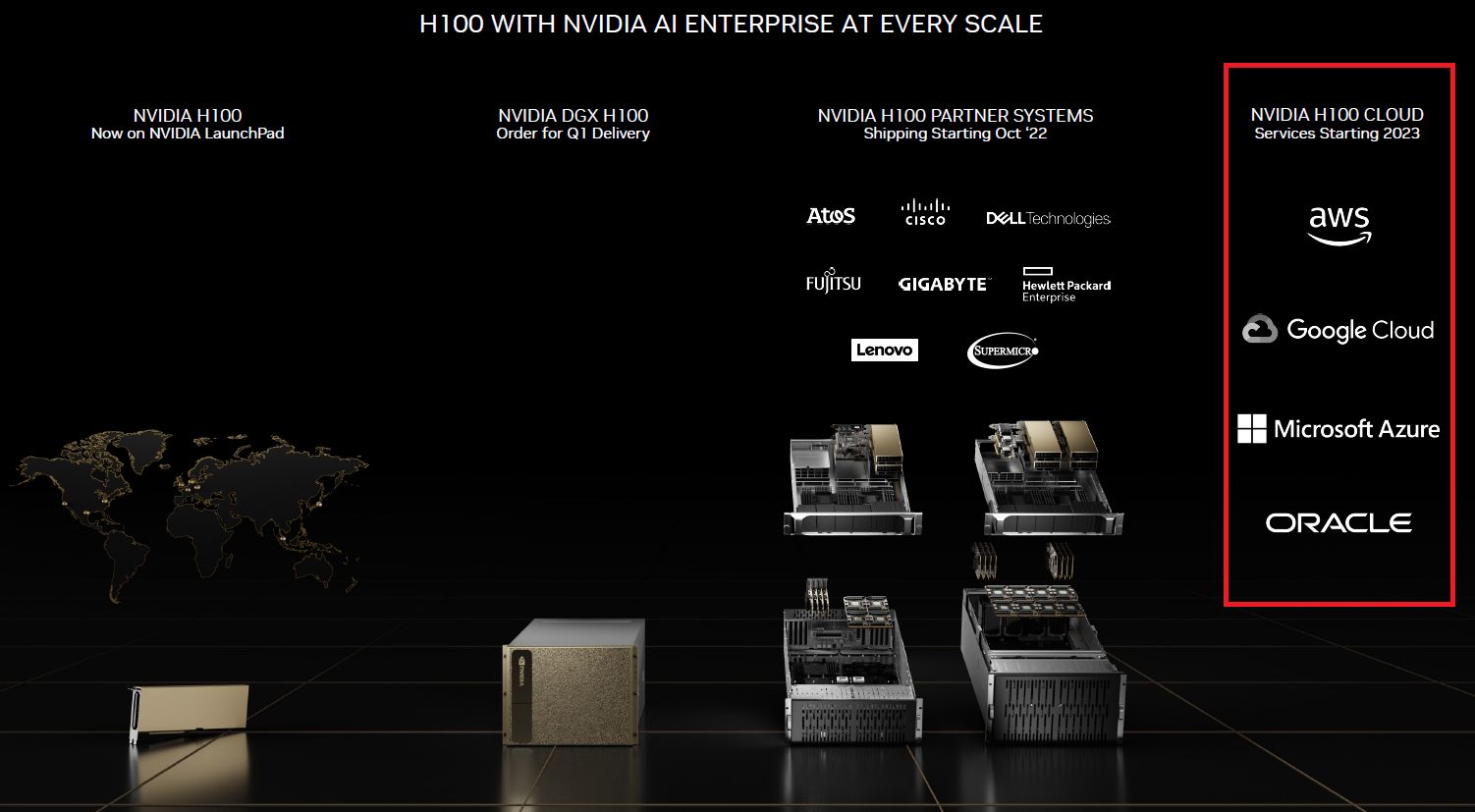

當前最受全球矚目的資料中心GPU產品,莫過於Nvidia在2022年3月GTC春季大會發表的H100,當時除了眾多伺服器廠商表示將搭配這款GPU,也預告各大公有雲業者提供搭配H100的執行個體服務,打算這麼做的廠商有阿里雲、AWS、百度智能雲、Google Cloud、微軟Azure、Oracle Cloud Infrastructure(OCI)、騰訊雲。

同年9月GTC秋季大會期間,Nvidia宣布H100進入完全生產狀態,他們表示,雲端業者2023年會開始部署搭配H100的執行個體服務,此時列出的廠商有4家,分別是:AWS、Google Cloud、微軟Azure、OCI。

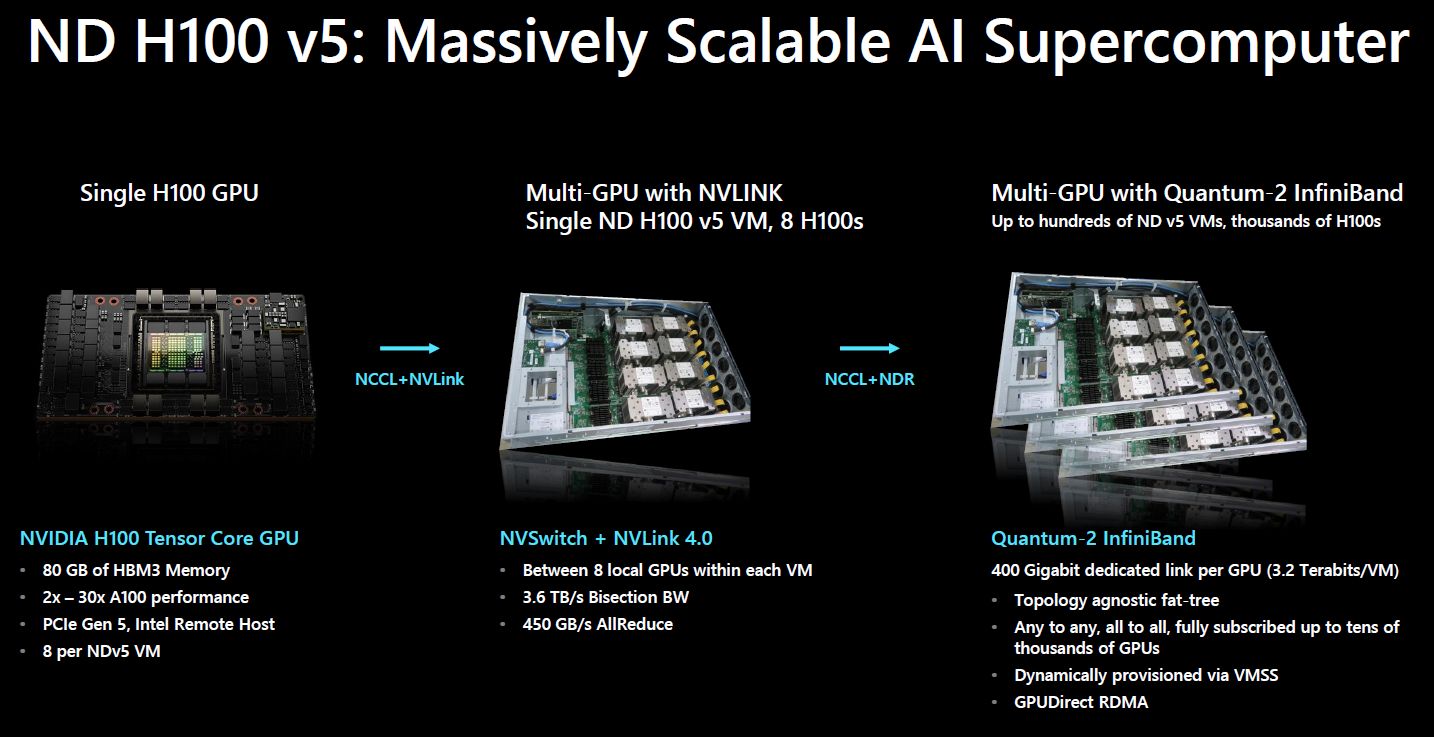

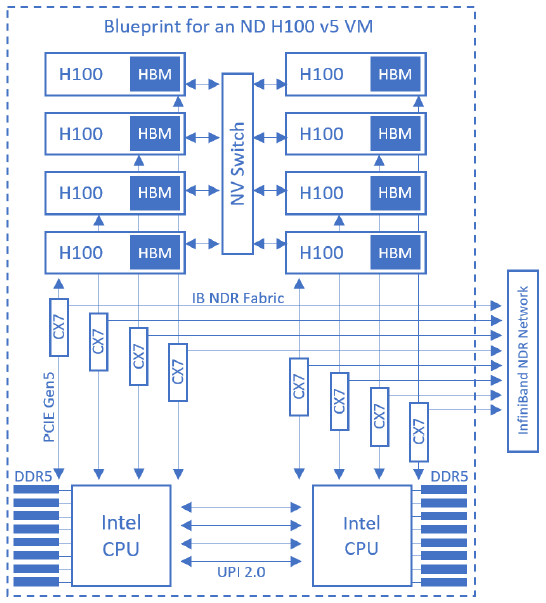

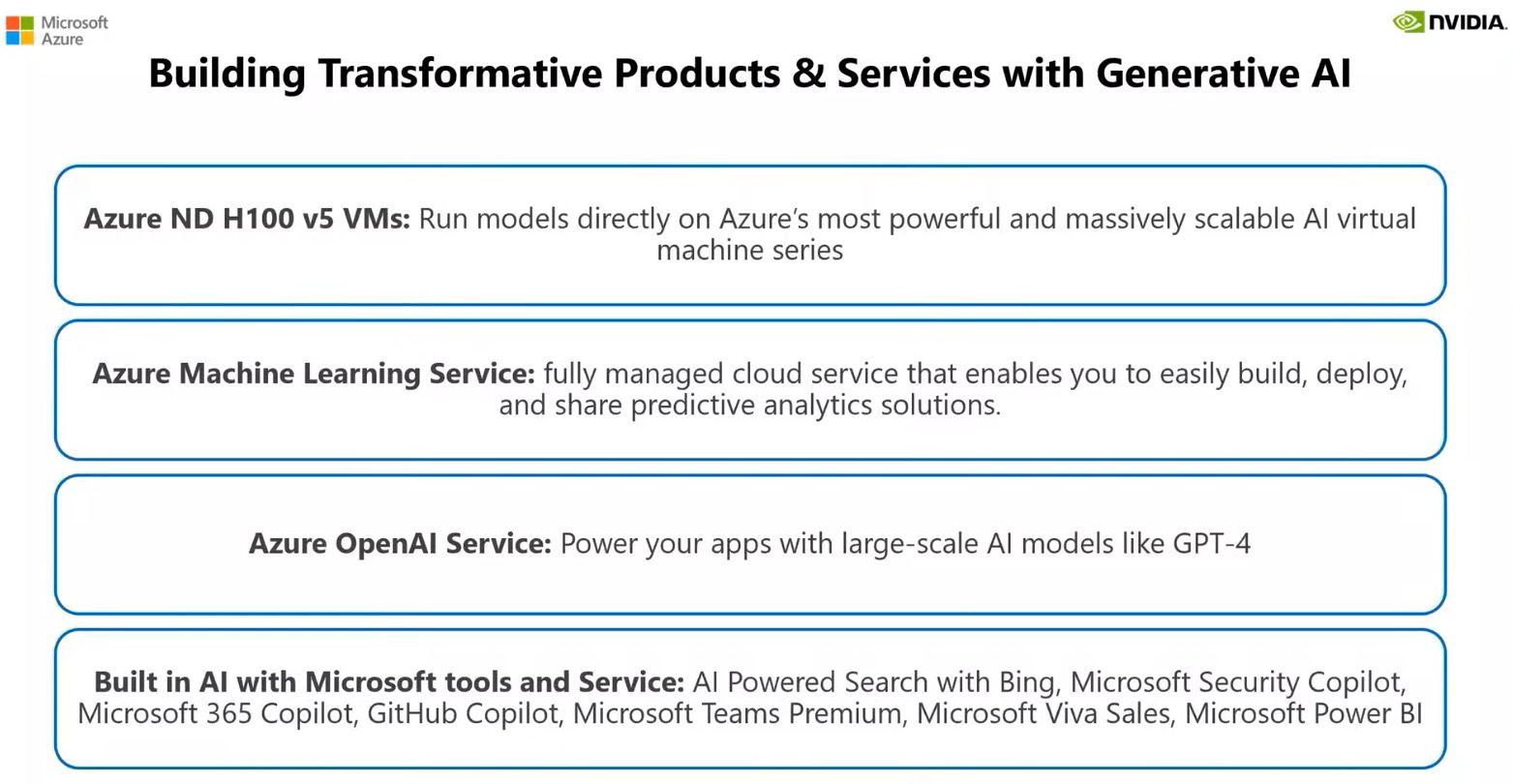

而在11月的美國超級電腦大會期間,微軟在Nvidia的新聞稿表示,他們旗下的ND系列與NC系列執行個體服務,能夠針對AI分散式訓練與推論進行最佳化,提供基於雲端服務而成的超級電腦環境,是第一個結合Nvidia人工智慧技術堆疊的公有雲業者,預計將在這個平臺增添數萬張A100、H100 GPU、400Gb InfiniBand網路設備,以及Nvidia AI Enterprise軟體套餐;而AWS在11月底舉行的全球用戶大會,預告將推出搭配H100的執行個體服務。

到了2023年3月GTC春季大會,Nvidia揭露雲端業者相關服務的提供狀態與進度,例如,Cirrascale、CoreWeave這兩家的H100執行個體服務已經正式上線,微軟Azure已開放ND H100 v5系列服務的私密預覽,OCI限量提供搭配H100的運算裸機GPU執行個體服務,

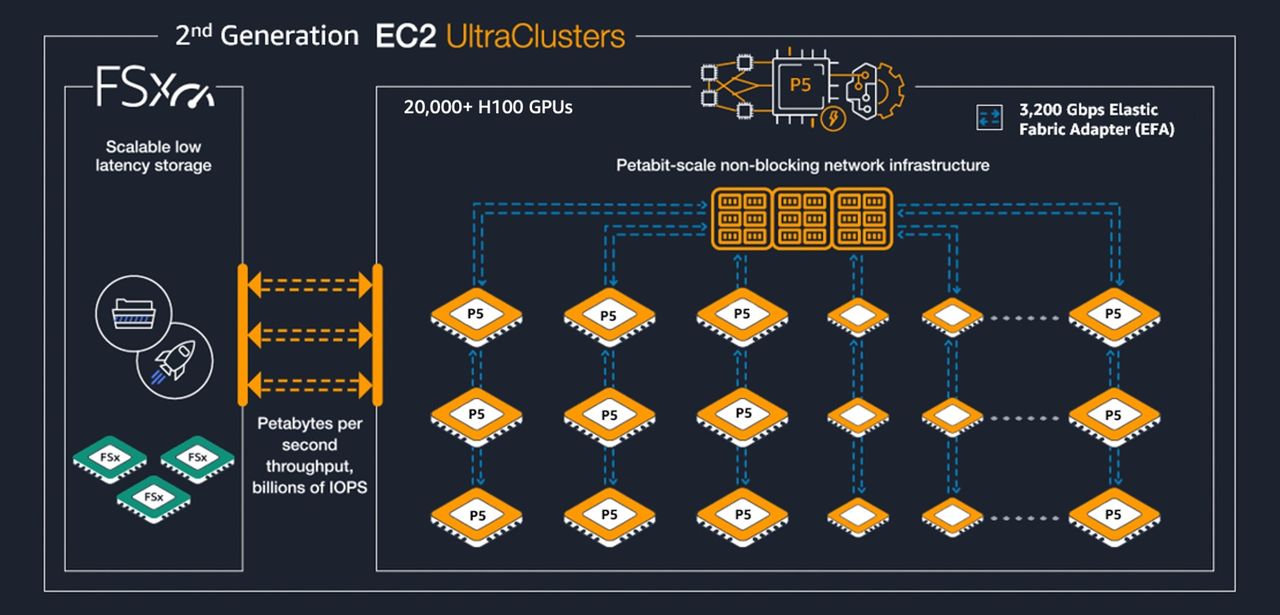

AWS表示接下來幾週將開放特定用戶預覽,主角是Amazon EC2執行個體服務當中P5將會使用H100,最大可提供20 Exaflops的運算效能,可用來組建與訓練最大的深度學習模型,此款雲端服務也將導入AWS第二代EFA(Elastic Fabric Adapter)網路卡,可能提供3,200 Gbps的網路頻寬與吞吐能力,若需要更大運算規模,可在EC2 UltraClusters這套雲端運算叢集服務當中,擴展使用2萬臺H100 GPU彼此連接,以因應超級電腦等級效能的AI隨需存取應用。此外,Google Cloud、Lambda、Paperspace、Vult這幾家雲端廠商,也計畫推出搭載H100的雲端服務。

在這段期間,ChatGPT引領全球人工智慧熱潮,推動相關技術發展的OpenAI與微軟成為舉世矚目的焦點,微軟也趁機在Nvidia GTC春季大會與自家Build開發者大會,宣傳他們發展的Azure AI基礎架構,ND H100 v5系列當然也被提到,外界預期這個執行個體服務就快要正式推出。

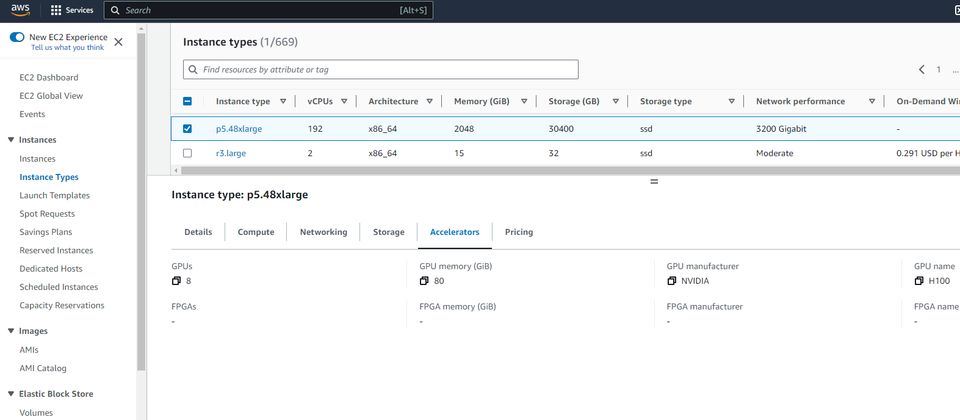

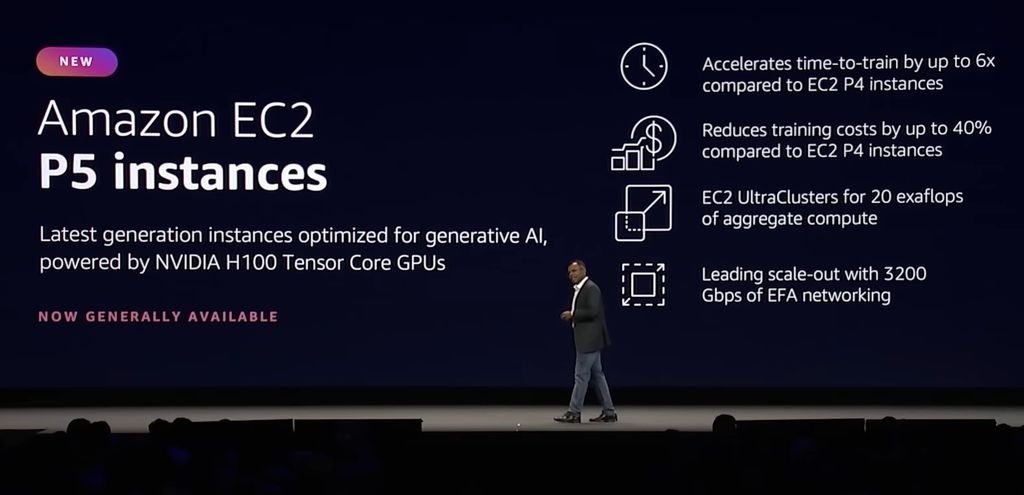

然而,到了6月底,AWS突然在自家的紐約峰會(AWS Summit New York)宣布推出Amazon EC2 P5,搶先微軟Azure推出搭配Nvidia H100的執行個體服務,全名為p5.48xlarge,單個執行個體服務,最多可搭配8張內建HBM3記憶體80 GB的Nvidia H100,此服務目前僅在兩座資料中心區域供應,分別是:美國西部(奧勒岡),以及美國東部(維吉尼亞北部)。

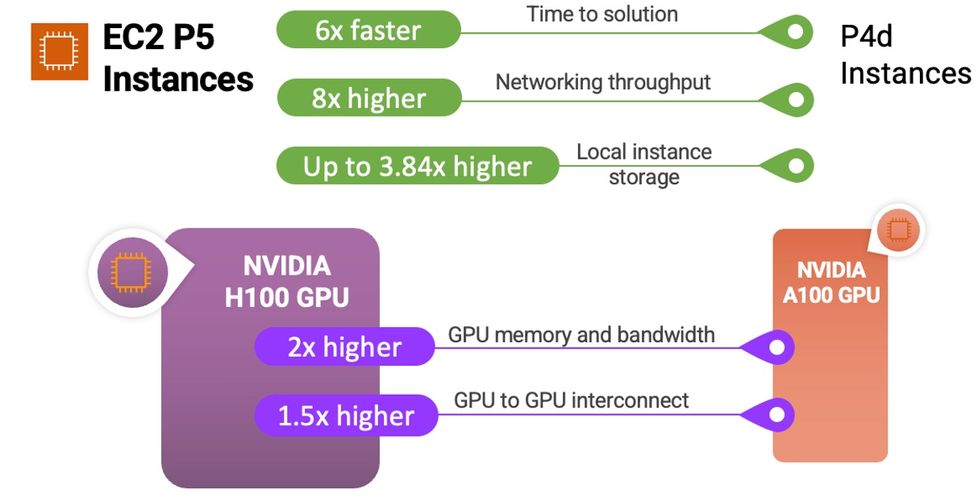

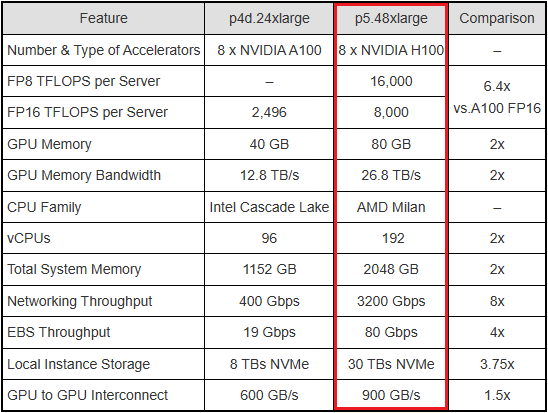

關於使用效益的差異,AWS表示,相較於採用Nvidia上一代資料中心GPU(A100)的執行個體服務P4,若改用P5執行深度學習模型的訓練處理,時間縮減幅度可達到6倍之多,原本要好幾天才能完成,現在只需幾個小時,而這樣的效能突飛猛進,也帶來降低AI訓練成本的效益,可節省40%的費用。

除了GPU帶來顯著的運算效能提升,P5在伺服器運算效能與資源的配置上,也優於P4。舉例來說,處理器效能增加1倍(AMD第三代EPYC、192顆虛擬處理器,對上英特爾第二代Xeon Scalable、96顆虛擬處理器),系統記憶體容量提升7成(2,048 GiB對上1,152 GiB),本機硬碟存容量增加至4倍(30 TB對上8 TB)。

而在網路頻寬的部分,P5因為導入AWS本身發展的第二代EFA網路加速技術,傳輸效能可達3,200 Gbps(P4為400 Gbps),可提供強大的橫向擴展規模能力,有利於承擔分散式AI訓練,以及處於緊耦合狀態的高效能運算工作負載。

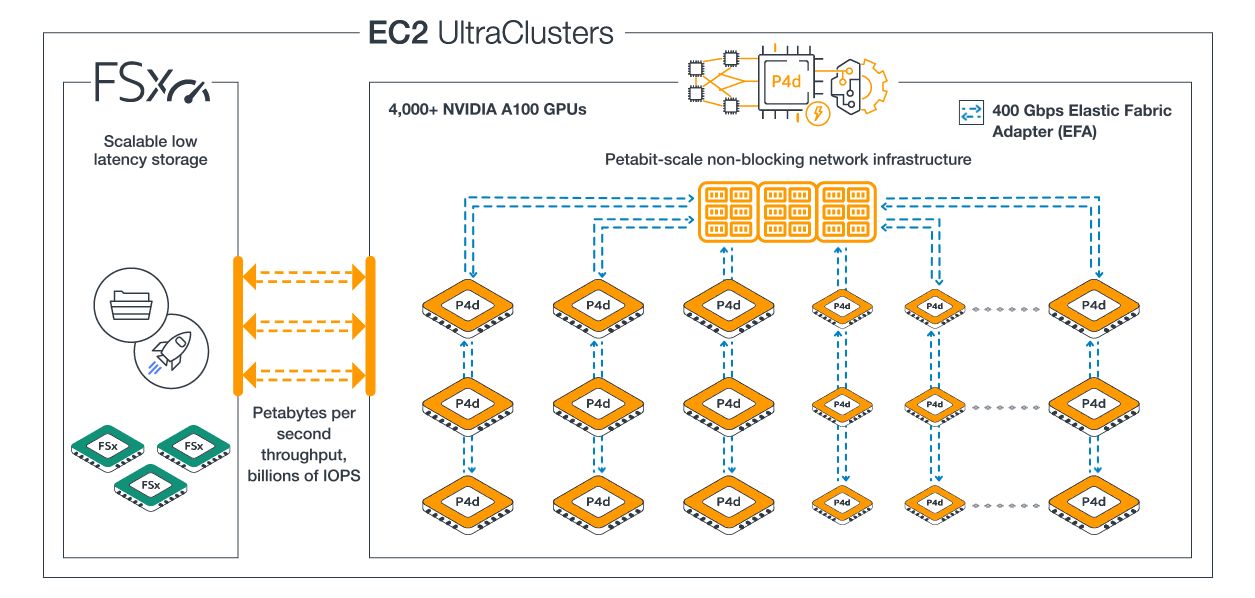

若要支援更大規模的人工智慧與高效能運算處理,用戶可建置Amazon EC2 UltraCluster,並在這個叢集環境部署P5執行個體服務,提供 Pbps等級的網路互連能力,最多可連接2萬張Nvidia H100,匯集運算容量可達到20 Exaflops的規模。

產品資訊

AWS Amazon EC2 P5

●原廠:AWS

●建議售價:On-Demand Linux方案每小時98.32美元

●基礎運算規格:AMD第三代EPYC處理器、2 TB記憶體、30 TB NVMe儲存空間

●提供服務規模選擇與最大組態:p5.48xlarge,192顆虛擬處理器、2048 GiB記憶體、8臺3.84 TB本機儲存、8張Nvidia H100 GPU、網路頻寬為3,200 Gbps,網路儲存:使用AWS區塊儲存服務EBS,存取頻寬為80 Gbps

【註:規格與價格由廠商提供,因時有異動,正確資訊請洽廠商】

熱門新聞

2026-02-09

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-09

2026-02-06