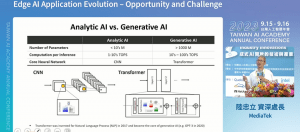

如何在手機等行動裝置上執行LLM模型推論?聯發科AI負責人:得先克服三大挑戰

在聯發科負責電腦與AI部門的聯發科資深處長陸忠立表示,想要在行動或邊緣裝置上執行LLM模型推論,必須考慮到記憶體配置、運算能力和記憶體頻寬。這也是目前在邊緣裝置上執行LLM模型推論面臨的3大挑戰。

2023-10-20

| LLM模型 | Llama 2 | 中研院 | CKIP Lab | CKIP-Llama-2-7b

中研院正式開源釋出繁中優化的Llama 2大型語言模型,正式採用Apache2.0釋出

中研院CKIP Lab中文詞知識庫小組,最新開源釋出了以Llama 2開發的繁中優化的大型語言模型CKIP-Llama-2-7b,並提供學術和商用,可運用在文案生成、文學創作、問答系統、客服系統、語言翻譯、文字編修、華語教學等。

2023-10-06