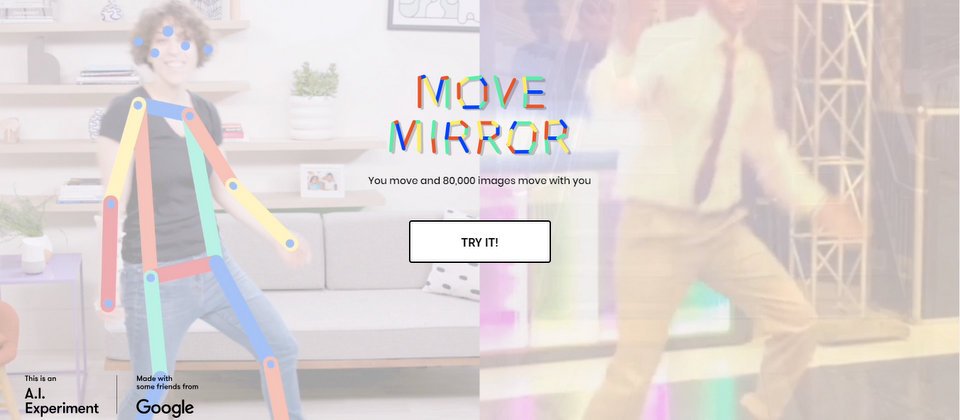

Google於本周四(7/19)揭露人工智慧實驗(AI Experiment)專案Move Mirror,採用機器學習框架TensorFlow.js,來比對使用者所傳送的動作影像與其他類似動作的圖像。Move Mirror就像鏡子,能夠找出與使用者動作相似的圖像。

Move Mirror採用姿勢判斷模型PoseNet,來偵測人物圖像和影像,並判斷人體的重要關節。Move Mirror從使用者的電腦攝影鏡頭取得圖像資料後,再與圖像資料庫中的圖像進行比對,並找出與使用者動作最接近的圖像,讓使用者用自己的電腦和電腦攝影鏡頭就能使用PoseNet的姿勢判斷功能。

(圖片來源/Google)

而使用者可以透過Move Mirror官網,並允許網站使用自己的裝置攝影鏡頭,用戶就可以在自己的電腦攝影鏡頭前擺動身體,接著Move Mirror就會從擁有超過8萬張圖像的資料庫中,比對與使用者的即時影像相似的動作圖像。

這意味著,使用者現在在網頁瀏覽器上,就能使用機器學習來進行姿勢判斷。另外,Move Mirror也提供使用者能將比對出的圖像結果製作成GIF圖檔,且能與朋友分享這些圖像結果。

Google表示,透過TensorFlow.js,所有的動作追蹤與判斷直接在網頁瀏覽器內完成,所以使用者的圖像和影像並不會儲存或傳送至Google的伺服器。

Google Move Mirror介紹短片:

熱門新聞

2026-02-16

2026-02-13

2026-02-16

2026-02-16