SAS總監Reggie Townsend負責推動內部數據倫理措施,在今日大會上揭露今年中將上線的AI模型卡功能,可顯示模型各大指標外,還能載明存取人員、修改記錄等,以因應AI監管需求。

攝影/王若樸

數據分析大廠SAS在今年度Innovate 2024年會上,繼續深化AI和生成式AI產品策略,今日揭露AI監管新工具和服務,包括宛如營養標示卡、整合在主力產品Viya平臺的AI模型卡(AI Model Cards)功能,以及可信任AI生命周期(Trustworthy AI Life Cycle)工作流程,可滿足美國國家標準暨技術研究院(NIST)制定的AI風險管理框架需求。

AI模型的營養成分表,模型卡清楚標示模型各大關鍵指標

如何將AI模型以通俗易懂的方式,呈現給所有參與AI生命周期工作中的人員,是一件很困難的事。再加上AI監管法規在世界各地越來越嚴格,比如臺灣去年已有產業主管機關發布金融業運用AI指引草案、今年政府也將推出AI基本法等,對企業來說,如何呈現模型表現、讓監管機構理解,成為另一重要課題。

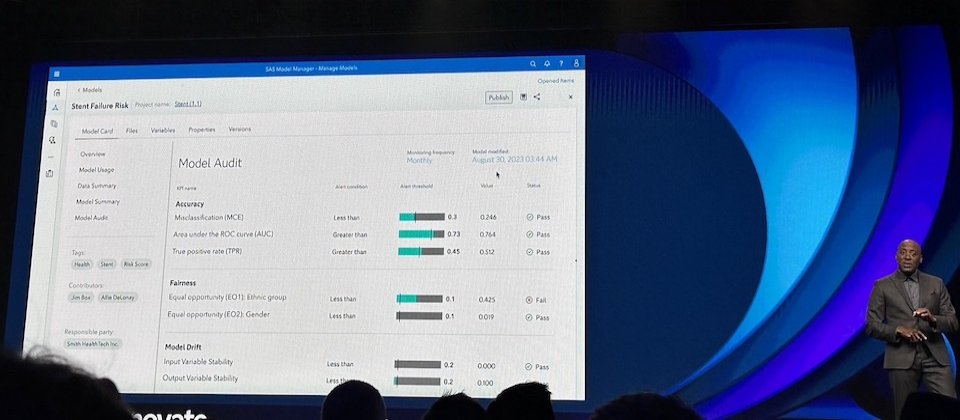

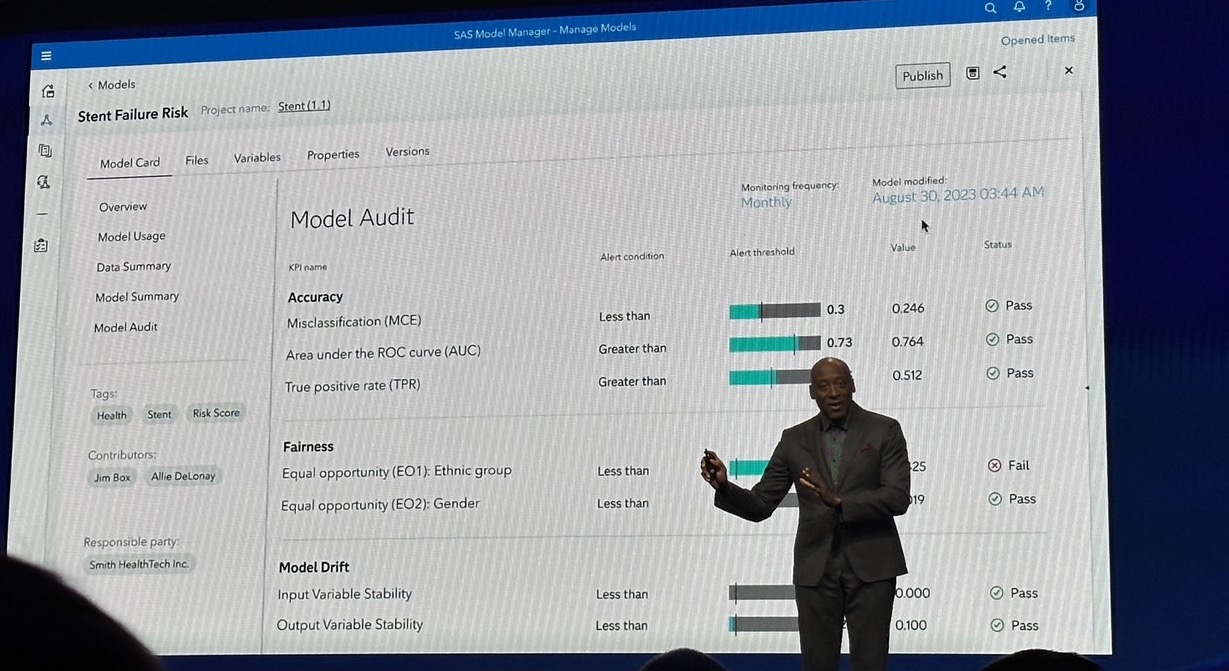

看準這個需求,負責推動數據倫理措施的SAS總監Reggie Townsend,今日揭露自家雲端資料分析平臺Viya上新添的模型卡功能(如下圖),預計今年中正式上線。這個功能能讓企業或組織內的利害關係人,不論是開發者還是董事會董事,都能查看易懂的模型重要資訊。

模型卡的運作方式是,直接根據SAS產品內容來為使用者註冊的模型,自動產生模型卡,使用者不必手動建立。不只是SAS平臺提供的模型,因SAS Viya已有用於管理開源的架構,因此也能替開源模型建立模型卡,目前從Python模型開始支援。

至於模型卡將顯示的內容,會特別突顯準確性、公平性和模型漂移等指標,尤其,模型漂移是模型性能隨條件變化而下降的重要指標,可用來判斷模型的適用性。除了這些,模型卡還包含詳細的模型治理資訊,像是模型上次修改的時間、誰對此做出貢獻、誰對模型負責,方便使用者組織解決模型性能異常問題。SAS表示,模型卡還涵蓋模型使用資訊,可供企業或組織查明預期用途、超出範圍的應用和限制訊息,這些資訊可因應企業業務營運所需的透明度和規範檢查。

根據NIST AI風險管理框架量身打造AI治理工具和服務

另一方面,美國NIST在去年推出AI風險管理框架(AI RMF),是一份關於AI系統的設計、開發、部署和使用指南,也成為企業組織在缺乏官方法規的情況下,用來設計可信任和負責任AI的重要參考。Reggie Townsend本身也是美國商務部國家AI諮詢委員會 (NAIAC) 成員,負責提供AI治理建議給白宮。

在這些基礎上,SAS根據NIST AI風險管理框架,設計出一套可信任AI生命周期工作流程,來讓企業和組織更容易實作NIST的AI風險管理框架。首先,SAS這款工作流程定義了個別角色和工作期望,並收集所需文件、列出考量因素,透過自動化來簡化實作的工作流程。之後,企業或組織使用者會得到一個正式模型,附帶一個文件來說明他們已做好盡職調查,來確保模型是公平的,且作業流程不會造成任何傷害。

不只如此,這款工作流程還能讓使用者記載,自家AI系統可能產生的社會影響思考。比如,使用者可透過工作流程的幾個步驟,來確保訓練資料能足夠代表被影響的受眾群體,且模型的預測能力和表現,在受保護的類別中都差不多。這些步驟可確保模型不會造成負面影響,或傷害特定群體。而且,使用者還能建立人為介入(Human-in-the-loop)的任務,來確保模型一直準確。

目前,使用者可從SAS模型管理資源GitHub上下載可信任AI生命周期工作流程,之後也能在NIST AI風險中心下載。

不只如此,為更進一步提供現有客戶AI監管和治理服務,SAS自己也成立AI治理顧問服務(AI Governance Advisory),透過會議方式來協助企業達到AI治理目標。SAS已試辦這項顧問服務,其中歐洲最大的金融機構PZU波蘭保險集團就有採用。

熱門新聞

2026-02-09

2026-02-06

2026-02-09

2026-02-09

2026-02-09

2026-02-06

2026-02-09