MIT FutureTech

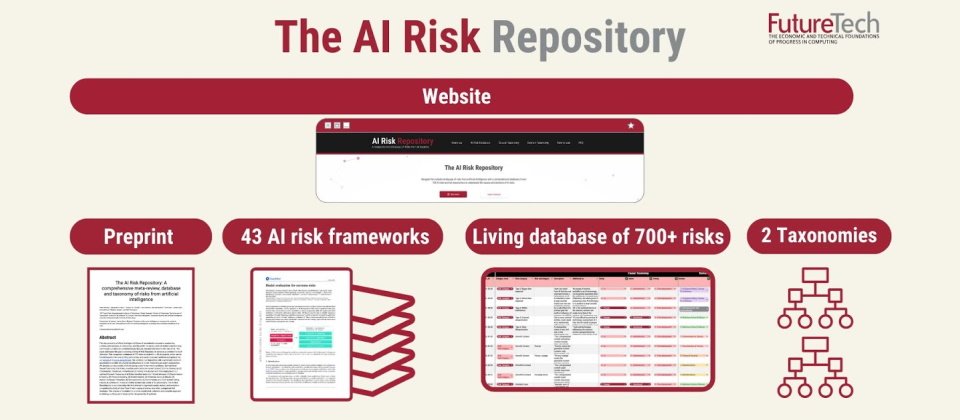

AI風險已成為公眾關注議題,麻省理工學院(MIT)等學者集結了一個AI風險儲存庫(AI Risk Repository),供企業與政策、研究單位決策或評估系統之用。

這個AI風險儲存庫旨在以共通而完整的框架,協助用戶辨識、了解和緩解AI相關風險和漏洞,克服知識碎裂化造成資訊互通困難及決策速度耽擱。

本儲存庫的作者來自MIT FutureTech、MIT電機與AI實驗室、澳洲昆士蘭大學、荷蘭魯汶大學等研究機構。

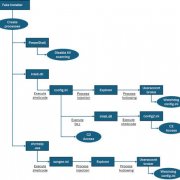

這個儲存庫主要分成三部分。一是AI風險資料庫,提供由現有43個框架汲取出的777多種風險。二是AI風險原因分類,分成三種,包括實體(人)、意圖(有意、無意)及時間點(部署前、部署後)。三是AI風險領域分類,將風險分成7種領域(如「假訊息、歧視/毒性、安全/隱私、惡意行為者/誤用、社經/環境風險、人機互動、AI系統安全」)及23種次領域(如「虛假或誤導資訊」。)

AI風險儲存庫提供AI風險概要、會定期更新最新風險和研究資訊來源,並給立法人士、主管機關、企業、開發人員、研究、稽核者等角色的共通參考架構。對AI團隊而言,本儲存庫可提升風險管理能力,以充份資訊協助更有效辨識和緩解可能的風險,以確保安全AI系統的開發。立法議員則可用這儲存庫從事更有效的立法。這資源也有於培育AI風險專業人才。

但學者們也指出,這個儲存庫還是有些不足,像是涵蓋面有漏失,未能完全包括新興風險,檢視過程不免有人為偏見,分類系統也可能過度簡化問題複雜性。最重要的是儲存庫目前還無法提供風險影響及可能性百分比的資訊,而減損了實用性。不過即使有這些問題,仍不致減損它對推動負責任AI部署的貢獻。

用戶可以自由下載這個儲存庫,MIT專家也歡迎提供回饋意見或補充。

AI服務業者Gradient Flow則建議,為發揮AI風險儲存庫的功能,最好能將之提供的知識和洞見整合到AI開發流程和組織架構中。例如企業組織根據本資料庫建立事件回應策略,像是清楚的事件定義、多向度監控及預先定義的事件控制方法,作為有效的事件管理、減低對營運和商譽的衝擊。或是建立統一的平臺,減少碎裂化的AI生態系統,確保AI系統在合法、合乎倫理及效能要求下運行。

本AI儲存庫也反映全球因應AI安全風險及威脅的嘗試。歐盟制定全球第一部AI法案,也在8月初生效。

熱門新聞

2026-02-09

2026-02-06

2026-02-06

2026-02-06

2026-02-06

2026-02-06