研究人員可使用FACET資料集來評估電腦視覺模型在分類、偵測、實例分割與視覺定位等任務中,可能出現的偏差或歧視

2023-09-01

遭錯誤逮捕的黑人男子Randal Reid律師表示,由於警方臉部辨識演算法出錯,導致Randal Reid坐冤獄一星期

2023-01-05

| AI | Timnit Gebru | google | 分散式人工智慧研究協會 | Distributed Artificial Intelligence Research institute | DAIR | AI偏見 | AI倫理

遭Google驅逐的黑人AI專家Timnit Gebru創立自己的AI研究協會

由Timnit Gebru成立的分散式人工智慧研究協會(DAIR),標榜奠基於社群,旨在對抗大型科技業者以獲利為本的AI研發

2021-12-03

聯合國警告:AI將對人權造成威脅,呼籲暫停銷售及使用AI系統

聯合國人權辦公室發布《數位時代隱私權》調查報告,警告訓練資料偏頗引發的AI偏見問題,已嚴重威脅健康、教育、行動自由等人權,針對AI應用建立監管機制成當務之急

2021-09-17

| google | 資料集 | AI偏見 | Open Images | MIAP | 性別認同 | 多元性別

Google釋出不帶有性別與年齡屬性的人物註解資料集,避免人物辨識模型產生偏見

Google解釋因爲各個資料註解者的文化與背景不同,因此無法產生一致的性別和年齡人物註解,可能在機器模型中出現偏見,因此最新的MIAP資料集,人物皆使用無關性別和年齡的特徵註解。

2021-06-16

| AI偏見 | Graph Learning | AutoGL | 生醫 | PaddleHelix | 臺北榮總 | 大腸癌 | TensorFlow 2.4 | IT周報

AI趨勢周報第153期:面對大腸癌心慌慌?北榮用AI打造專屬客製化療法

臺北榮總聯手飛利浦,以數十年癌症登記資料庫的大腸癌資料,訓練一套AI系統,透過歷史資料相似度分析來提供預後預測和治療歷程建議;AI偏見人人喊打?孫民:在特定行銷領域反而有其好處;AutoML還不夠用,北京清華開源圖學(Graph)自動機器學習工具AutoGL;百度開源生醫專用運算平臺PaddleHelix,包括RNA二級結構預測、大規模分子預訓練、藥物-靶點親和力預測和成藥性預測等演算法模型。

2021-01-02

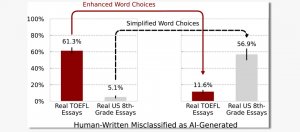

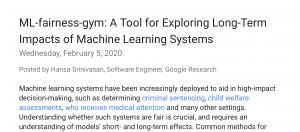

以靜態資料集來分析機器學習的公平性,無法反應系統在動態環境的真實情況,而ML-fairness-gym模擬工具可用來評估演算法的長期影響

2020-02-07

| 大腸癌 | AI醫療 | AI偏見 | MIT | VAE | 機器義肢 | Intel | Nauta | 深度學習 | 分散運算 | 停車位預測 | GitHub | Numpy | Neo-AI | AWS | AI | IT周報

AI趨勢周報第74期:中正大學聯手嘉基,用AI揪出大腸瘜肉!

中正大學聯合嘉義基督教醫院,打造一套醫學影像AI系統,可即時分析醫生大腸鏡檢查畫面,自動在電腦螢幕上框出瘜肉位置、辨識贅生性瘜肉機率,準確率高達95%。另一方面,北美2間大學用增強式學習來調教機器義肢,讓身障者可以舒適地走路。而MIT近日則提出一篇論文,要以新演算法來重新採樣訓練資料,解決人臉辨識偏見。

2019-01-31