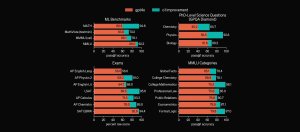

OpenAI新一代具關聯思考能力的模型o1,可逐步分析推理精確解答問題

OpenAI推出全新大型語言模型o1,其能夠運用關聯思考(Chain of Thought)技巧,解決需要深度推理的問題,無論是數學還是程式設計基準測試皆表現出色,目前已在ChatGPT開放測試

2024-09-16

GitHub提供便捷語言模型測試平臺,簡化生成式AI應用開發流程

GitHub新服務提供多種語言模型測試環境,開發者可在瀏覽器IDE Codespaces中進行實驗並部署至生產環境

2024-08-02

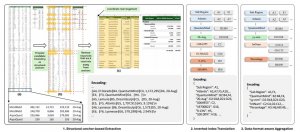

| SpreadsheetLLM | 微軟 | 大型語言模型 | LLM | 試算表 | Spreadsheet

微軟開發SpreadsheetLLM以讓LLM更容易理解試算表資料

微軟AI研究團隊發表SpreadsheetLLM研究成果,以協助大型語言模型(LLM)更容易理解試算表(Spreadsheet)內容以正確推論

2024-07-16

| LLM | Project TAME | 繁中 | 和碩 | 長春 | 長庚醫院

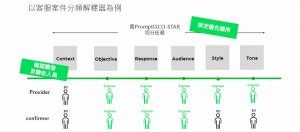

臺灣繁中LLM另一里程碑!Project TAME以5,000億個Token訓練而成並開源釋出

今日,一款強大的繁中大型語言模型Project TAME開源釋出,由長春集團、和碩聯合科技、長庚醫院、欣興電子、科技報橘、專攻法律AI的律果科技與臺大資工系、臺大資管系聯手打造,以Llama-3 70B模型為基礎,由5,000億個Token訓練而成。

2024-07-01