| SwiftKV | Snowflake | LLM | 知識蒸餾

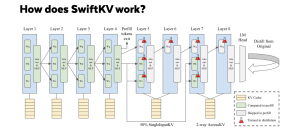

Snowflake開源可縮減LLM推論時間50%的SwiftKV模型

Snowflake在Hugging Face開源SwiftKV模型,透過模型重組與知識蒸餾,將輸入提示處理計算減半,提升大型語言模型推論效率至2倍,適用於高負載企業應用

2025-01-17

中國AI公司MiniMax推出新LLM,支援400萬Token與多模態應用

中國MiniMax推出MiniMax-01系列,語言模型支援400萬Token上下文處理,性能與頂尖模型相當,多模態模型專注文本與影像結合,適用智慧助理與多媒體生成,定價具競爭力但存政策風險

2025-01-17

| LG | Exaone | LLM | 混合式AI | Copilot+ PC | AI PC

LG Gram筆電導入混合式AI,本地端執行自家Exaone開源模型

LG新Gram筆電支援Copilot+,採混合式人工智慧架構,在本地端執行自家Exaone開源模型,可進行離線人工智慧運算,也能連接雲端支援更高階的需求

2025-01-03

7-Zip遭爆存在零時差漏洞,攻擊者可透過壓縮檔執行惡意程式碼,不過7-Zip開發者否認,指漏洞資訊有誤,並質疑是以大型語言模型生成

2025-01-02

DeepSeek V3多項測試指標領先Llama,中國語言模型引發言論自由與話語權討論

中國人工智慧公司DeepSeek推出具6,710億參數的語言模型DeepSeek V3,技術與效能暫時超越Llama等開放模型。不過,來自中國的語言模型因其審查機制,對全球華語世界的言論多樣性與話語權帶來潛在影響引發關注

2024-12-27

| MLCommons | LLM | 安全風險 | 基準測試

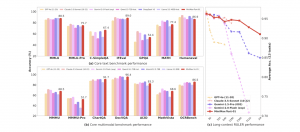

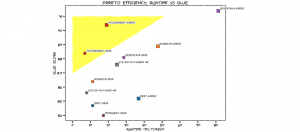

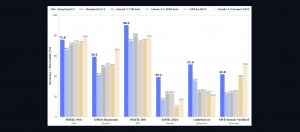

MLCommons推出第一個LLM安全基準,促進AI風險評估標準化

MLCommons針對大型語言模型的安全性推出AILuminate基準測試,涵蓋12類潛在危險並進行獨立科學評估,Claude 3.5 Haiku、Claude 3.5 Sonnet、Gemma2 9B、Phi 3.5 MoE Instruct皆達非常好(Very Good)的等級

2024-12-08

| 竊資軟體 | PyPI | JarkaStealer | LLM | ChatGPT | Claude

出現命名意圖與兩大AI平臺混淆的可疑開發套件,目的是散播竊資軟體JarkaStealer

卡巴斯基的研究人員發現,有人假借提供能連接大型語言模型(LLM)的API工具為由,鎖定PyPI開發人員散布惡意套件,目的是散布名為JarkaStealer的竊資軟體

2024-11-25