| Nvidia | GPUDirect Storage | GDS | AI儲存生態圈

【AI直連儲存加速時代來臨】GPUDirect Storage產品生態總覽

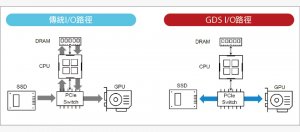

短短幾年內,Nvidia的GPUDirect Storage(GDS)儲存直連傳輸架構,已成功獲得幾乎所有重要儲存平臺的支援,成為當前AI應用的新一代標準傳輸架構

2024-10-25

| Nvidia | GPUDirect Storage | GDS | AI儲存生態圈

【AI應用不可或缺的儲存傳輸加速架構】持續擴展中的GDS儲存應用

問世5年後,Nvidia的GPUDirect Storage(GDS)直連傳輸技術,已逐漸成為當前AI應用中,儲存環境必備的標準傳輸架構,整個企業儲存業界都在擁抱這項傳輸技術

2024-10-25

| Nvidia | GPUDirect Storage | GDS | AI儲存生態圈

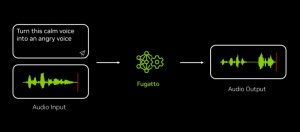

GPUDirect Storage(GDS)可以大幅提高儲存裝置與GPU之間的資料傳輸效率,但要啟用這套架構,必須有硬體與軟體方面的配合

2024-10-25

| Nvidia | AI生態系 | 儲存系統 | GPUDirect Storage | GDS

隨著伺服器虛擬化、大數據分析、生成式AI技術浪潮一波波襲來,Nvidia都在其中扮演重要角色,他們不斷打破既有市場規則,開創許多新的典範

2024-10-25

| Nvidia | GB200 | Blackwell | 開源運算專案 | Open Compute Project | OCP

Nvidia開源Blackwell平臺、伺服器元件設計給OCP

Nvidia將AI機櫃系統GB200 NVL72機櫃,以及液冷式運算與交換器匣設計,開源給開源運算專案(Open Compute Project)

2024-10-19

NVLM 1.0在光學字元辨識以及自然圖像理解的基準測試上,表現優於Llama 3-V、GPT-4o、Claude 3.5 Sonnet及Gemini 1.5 Pro

2024-10-02

AI帶動了Nvidia的資料中心業務,讓資料中心成為Nvidia成長最快也占比最高的營收來源

2024-08-29