| AWS | re:Invent | Trainium 2 | 晶片 | UltraServer | Claude 3.5 Haiku | Project Rainier | 加速 | 推論

【re:Invent 2024現場直擊】AWS揭Bedrock AI推論加速功能,能讓Anthropic最新模型推論加速60%

在今年re:Invent年會中,AWS揭露Trainium 2 UltraServer主機,也推出全託管AI平臺Amazon Bedrock的AI推論加速功能預覽版,可加速Llama 3.1模型和Claude 3.5 Haiku模型的推論速度。Anthropic共同創辦人暨運算長Tom Brown還透露,下一代Claude模型將由數十萬顆Trainium 2晶片來訓練。

2024-12-03

Nvidia開源TensorRT-LLM函式庫強化H100 GPU大型語言模型推論效能

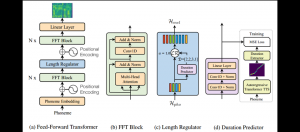

Nvidia推出TensorRT-LLM模型最佳化函式庫,強化H100 GPU推論能力,協助開發者高效運行大型語言模型,結合動態批次處理技術,提高GPU使用效率

2023-09-12

| AI | 微軟 | 語音合成 | google | AutoML | 自然語言 | PDF | Nvidia | TensorRT | 推論 | 萊迪思 | 28奈米 | FPGA | IT周報

AI趨勢周報第114期:快又不漏字!微軟發表FastSpeech能更快產生逼真自然的語音

微軟發表FastSpeech仿真語音生成模型,可快速產生逼真的人類語音,解決語音合成速度緩慢的痛點。Google正式推出AutoML Natural Language,新增了PDF語意理解功能,還可支援5,000個分類標籤,訓練資料量最多可支援1百萬筆文件。Nvidia發表新一代深度學習加速的SDK TensorRT 7,透過優化的編譯器,來加速迴歸和Transformer模型的推論,比傳統CPU快10倍以上。

2019-12-19